台大李宏毅Machine Learning 2017Fall学习笔记 (2)Linear Regression and Overfitting

简单回归问题应用举例分析

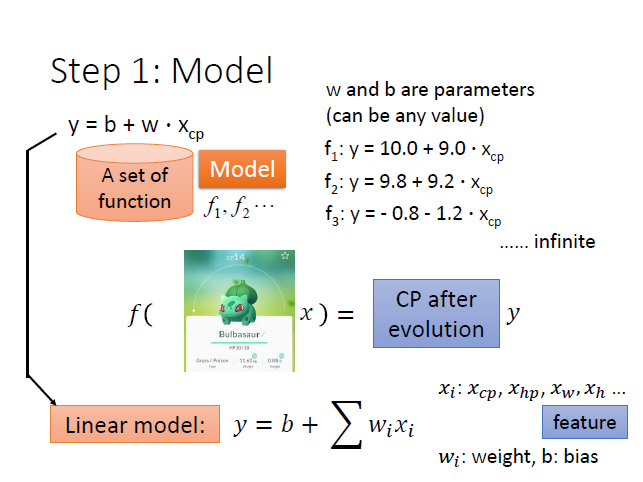

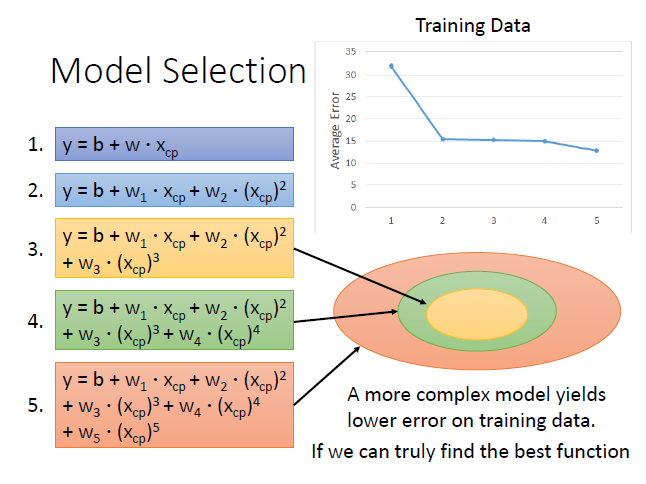

第1步:选取模型

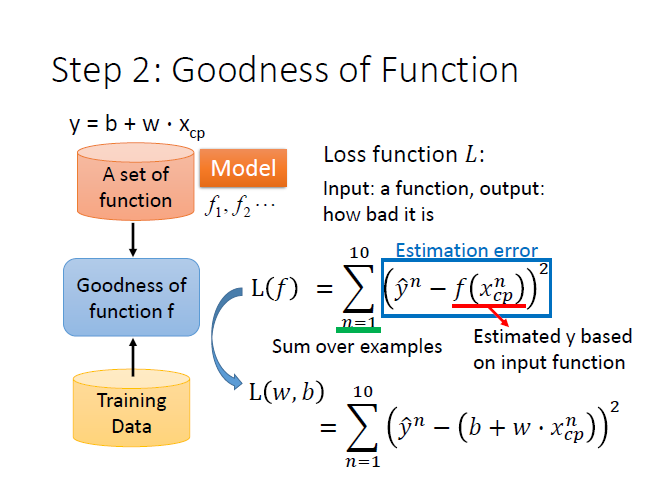

第2步:评价模型,建立损失函数L(f)

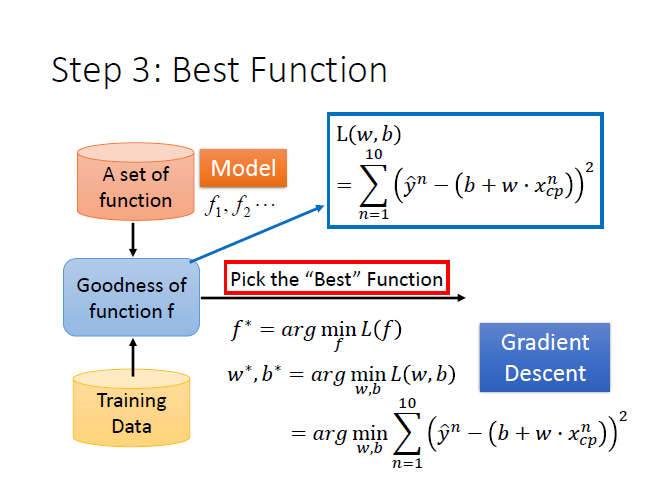

第3步:选择最优函数,在此过程中会利用到梯度下降和正则化等方法,也介绍了过拟合的问题。

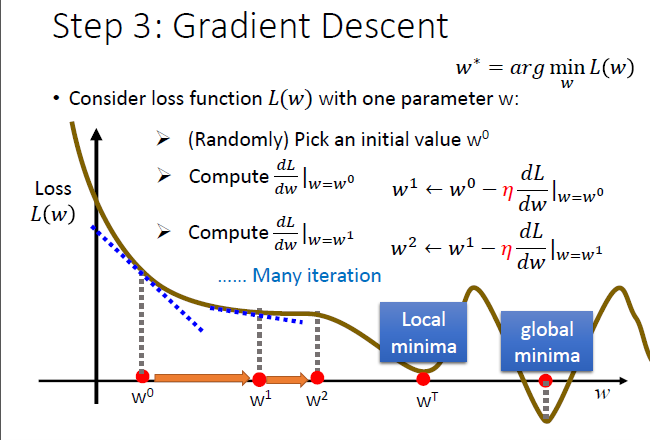

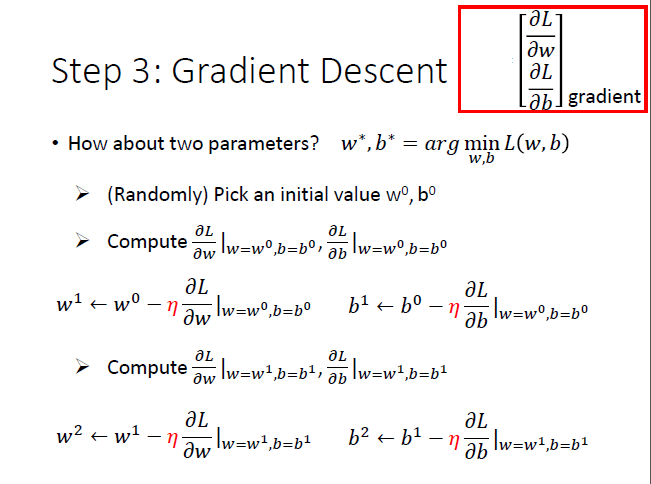

具体到此问题中,目标函数是L(w,b),要求得使L(w,b)值最小的w和b值。

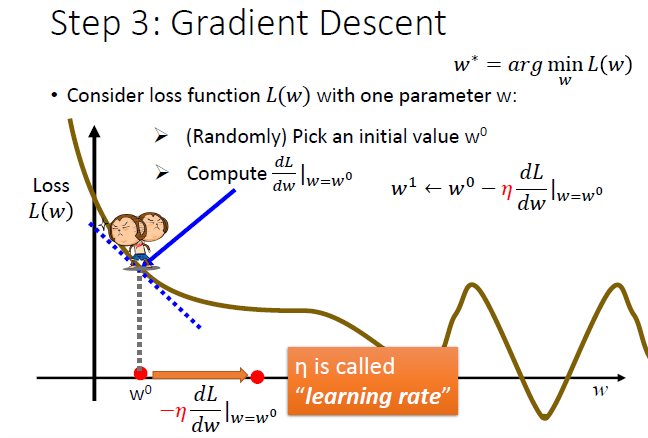

利用了梯度下降法来求最优点,引进了学习率的概念

不断迭代,得到最优点。

多个参数时,步骤类似。

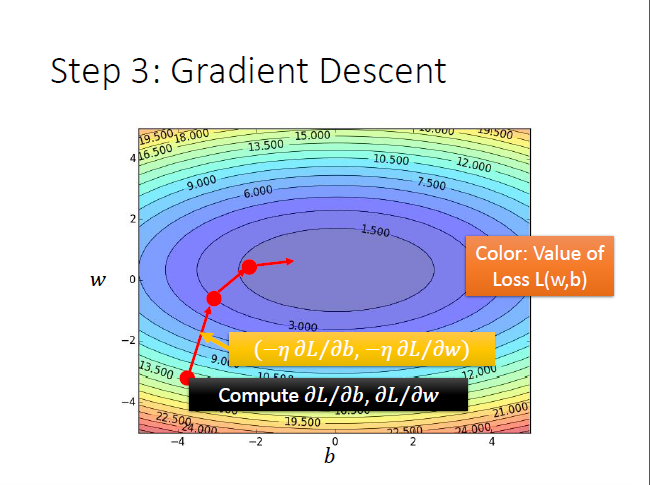

理论上,可像下图这样一步一步地走向胜利。然而事实并不简单.....

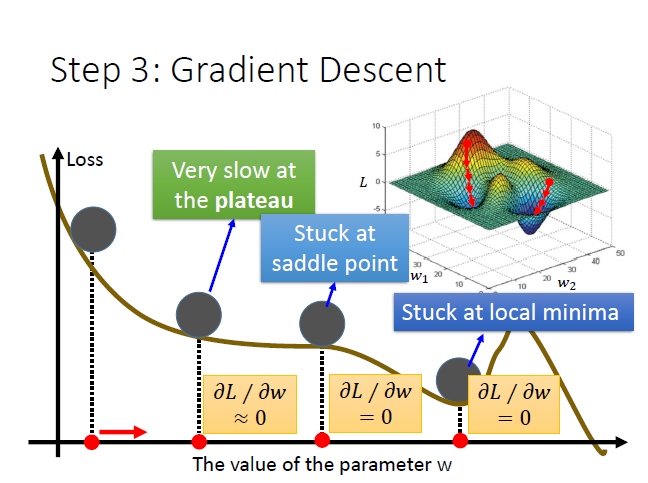

在面对实际问题时,在目标函数的优化过程中,极有可能会像下图这样掉到局部极值中出不来,理论上只有保证目标函数是凸函数,梯度下降法才能找到全局最优解。但是梯度下降法仍然在深度学习中得到了广泛的运用,详细原因一两句说不完,请有心人搜知乎......

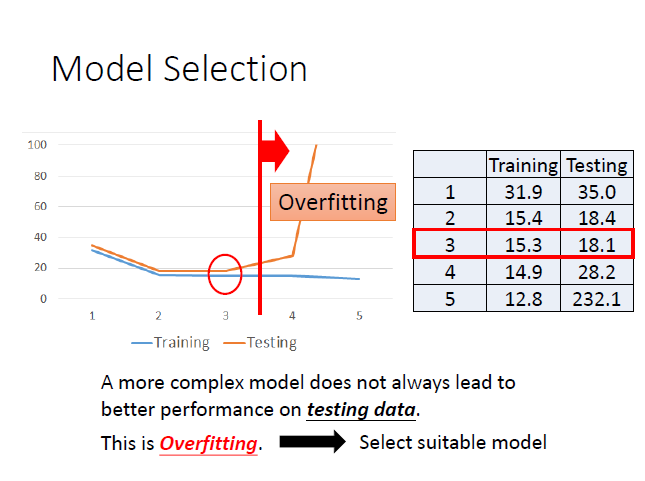

过拟合

模型的选择要根据问题和数据集的实际情况而定,不能过于复杂。模型过于复杂,会发生在训练集上的错误率很小,但在训练集上的错误率很大的情况,这就是过拟合。

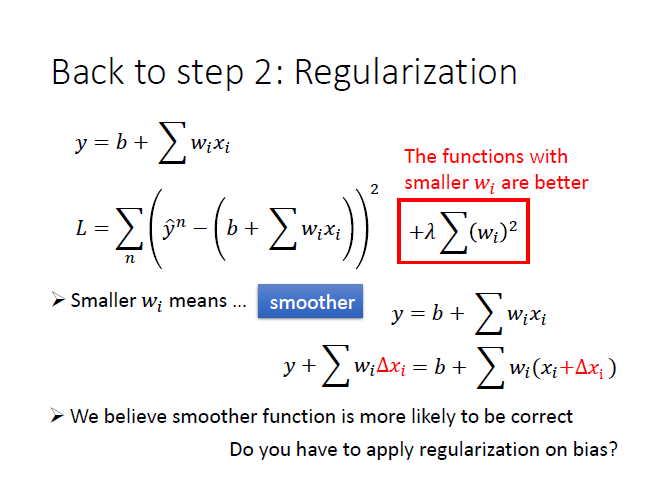

正则化

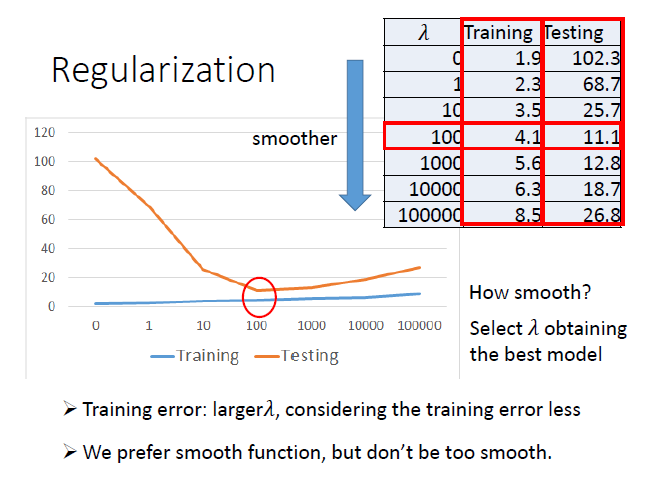

上图中红框里的就是正则化项,加入这一项会使函数拥有较小的Wi,较小的Wi会让函数变得更平滑。平滑的函数对输入中的噪音信号相对不敏感。那么在testing时若input中有noise,平滑的函数受到的影响会更小,从而产生更好的结果。拉波塔值越大,代表考虑smooth的正则化那一项影响越大,函数也就越平滑。

上图结果表明:1)拉波塔值越大,训练误差越大;2)我们希望函数更平滑,但是也不要过于平滑。

619

619

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?