问题及代码:

/*

*Copyright(c)2016,烟台大学计算机与控制工程学院

*All right reserved.

*文件名称:77.cpp

*作 者:董凯琦

*完成日期:2016年4月5日

*版 本 号:v1.0

*

*问题描述:在互联网中使用IP地址占4字节,可以用四段法表示,每段

值的范围为0-255,中间用"."隔开,例如202.194.116.97。现设计一个

IP地址类,用于保存IP地址,并实施在IP地址上的一些操作。

*输入描述:无

*程序输出:

*/

#include <iostream>

using namespace std;

class IP

{

private:

union

{

struct

{

unsigned char seg0;

unsigned char seg1;

unsigned char seg2;

unsigned char seg3;

};

unsigned int address;

};

public:

IP(int=0,int=0,int=0,int=0);

void showIP();

bool sameSubnet(const IP &ip,const IP &mark);

char whatKind();

};

IP::IP(int s0,int s1,int s2,int s3)

{

seg3=s0;

seg2=s1;

seg1=s2;

seg0=s3;

}

void IP::showIP()

{

cout<<int(seg3)<<"."<<int(seg2)<<"."<<int(seg1)<<"."<<int(seg0)<<endl;

return;

}

bool IP::sameSubnet(const IP &ip, const IP &mark)

{

unsigned int i1, i2;

i1=address&mark.address;

i2=ip.address&mark.address;

return (i1==i2);

}

char IP::whatKind()

{

if(seg3<128)

return 'A';

else if(seg3<192)

return 'B';

else if(seg3<224)

return 'C';

else if(seg3<240)

return 'D';

else

return 'E';

}

int main()

{

IP ip1(202,194,116,97),ip2(202,194,119,102),mark(255,255,248,0);

cout<<"ip1:";

ip1.showIP();

cout<<"ip2:";

ip2.showIP();

if(ip1.sameSubnet(ip2,mark))

cout<<"两个IP在同一个子网"<<endl;

else

cout<<"两个IP不在同一个子网"<<endl;

cout<<"ip1属于"<<ip1.whatKind()<<"类网络"<<endl;

return 0;

}

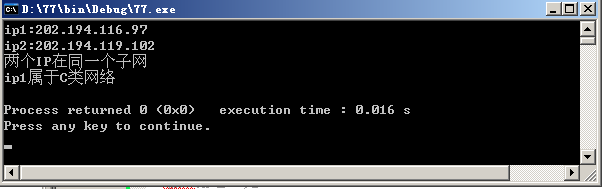

运行结果:

知识点总结:

进一步加深了对成员函数知识点的理解。

学习心得:

了解到了IP地址的有关知识。

219

219

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?