1 java安装

2 ssh无密码登陆

1,2在安装hadoop2.6.0的时候已经安装好。

3 spark安装包解压

4 spark配置文件配置

文件 conf/slaves:增加3个节点

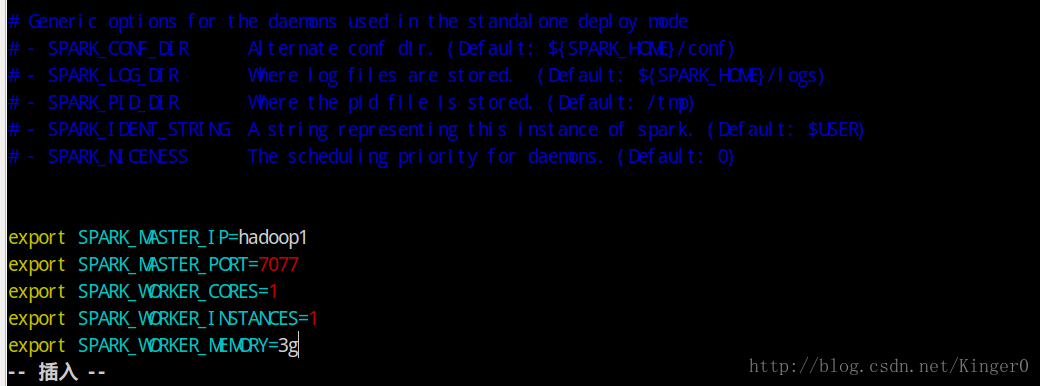

文件 conf/spark-env.sh:

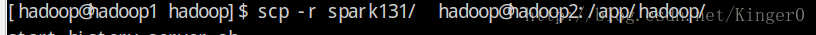

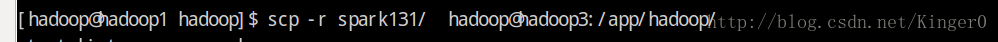

拷贝安装目录到hadoop2,hadoop3:

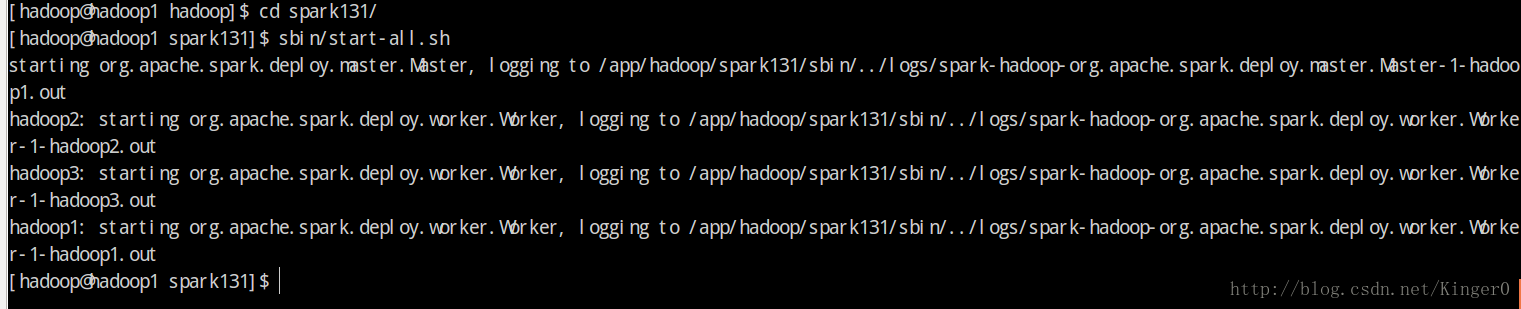

启动集群:

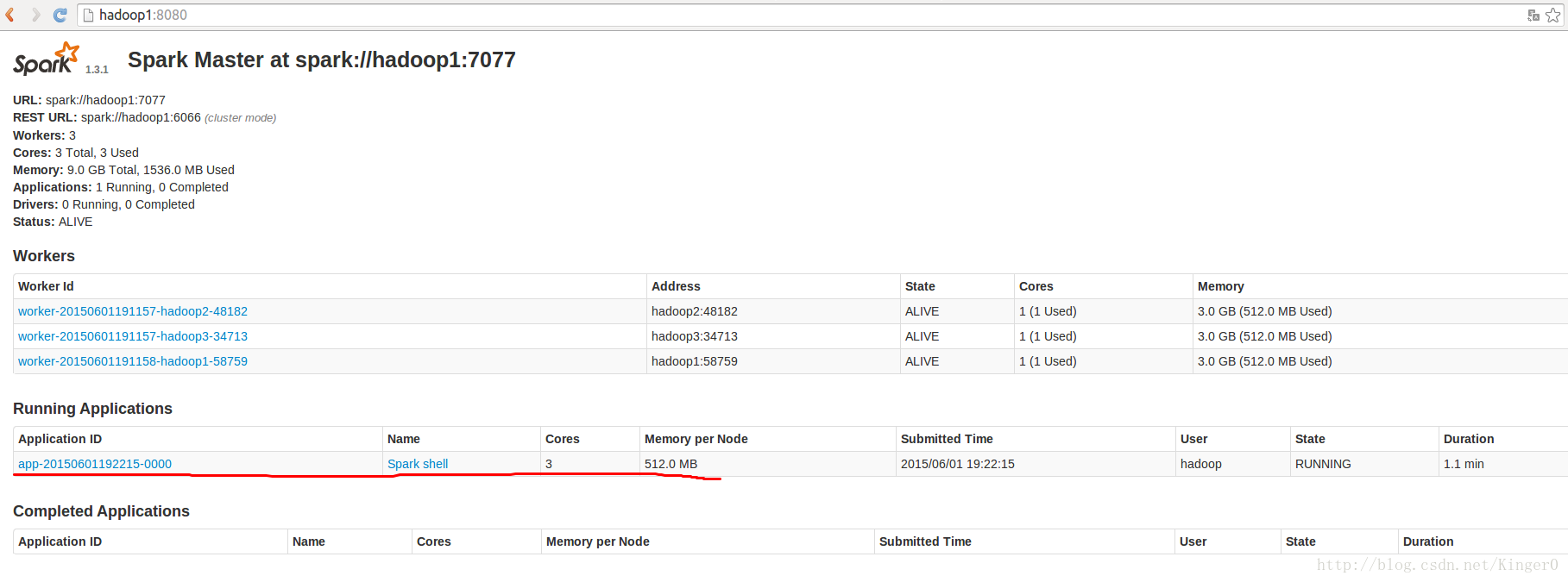

浏览器访问:

5 客户端安装

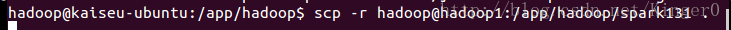

将hadoop1上的安装目录拷贝到客户端机器上:

测试:使用spark-shell

在浏览器中查看:

66

66

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?