Andrew NG 《machine learning》week 2,class6 —Parameter learning

本节主要讲述参数的拟合算法——即求出参数的算法。

6.1 Gradient Descent

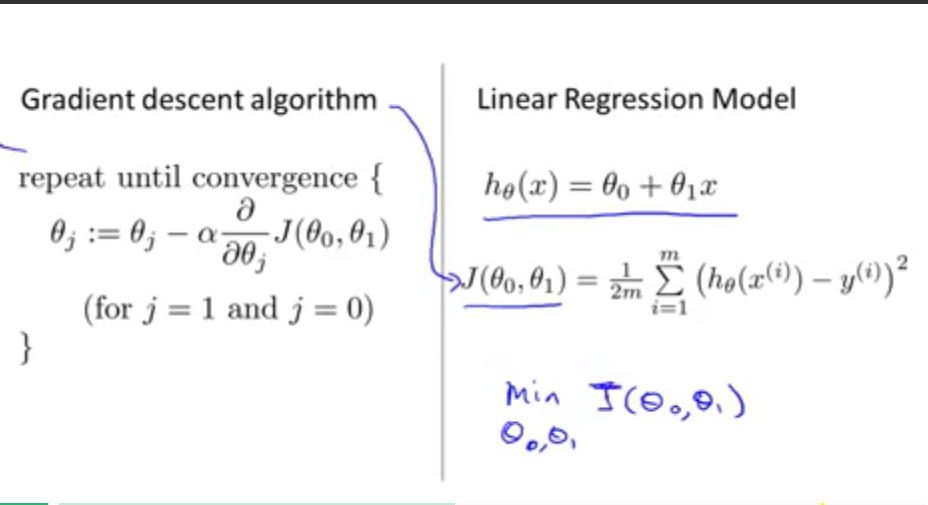

梯度下降的表达式如下图:

6.2 Gradient Descent Intuition

本小节将会讲述梯度下降函数的各项意义。

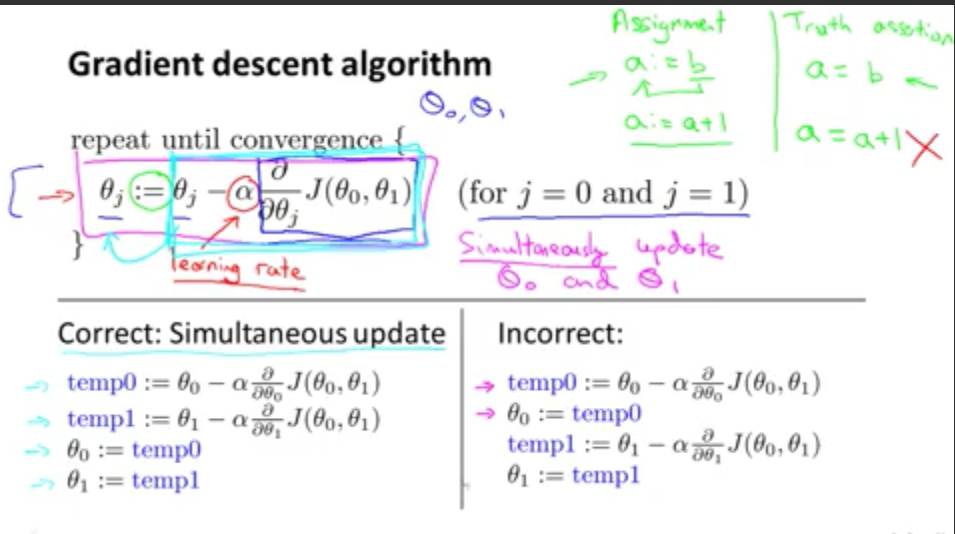

对于代价函数来说,学习效率的大小对函数是有影响的,当学习效率较大的时候,容易错过局部最小值,当学习效率值较小的时候,迭代的次数较多,速率较慢。

6.3 Gradient Descent For Linear Regression

上图展示了线性回归函数与梯度下降函数之间的关系,梯度下降函数是求解使代价函数达到最小值时的参数。求解时,主要是解决求导的问题。

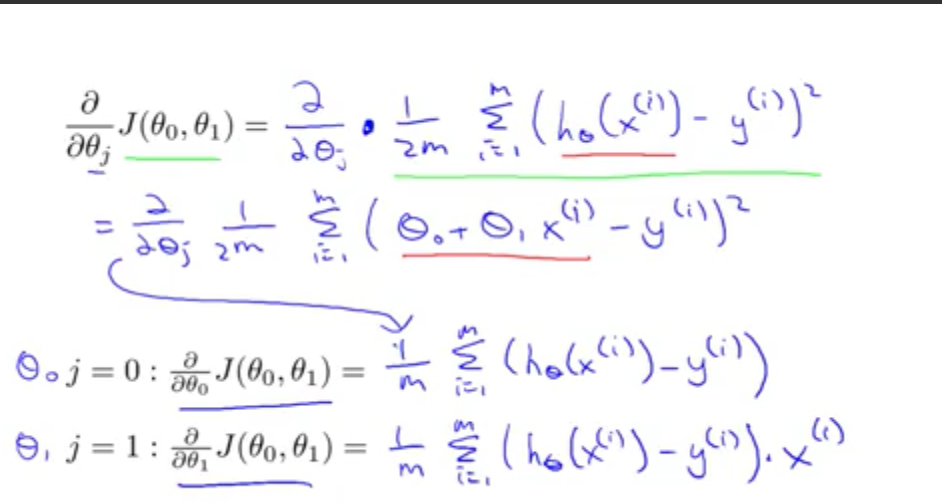

下图展示了代价函数求导之后的结果代入梯度下降函数之后的表达式。

之前说过,梯度下降函数只能求到代价函数的局部最小值,但是对于线性回归函数来说,由于线性回归函数是凸函数,所以只有一个局部最小值,同时也是全局最小值,所以用梯度下降函数求解线性回归函数的代价函数,能求出全局最小值。

500

500

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?