语音转成文字

科大讯飞语音识别技术,支持英文,中文,方言等。识别效率十分迅速,而且准确率官网能够达到97%以上。

在使用过程中,也确实发现,可以商用,或者利用其API进行开发。

使用场景,包含英语学习,单词朗读,语音评测等。

本文介绍如何使用 语音转成文字 的功能

Demo 地址:https://git.coding.net/Xoxo_x/IFlyDemo.git

使用讯飞的SDK,需要进行注册,并添加项目,其SDK与申请的APPID有关,不同的SDK和不同的APPID不能通用

本文的APPID:57d22af3

说明:该id没有被审核,每天使用次数有限

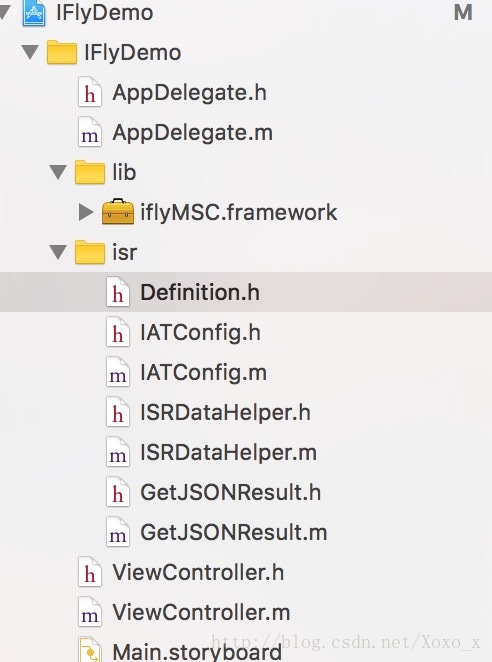

原demo中含有不必要的文件,这里进行了处理。

使用这几个文件,就可以进行语音识别了。

结构如下:

/**

语音听写demo

使用该功能仅仅需要四步

1.创建识别对象;

2.设置识别参数;

3.有选择的实现识别回调;

4.启动识别

*/

导入 #import “iflyMSC/iflyMSC.h”

//

// ViewController.h

// IFlyDemo

//

// Created by fsk-0-1-n on 17/2/21.

// Copyright © 2017年 Xoxo. All rights reserved.

//

#import <UIKit/UIKit.h>

#import "iflyMSC/iflyMSC.h"

@class IFlySpeechRecognizer;

@class IFlyPcmRecorder;

@interface ViewController : UIViewController<IFlySpeechRecognizerDelegate,IFlyRecognizerViewDelegate,IFlyPcmRecorderDelegate>

@property (nonatomic, strong) NSString *pcmFilePath;//音频文件路径

@property (nonatomic, strong) IFlySpeechRecognizer *iFlySpeechRecognizer;//不带界面的识别对象

@property (nonatomic, strong) NSString * result;

@property (nonatomic, assign) BOOL isCanceled;

@property (nonatomic,strong) IFlyPcmRecorder *pcmRecorder;//录音器,用于音频流识别的数据传入

@end

demo录音文件保存路径

- (void)viewDidLoad {

[super viewDidLoad];

NSArray *paths = NSSearchPathForDirectoriesInDomains(NSCachesDirectory, NSUserDomainMask, YES);

NSString *cachePath = [paths objectAtIndex:0];

_pcmFilePath = [[NSString alloc] initWithFormat:@"%@",[cachePath stringByAppendingPathComponent:@"asr.pcm"]];

}/**

设置识别参数

**/

-(void)initRecognizer

{

NSLog(@"%s",__func__);

//单例模式,无UI的实例

if (_iFlySpeechRecognizer == nil) {

_iFlySpeechRecognizer = [IFlySpeechRecognizer sharedIns

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

297

297

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?