首先这是我的一些个人的想法,我本人是一个机器学习方面的菜鸟,我的帖子都是记录一些我个人的想法,方便以后查看。

当然,如果能给别人以启发就算是意外的惊喜吧。

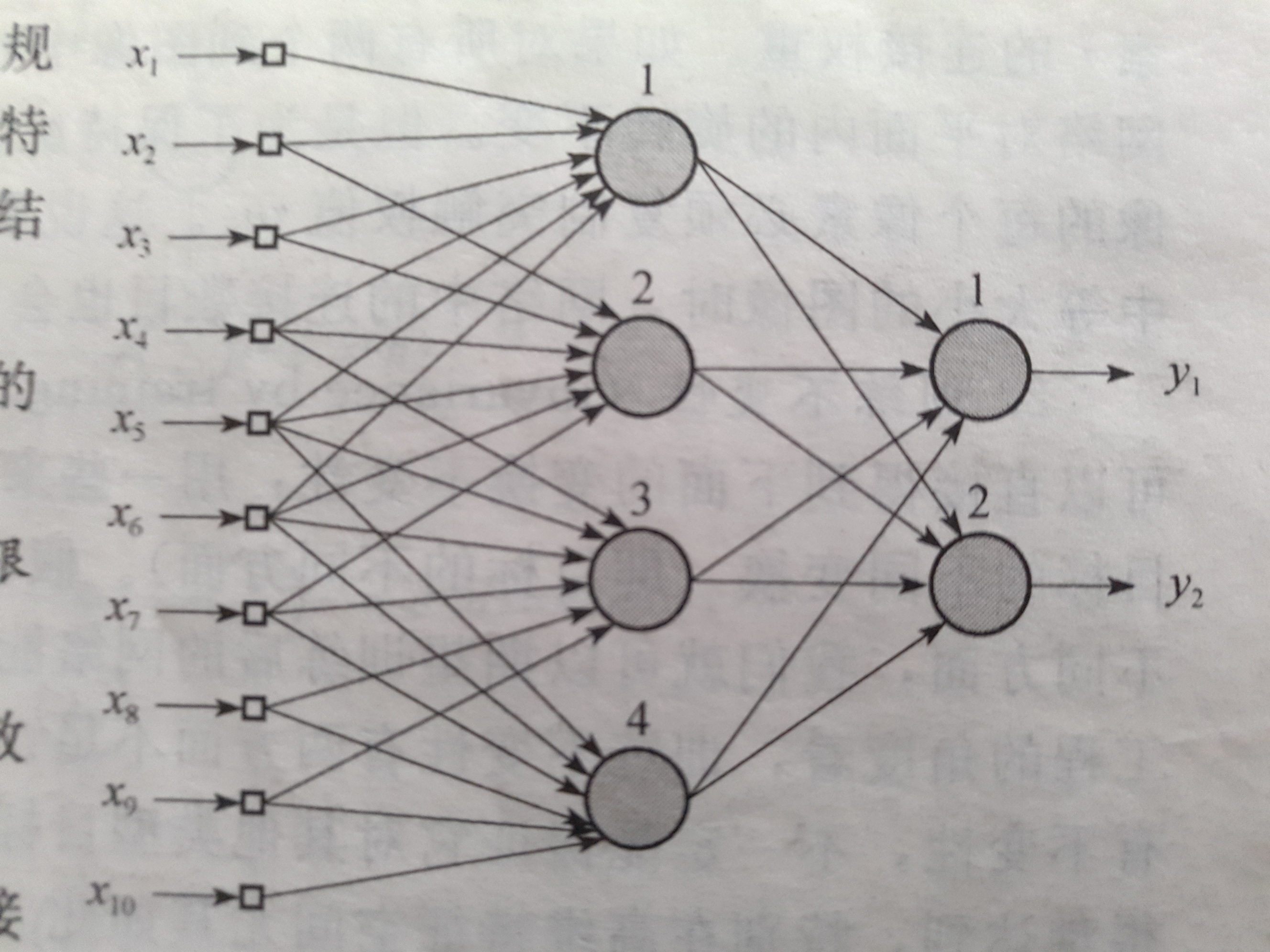

在学习机器学习的过程中caffe什么的是比较常用的东西,所以自然需要了解CNN相关的知识,了解网络结构。在请教师兄的时候我喜欢画这样结构图和他讨论,像这样:

从这个图的输入层可以看出来,这是一个部分连接的网络。

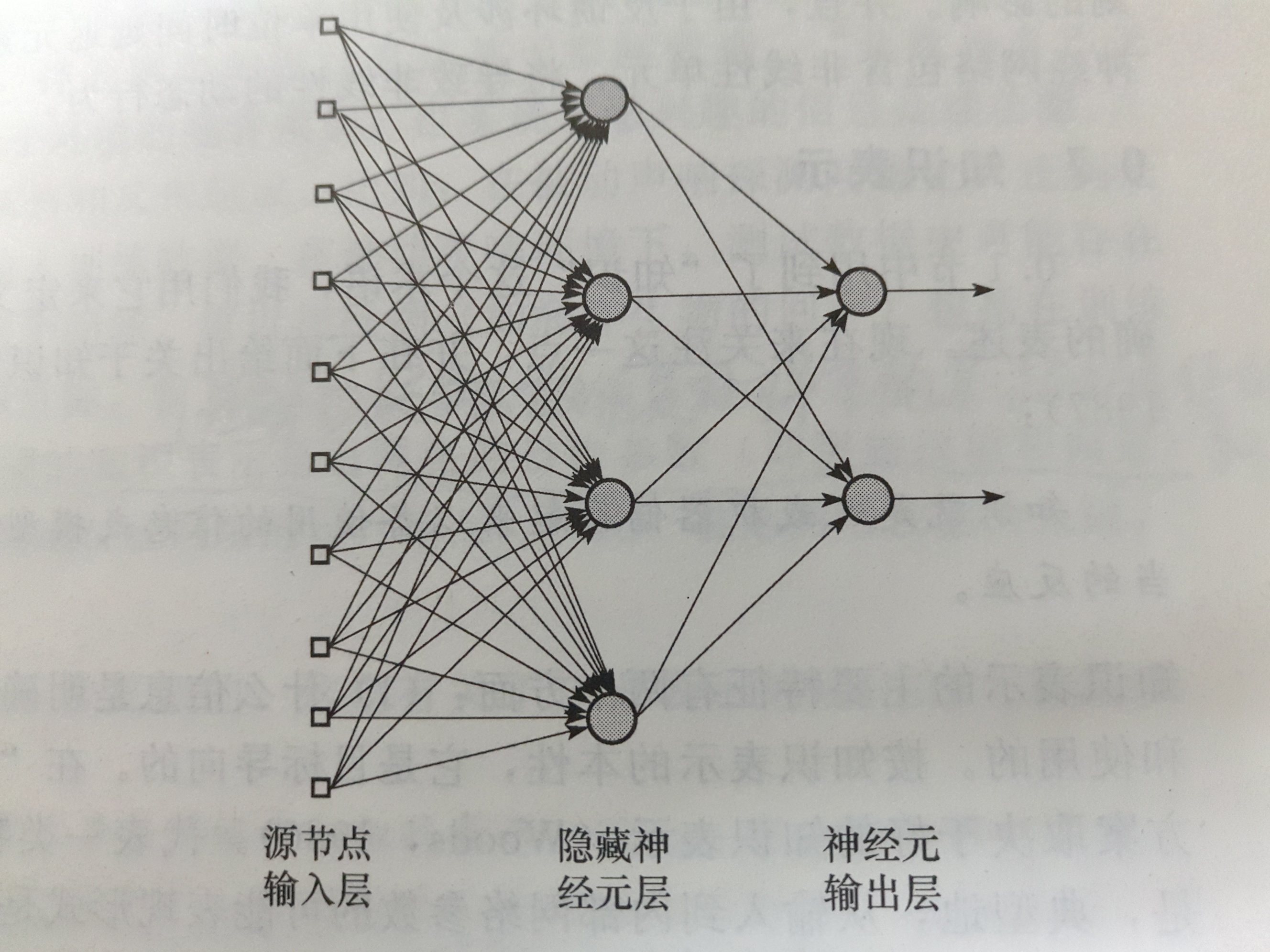

但是我之前和别人讨论都是画这样的图和别人说事,

而且突然有个想法,这不就是全连接吗,为啥要叫卷积层而不叫全连接层呢,这也是因为之前大神的帖子我老是很浮躁的看一看不琢磨其中的意义的后果。后来想了想事情应该是这样的,不知道是由于计算机的工作原理还是习惯问题,或者是我还没了解到的其它问题,图像处理中大家习惯用滑窗的形式来提取特征,在CNN中也不例外,但是在实际意义上,滑窗每移动一个位置就是一个新的神经元的输入(对应于所有的此刻训练的样本),这个输入乘以共同的系数w也就是卷积核内部的数据而后在按格式相加(每个样本的矩阵对其相加)重新构成一个二维矩阵后加上偏置经过激活函数(应该是对每个矩阵内的成员)便产生了一个输出,这些输出就够成了这一层的特征图像,而这些图像是该层神经元的所有输出,也就是到这里,第一层的计算已经结束。而该层的某一神经元所接收的输入源只是来自该层某一组共享权重的滤波器内的数据。所有对该层每一个神经元来算,其输入连接的只是所有滤波器中的相同权重的一部分,并不是像第二种图那样的全连接,但是正确的结构图真想不出来怎么画,回想那些论文,他们并不提供这种结构图,而是以层的形式给出网络结构的说明,是不是因为那个结构图确实不好表示?

而对于全连接层,其输入来着于所以上一层的输出,这与前面的卷积层差别很大。

第一次记录自己的想法,如果不幸被别人看到了,这只是我我个人的一些想法,只是我以为是这样的,不一定正确。如果大神发现其中的错误,请不吝赐教,多谢!

1820

1820

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?