在与客户沟通的时候,经常会有客户询问关于hadoop的安全问题。由于hadoop的底层的磁盘不做raid或者仅仅是做raid 0,客户认为磁盘损坏容易造成数据丢失。你跟客户阐述采用3副本机制,客户也会说:即使3副本也会有3块不同节点的磁盘同时损坏的可能啊!这时候我会跟客户举例子算一下三个不同节点的磁盘同时损坏的概率。

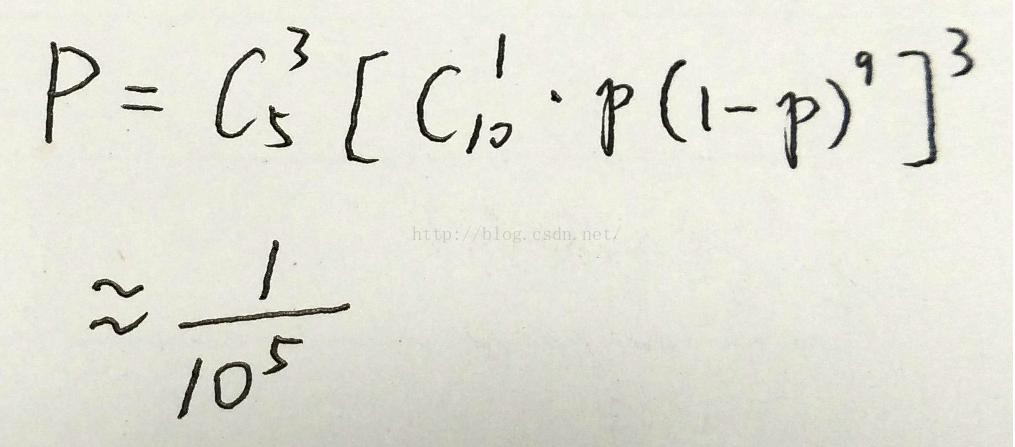

为了简单起见,我们假如数据节点上的文件都小于64MB,这样这些文件的每一个都在hdfs上仅有3个block块,分布在三个不同的数据节点中。假设磁盘在一年中某一天某一时刻损坏的概率是p=1/1000(非常保守的假设),总共有5个数据节点,每个数据节点10块磁盘,分布在三个不同数据节点的磁盘同时损坏的概率计算如下:

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3867

3867

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?