所有的服务器都已修改主机名、主机名IP对应、SSH免密登录、关闭防火墙,已安装JDK(主机名分别为app1、app2、app3、app4)

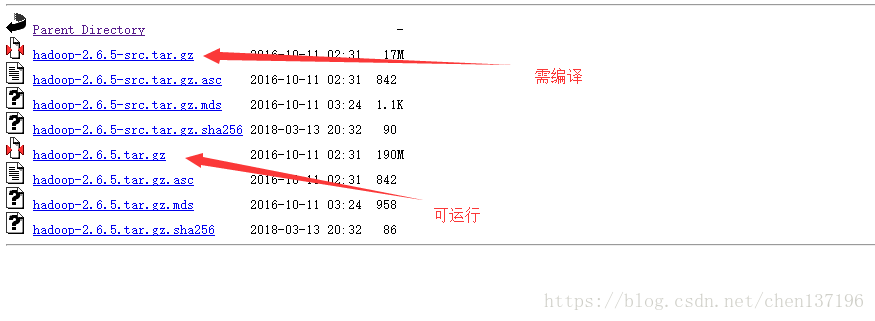

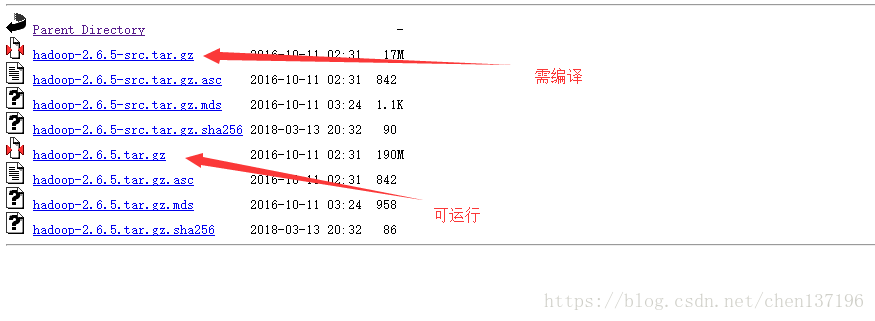

1、下载hadoop文件http://archive.apache.org/dist/hadoop/core/hadoop-2.6.5/

2、下载后,将Hadoop上传至其中一台机器

3、解压

tar -zxvf hadoop-2.6.5.tar.gz -C /opt

4、进入文件夹

/opt/hadoop/hadoop-2.6.5/etc/hadoop

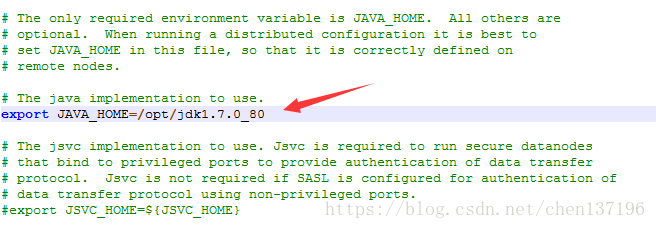

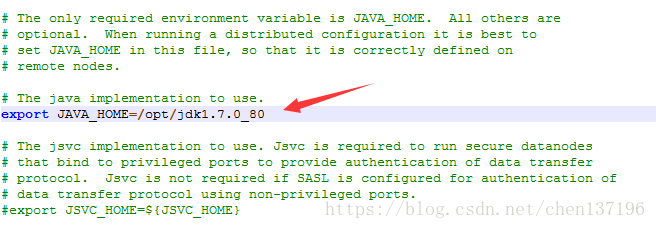

5、修改hadoop-env.sh

vi hadoop-env.sh

修改:export JAVA_HOME=/opt/jdk1.7.0_80(大概25行)

6、修改core-site.xml

vi core-site.xml

修改configuration标签体的内容

<configuration>

<!-- 指定HADOOP所使用的文件系统schema(URI),HDFS的老大(NameNode)的地址 -->

<property>

<name>fs.defaultFS</name>

<value>hdfs://app4:9000</value>

</property>

<!-- 指定hadoop运行时产生文件的存储目录 -->

<property>

<name>hadoop.tmp.dir</name>

<value>/home/hdpdata</value>

</property>

</configuration>

7、修改hdfs-site.xml

vi hdfs-site.xml

修改configuration标签体的内容

<configuration>

<!-- 指定HDFS副本的数量 -->

<property>

<name>dfs.replication</name>

<value>3</value>

</property>

<property>

<name>dfs.secondary.http.address</name>

<value>app4:50090</value>

</property>

</configuration>

备注:如果在配置过程有需要将namenode、datanode分不同的磁盘存储(服务器可能会挂载多个磁盘),则可以使用以下配置

namenode配置:

<property>

<name>dfs.name.dir</name>

<value>/pvdata/hadoopdata/name/,/opt/hadoopdata/name/</value>

</property>

datanode配置:

<property>

<name>dfs.data.dir</name>

<value>/dev/sda3/hadoopdata/,/dev/sda1/hadoopdata/</value>

</property>

8、修改mapred-site.xml

mv mapred-site.xml.template mapred-site.xml

修改configuration标签体的内容

<configuration>

<!-- 指定mr运行在yarn上 -->

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

</configuration>

9、修改yarn-site.xml

vi yarn-site.xml

修改configuration标签体的内容

<configuration>

<!-- 指定YARN的老大(ResourceManager)的地址 -->

<property>

<name>yarn.resourcemanager.hostname</name>

<value>app4</value>

</property>

<!-- reducer获取数据的方式 -->

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

</configuration>

10、分发

scp -r hadoop root@app1:/opt/

scp -r hadoop root@app2:/opt/

scp -r hadoop root@app3:/opt/

11、配置环境变量

vi /etc/profile

修改为:

JAVA_HOME=/opt/jdk1.7.0_80

HADOOP_HOME=/opt/hadoop/hadoop-2.6.5

CLASS_PATH=.:$JAVA_HOME/lib/dt.jar:$JAVA_HOME/lib/tools.jar

PATH=$JAVA_HOME/bin:$HADOOP_HOME/bin:$HADOOP_HOME/sbin:$PATH

export JAVA_HOME HADOOP_HOME CLASS_PATH PATH

12、格式化namenode

hadoop namenode -format

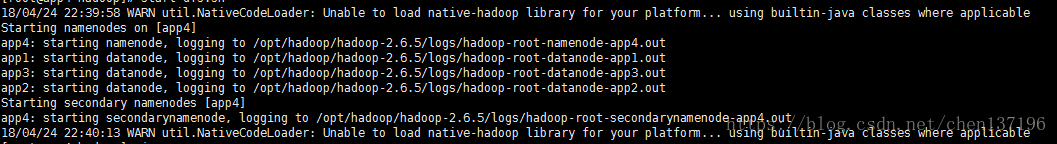

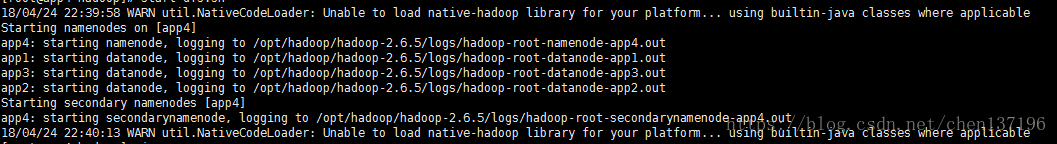

13、启动hdfs

start-dfs.sh

启动过程中:

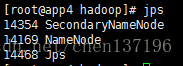

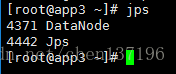

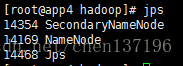

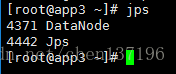

查看启动是否成功jps

namenode显示(此例子的主机名为app4)

datanode显示(此例子中主机名为app1、app2、app3)

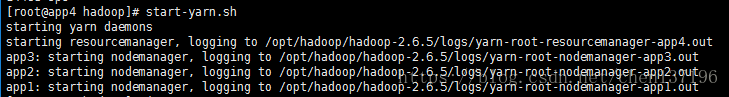

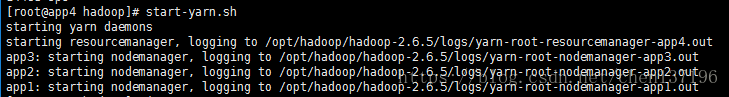

14、启动yarn

start-yarn.sh

启动过程中:

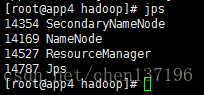

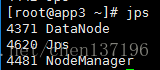

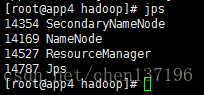

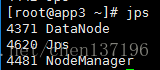

查看启动是否成功jps

namenode显示(此例子的主机名为app4)

datanode显示(此例子中主机名为app1、app2、app3)

1、下载hadoop文件http://archive.apache.org/dist/hadoop/core/hadoop-2.6.5/

2、下载后,将Hadoop上传至其中一台机器

3、解压

tar -zxvf hadoop-2.6.5.tar.gz -C /opt

4、进入文件夹

/opt/hadoop/hadoop-2.6.5/etc/hadoop

5、修改hadoop-env.sh

vi hadoop-env.sh

修改:export JAVA_HOME=/opt/jdk1.7.0_80(大概25行)

6、修改core-site.xml

vi core-site.xml

修改configuration标签体的内容

<configuration>

<!-- 指定HADOOP所使用的文件系统schema(URI),HDFS的老大(NameNode)的地址 -->

<property>

<name>fs.defaultFS</name>

<value>hdfs://app4:9000</value>

</property>

<!-- 指定hadoop运行时产生文件的存储目录 -->

<property>

<name>hadoop.tmp.dir</name>

<value>/home/hdpdata</value>

</property>

</configuration>

7、修改hdfs-site.xml

vi hdfs-site.xml

修改configuration标签体的内容

<configuration>

<!-- 指定HDFS副本的数量 -->

<property>

<name>dfs.replication</name>

<value>3</value>

</property>

<property>

<name>dfs.secondary.http.address</name>

<value>app4:50090</value>

</property>

</configuration>

备注:如果在配置过程有需要将namenode、datanode分不同的磁盘存储(服务器可能会挂载多个磁盘),则可以使用以下配置

namenode配置:

<property>

<name>dfs.name.dir</name>

<value>/pvdata/hadoopdata/name/,/opt/hadoopdata/name/</value>

</property>

datanode配置:

<property>

<name>dfs.data.dir</name>

<value>/dev/sda3/hadoopdata/,/dev/sda1/hadoopdata/</value>

</property>

8、修改mapred-site.xml

mv mapred-site.xml.template mapred-site.xml

修改configuration标签体的内容

<configuration>

<!-- 指定mr运行在yarn上 -->

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

</configuration>

9、修改yarn-site.xml

vi yarn-site.xml

修改configuration标签体的内容

<configuration>

<!-- 指定YARN的老大(ResourceManager)的地址 -->

<property>

<name>yarn.resourcemanager.hostname</name>

<value>app4</value>

</property>

<!-- reducer获取数据的方式 -->

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

</configuration>

10、分发

scp -r hadoop root@app1:/opt/

scp -r hadoop root@app2:/opt/

scp -r hadoop root@app3:/opt/

11、配置环境变量

vi /etc/profile

修改为:

JAVA_HOME=/opt/jdk1.7.0_80

HADOOP_HOME=/opt/hadoop/hadoop-2.6.5

CLASS_PATH=.:$JAVA_HOME/lib/dt.jar:$JAVA_HOME/lib/tools.jar

PATH=$JAVA_HOME/bin:$HADOOP_HOME/bin:$HADOOP_HOME/sbin:$PATH

export JAVA_HOME HADOOP_HOME CLASS_PATH PATH

12、格式化namenode

hadoop namenode -format

13、启动hdfs

start-dfs.sh

启动过程中:

查看启动是否成功jps

namenode显示(此例子的主机名为app4)

datanode显示(此例子中主机名为app1、app2、app3)

14、启动yarn

start-yarn.sh

启动过程中:

查看启动是否成功jps

namenode显示(此例子的主机名为app4)

datanode显示(此例子中主机名为app1、app2、app3)

790

790

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?