转自:http://blog.csdn.net/zhangjunhit/article/details/53218211

NIPS 2016 http://arxiv.org/abs/1608.04493

code: https://github.com/yiwenguo/Dynamic-Network-Surgery

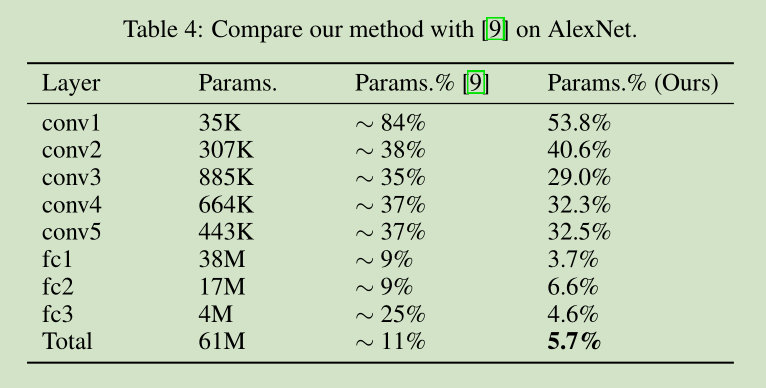

文章是以Song Han,2015年的一篇文章文参考文献的,参考文献提出了一种 网络剪枝(network pruning)算法,可以在保持数据表示能力的前提下,将深度网络中的学习参数压缩10倍以上 ;Song Han在2016年也发表了一篇关于模型压缩的文章并且获得了ICLR 2016 best paper(见上一篇博客) 【9】Learning both Weights and Connections for Efficient Neural Networks Song Han, Jeff Pool, John Tran, and William J.Dally: “http://arxiv.org/abs/1506.02626”

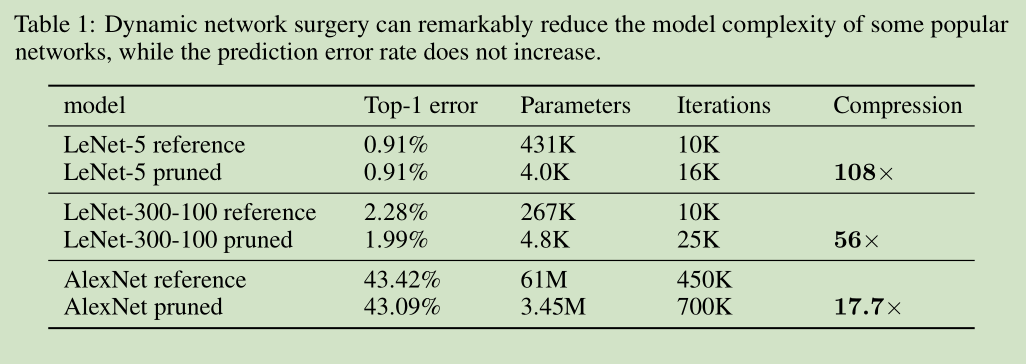

本文提出一种动态压缩CNN网络模型算法。针对 LeNet-5 和 AlexNet 可以分别减少 108倍和 17.7倍的参数,而且不损失精度。

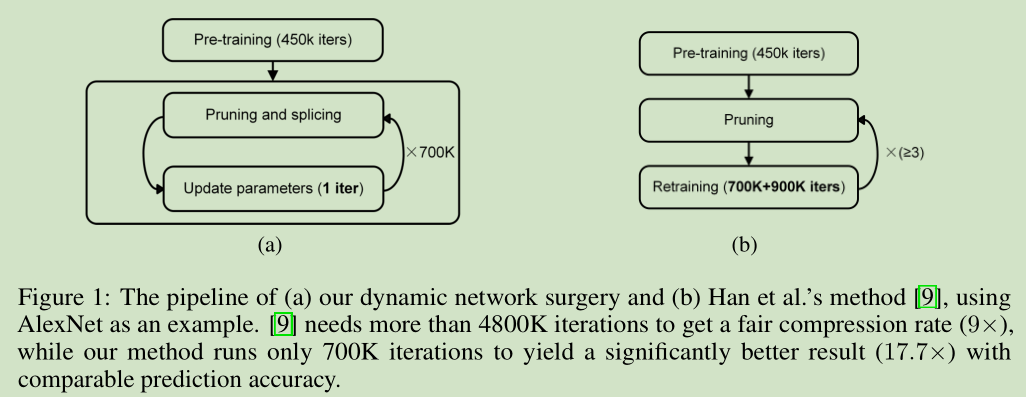

本文主要参考了文献【9】,文献【9】通过删除一些不重要的参数达到不损失精度的压缩CNN模型的效果。但是参数的重要性随着网络的变化而变化,所以导致了文献【9】有两个问题:1)有可能把重要的联系删除,导致精度下降,因为一旦删除就难以恢复。2)训练很费时间。

本文提出了 pruning 和 splicing 来解决文献【9】的问题。其中 splicing 主要是来解决删除重要的连接,就是把已经删除的重要连接恢复回来。

本文的流程和文献【9】的流程对比:

3 Dynamic Network Surgery

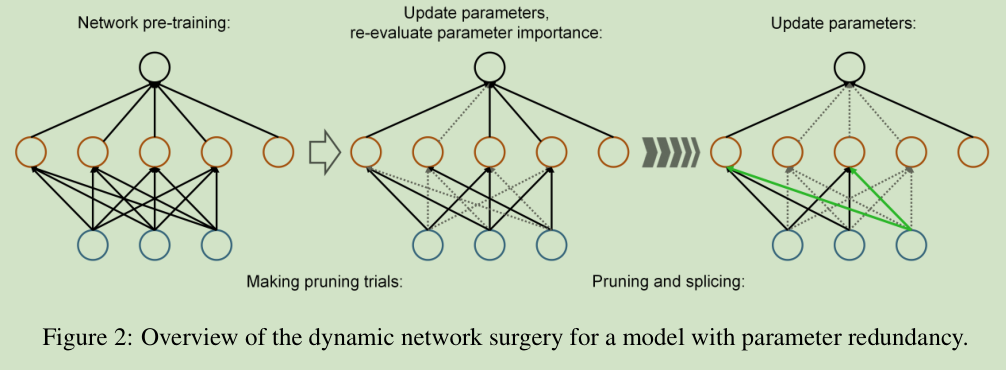

动态网络外科手术的示意图如下所示:

这里我们用 W_k 表示CNN网络参数矩阵, 二值矩阵 T_k 表示 W_k 对应的项是否被删除。

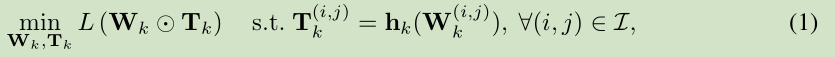

由于在删除一些网络的连接,会导致网络其他连接的重要性发生改变,所以通过优化最小损失函数来训练删除后的网络比较合适。

优化问题表达如下:

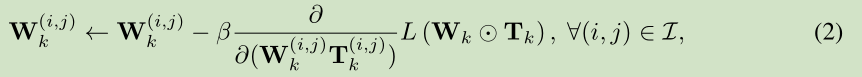

参数迭代如下:

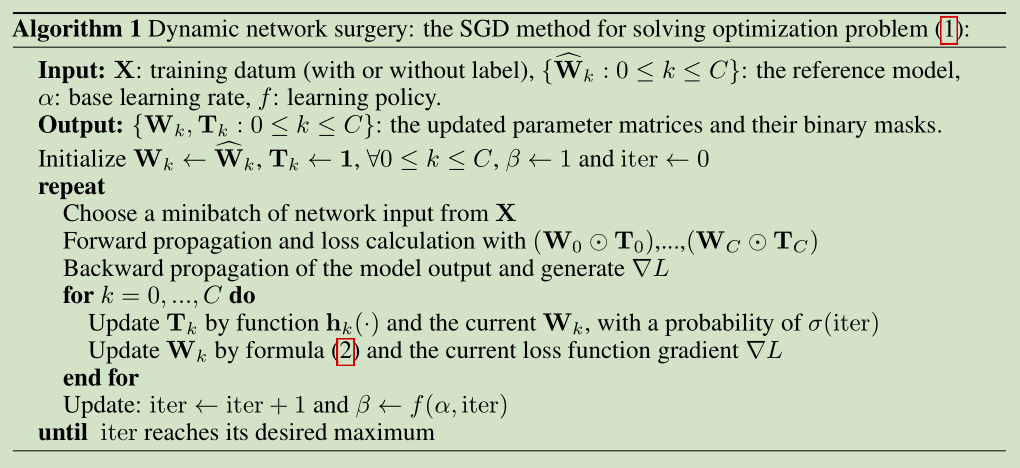

算法流程如下:

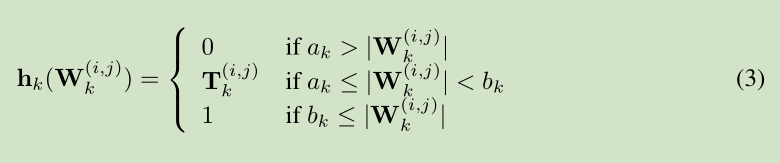

3.3 Parameter Importance

其中用于表示网络连接的重要性 h 函数定义如下:

3.4 Convergence Acceleration

为了加快训练速度,我们采用以下两个策略:

1)减少删除连接的概率,因为删除连接导致网络发生变化,导致训练难以收敛

2)卷积层和全链接层分开删裁连接,类似于文献【9】

4 Experimental Results

该算法采取了剪枝与嫁接相结合、训练与压缩相同步的策略完成网络压缩任务。通过网络嫁接操作的引入,避免了错误剪枝所造成的性能损失,从而在实际操作中更好地逼近网络压缩的理论极限。

437

437

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?