准备工作

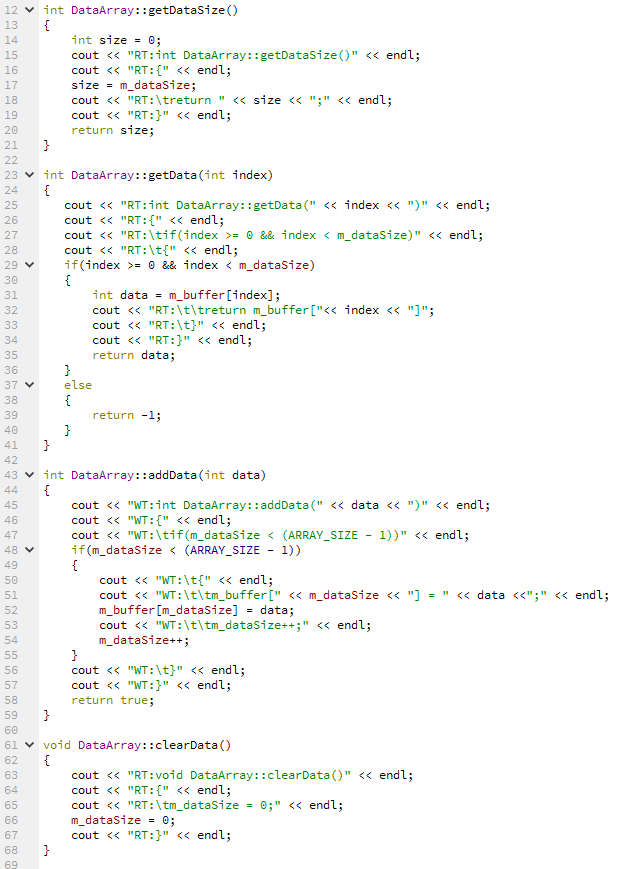

要理解前一篇文章中的问题是如何发生的,需要继续改造例子程序。增加程序执行过程中细节的输出。

单任务时执行结果

WT:<<<<WriteData:4<<<<

WT:int DataArray::addData(0)

WT:{

WT: if(m_dataSize < (ARRAY_SIZE - 1))

WT: {

WT: m_buffer[0] = 0;

WT: m_dataSize++;

WT: }

WT:}

WT:int DataArray::addData(1)

WT:{

WT: if(m_dataSize < (ARRAY_SIZE - 1))

WT: {

WT: m_buffer[1] = 1;

WT: m_dataSize++;

WT: }

WT:}

WT:int DataArray::addData(2)

WT:{

WT: if(m_dataSize < (ARRAY_SIZE - 1))

WT: {

WT: m_buffer[2] = 2;

WT: m_dataSize++;

WT: }

WT:}

WT:int DataArray::addData(3)

WT:{

WT: if(m_dataSize < (ARRAY_SIZE - 1))

WT: {

WT: m_buffer[3] = 3;

WT: m_dataSize++;

WT: }

WT:}

WT:int DataArray::addData(4)

WT:{

WT: if(m_dataSize < (ARRAY_SIZE - 1))

WT: {

WT: m_buffer[4] = 4;

WT: m_dataSize++;

WT: }

WT:}

RT:>>>>ReadData:4>>>>

RT:int DataArray::getDataSize()

RT:{

RT: return 5;

RT:}

RT::----data_size=5

RT:int DataArray::getData(0)

RT:{

RT: if(index >= 0 && index < m_dataSize)

RT: {

RT: return m_buffer[0];, value =0

RT: }

RT:}

RT:int DataArray::getData(1)

RT:{

RT: if(index >= 0 && index < m_dataSize)

RT: {

RT: return m_buffer[1];, value =1

RT: }

RT:}

RT:int DataArray::getData(2)

RT:{

RT: if(index >= 0 && index < m_dataSize)

RT: {

RT: return m_buffer[2];, value =2

RT: }

RT:}

RT:int DataArray::getData(3)

RT:{

RT: if(index >= 0 && index < m_dataSize)

RT: {

RT: return m_buffer[3];, value =3

RT: }

RT:}

RT:int DataArray::getData(4)

RT:{

RT: if(index >= 0 && index < m_dataSize)

RT: {

RT: return m_buffer[4];, value =4

RT: }

RT:}

RT:----total=10

上面的输出只是写五个数,读五个数的部分,但是可以看出写数据处理(WT)

完全结束以后,读数据处理(RT)才开始执行。这是数据处理正确进行的必要条件,记住这一点。

多任务(线程)条件下的执行结果

RT:>>>>ReadData:WT:<<<<WriteData:0<<<<

WT:int DataArray::addData(0)

WT:{

WT: if(m_dataSize < (ARRAY_SIZE - 1))

WT: {

WT: m_buffer[0] = 0;

WT: m_dataSize++;

WT: }

WT:}

WT:int DataArray::addData(1)

WT:{

WT: if(m_dataSize < (ARRAY_SIZE - 1))

WT: {

WT: m_buffer[1] = 1;

WT: m_dataSize++;

WT: }

WT:}

WT:int DataArray::addData(2)

WT:{

WT: if(m_dataSize < (ARRAY_SIZE - 1))

WT: {

WT: m_buffer[2] = 2;

WT: m_dataSize++;

WT: }

WT:}

WT:int DataArray::addData(3)

WT:{

WT: if(m_dataSize < (ARRAY_SIZE - 1))

WT: {

WT: m_buffer[3] = 3;

WT: m_dataSize++;

WT: }

WT:}

WT:int DataArray::addData(4)

WT:{

WT: if(m_dataSize < (ARRAY_SIZE - 1))

WT: {

WT: m_buffer[4] = 4;

WT: m_dataSize++;

WT: }

WT:}

WT:<<<<WriteData:1<<<<

WT:int DataArray::addData(0)

WT:{

WT: if(m_dataSize < (ARRAY_SIZE - 1))

0>>>>

RT:int DataArray::getDataSize()

RT:{

RT: return 5;

RT:}

RT::----data_size=5

RT:int DataArray::getData(0)

RT:{

RT: if(index >= 0 && index < m_dataSize)

RT: {

RT: return m_buffer[0]RT: }

RT:}

RT:int DataArray::getData(1)

RT:{

RT: if(index >= 0 && index < m_dataSize)

RT: {

RT: return m_buffer[1]RT: }

RT:}

RT:int DataArray::getData(2)

RT:{

RT: if(index >= 0 && index < m_dataSize)

RT: {

RT: return m_buffer[2]RT: }

RT:}

RT:int DataArray::getData(3)

RT:{

RT: if(index >= 0 && index < m_dataSize)

WT: {

WT: m_buffer[5] = 0;

WT: m_dataSize++;

WT: }

WT:}

WT:int DataArray::addData(1)

WT:{

WT: if(m_dataSize < (ARRAY_SIZE - 1))

WT: {

WT: m_buffer[6] = 1;

WT: m_dataSize++;

WT: }

WT:}

如果程序可以看出写数据处理和读数据处理随机交替进行,执行结果会怎么样没有人能说清楚。另外,如果涉及内存处理,则经常会出现内存破坏而导致死机等各种问题。而且由于任务切换的随机性,问题的发生也是随机的,这可能是多任务编程最大的难点。

需要说明的是,实际上操作系统是在机器语言层次进行线程调度,所以说本例只能说是示意性的说明。但从理解正在发生什么的角度来讲已经足够了。

写在文章的最后

既然已经读到这里了,拜托大家再用一分钟时间,将文章转发到各位的朋友圈,微信群中。

406

406

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?