机器学习 逻辑回归

这里所写的是逻辑0,1分类的问题,即二分法。

与线性回归的 least square不同的是,逻辑回归对概率进行假设。

由于概率是在0,1之间

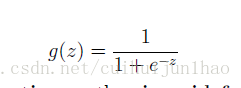

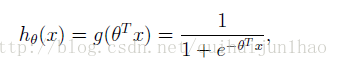

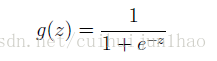

借助于公式

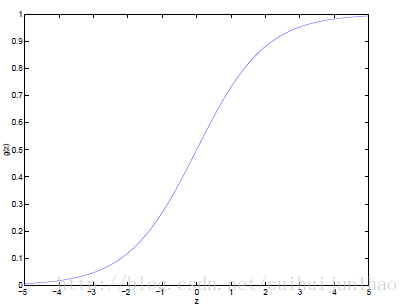

这个函数的名称为logistic function 因为这个函数的上限和下限就是在0,1之间,函数曲线如图

其实我们观察这个图的话,发现很像正太分布函数的F(x)函数图。

一个需要考虑的问题是:我们什么情况用这样的模型?

答案是:当我们对参数进行分类的时候,我们会用这个函数

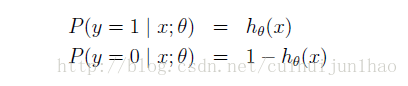

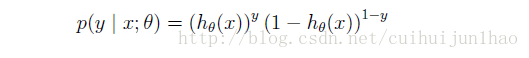

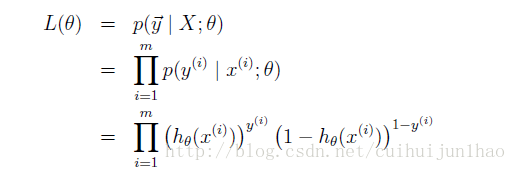

这样我们就可以定义关于概率的变量

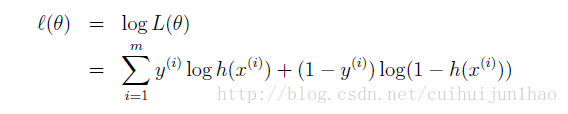

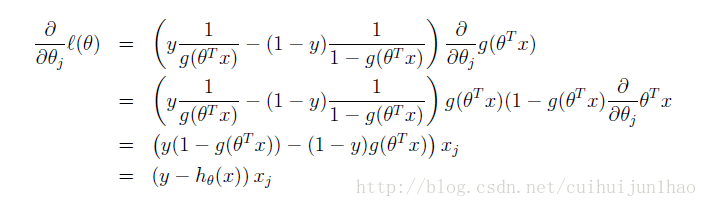

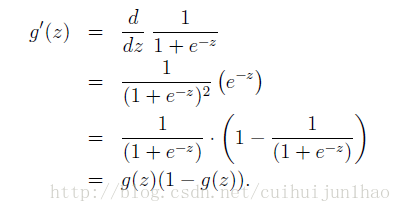

对似然函数求导的过程,需要明白这样的一个导数过程

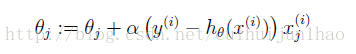

有了似然函数求导,我们就可以用随机梯度下降方法,原理同线性回归

但是不同于 least square方法,我们在这里可以看到,是加a,这是因为我们是假设概率,求概率最大值,所以是加上a。

综合上述,逻辑回归大体的思路是:

对于分类问题,

1.我们给y值0,1两种值,

2.然后用logistic function来表示概率,之后

3.然后表述出概率(伯努利函数),然后用梯度随机上升方法,在训练集中不断地更新 theter值。

老铁你看到这了,就扫以下我得支付宝红包把

330

330

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?