Spark 集群环境搭建(standalone)

2017年11月5日,星期日

19:11

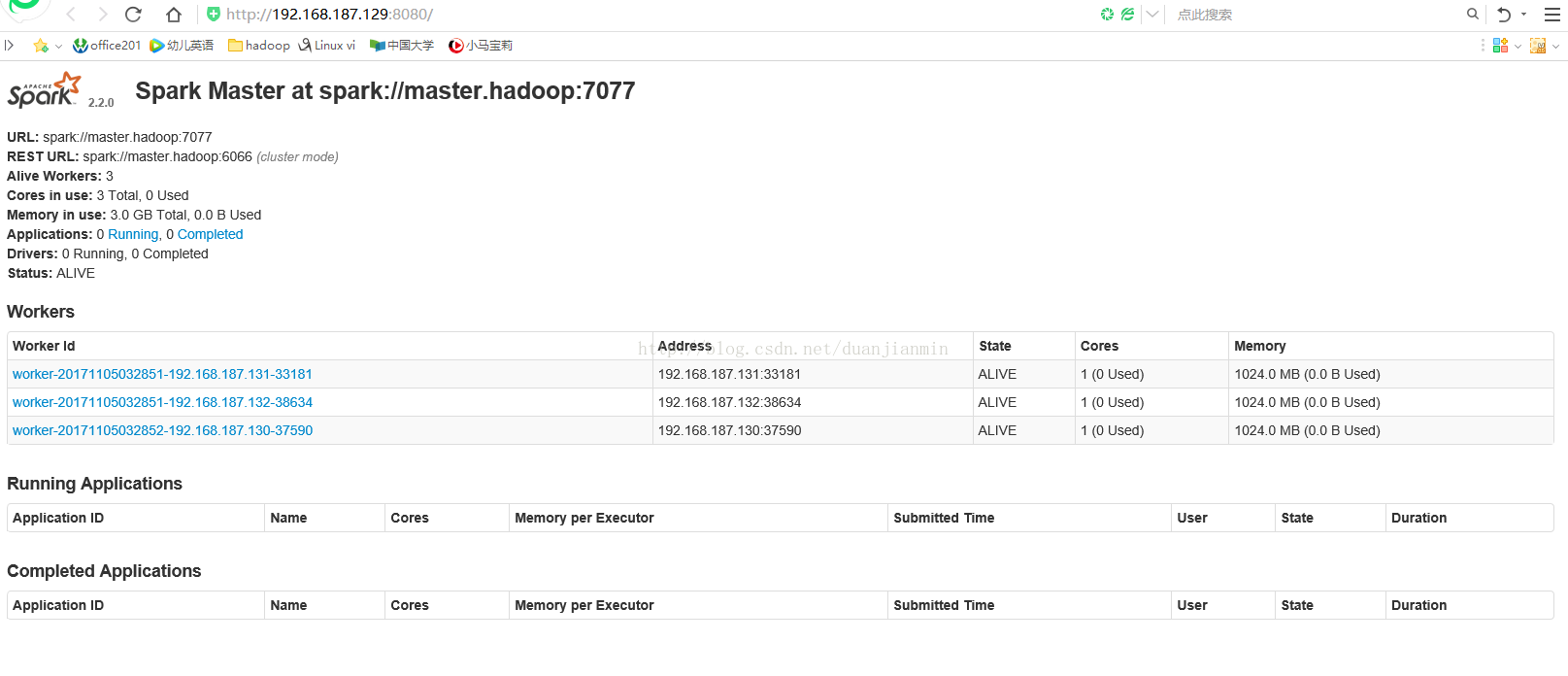

接上文hdfs集群搭建,我分别在四个node(一个master.hadoop 三个slave node)上搭建spark集群,这个集群是standalone模式。

spark集群安装也需要配置无密码登录,因为我之前安装hadoop时已经安装过了,所以这次就不用在重新配置了。

安装步骤

-

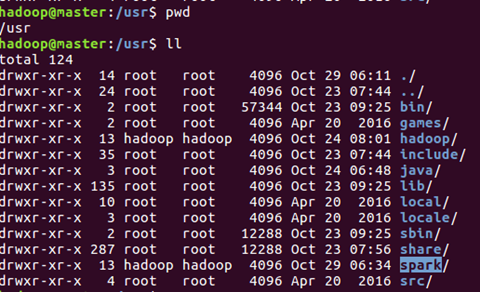

下载spark安装包 spark-2.2.0-bin-hadoop2.7 解压缩到/usr 下面

注意解压缩后修改文件夹名字为 spark

-

配置spark配置文件

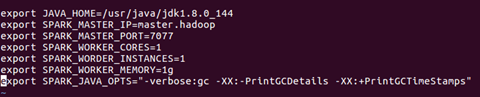

spark-env.sh

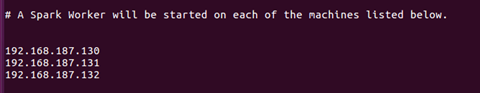

slaves 文件

在slaves机器上依次执行以上两个步骤以完成spark的安装

-

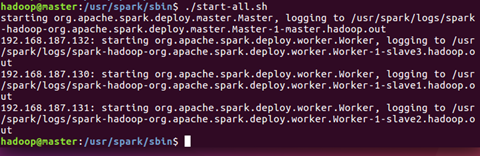

启动集群

至此spark集群搭建成功

5万+

5万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?