AdaBoost是最有代表性的提升算法之一。其基本思想可以表述为:多个专家的综合判断,要优于任意一个专家的判断。

1、什么是提升算法?

“装袋”(bagging)和“提升”(boost)是构建组合模型的两种最主要的方法,所谓的组合模型是由多个基本模型构成的模型,组合模型的预测效果往往比任意一个基本模型的效果都要好。

装袋:每个基本模型由从总体样本中随机抽样得到的不同数据集进行训练得到,通过重抽样得到不同训练数据集的过程称为装袋。

提升:每个基本模型训练时的数据集采用不同权重,针对上一个基本模型分类错误的样本增加权重,使得新的模型重点关注误分类样本。

2、AdaBoost算法的过程?

AdaBoost是AdaptiveBoost的缩写,表明该算法是具有适应性的提升算法。

算法的步骤如下:

1)给每个训练样本(x1,x2,….,xN)分配权重,初始权重w1均为1/N。

2)针对带有权值的样本进行训练,得到模型Gm(初始模型为G1)。

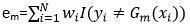

3)计算模型Gm的误分率

4)计算模型Gm的系数αm=0.5log[(1-em)/em]

5)根据误分率e和当前权重向量wm更新权重向量wm+1。

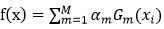

6)计算组合模型

7)当组合模型的误分率或迭代次数低于一定阈值,停止迭代;否则,回到步骤2)。

3、AdaBoost算法的误差?

随着迭代次数的增加,AdaBoost的误差上限会不断减小,表明提升算法对于降低误分率是有效的。

4、提升树算法?

提升树是指基本模型是分类树或者回归树的提升组合模型,提升树被认为是统计学习中性能最好的模型之一。

9672

9672

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?