做实验前需要使用双网卡的主机

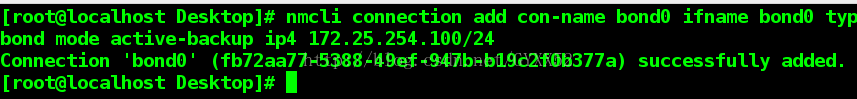

nmcli connection add con-name bond0 ifname bond0 type bond mode active-backup ip4 172.25.254.100/24 添加bond0

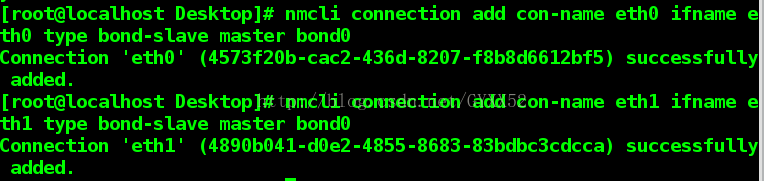

nmcli connection add con-name eth0 ifname eth0 type bond-slave master bond0

nmcli connection add con-name eth1 ifname eth1 type bond-slave master bond0

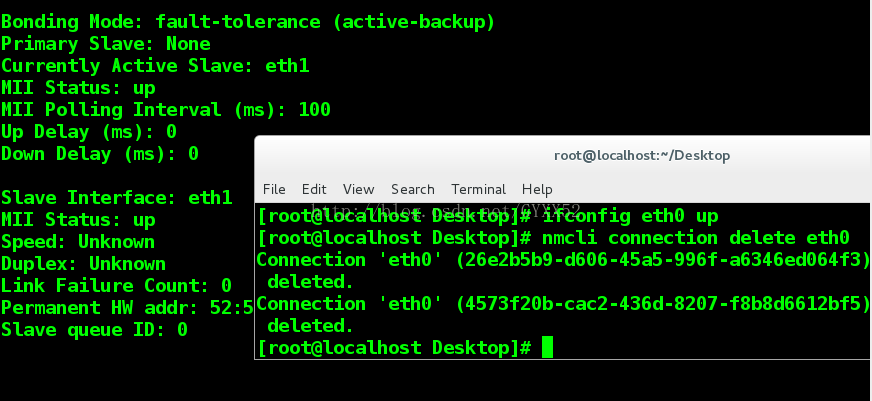

监控命令 watch -n 1 cat/proc/net/bonding/bond0

在监控下可以明显看到执行命令后的效果

2.team

是链路聚合的一种方式

最多支持八块网卡

设置team

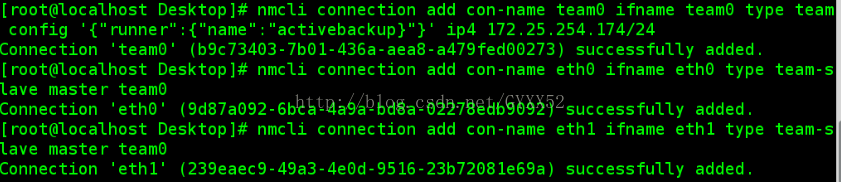

nmcli connection add com-name team0 ifname team0 type team config '{"runner":"activebackup"}}' ip4 172.25.254.174/24

nmcli connection add con-name eth0 ifname eth0 type team-slave master team0

nmcli connection add con-name eth1 ifname eth1 type team-slave master team0

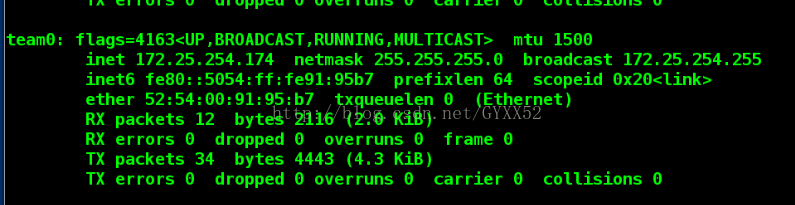

ifconfig 查看team0是否建立

3.br0

想给哪块物理网卡添加网桥就配置哪个物理网卡的配置文件

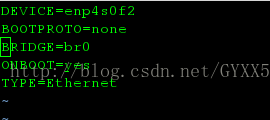

vim /etc/sysconfig/network-scripts/ifcfg-enp4s0f2

DEVICE=enp4s0f2

BOOTPROTO=yes

ONBOOT=yes

BRIDGE=br0 网卡开启网桥接口

vim /etc/sysconfig/network-scripts/ifcfg-br0

DEVICE=br0

ONBOOT=yes

BOOTPROTO=yes

IPADDR=172.25.254.74

NETMASK=255.255.255.0

TYPE=Bridge 网络接口类型为桥接

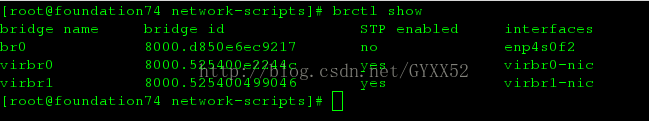

配置完之后重启网络就可以看到桥接

systemctl stop NetworkManager

systemctl restart network

systemctl start NetworkManager

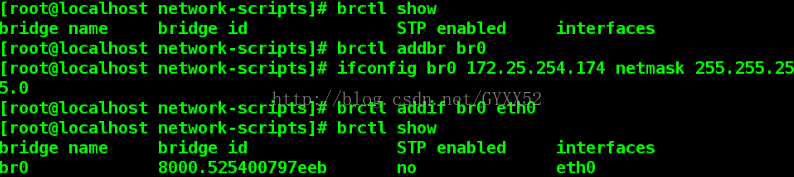

命令管理方式添加br0

首先查看是否有桥接 brctl show

brctl addbr br0 添加桥接,设备为br0

ifconfig br0 172.25.254.174 netmask 255.255.255.0

之后给br0添加物理网卡

brctl addif br0 eth0

615

615

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?