一、前言

Hadoop是一个由Apache基金会所开发的分布式系统基础架构。用户可以在不了解分布式底层细节的情况下,开发分布式程序。充分利用集群的威力进行高速运算和存储。Hadoop实现了一个分布式文件系统(Hadoop Distributed File System),简称HDFS。HDFS有高容错性的特点,并且设计用来部署在低廉的(low-cost)硬件上;而且它提供高吞吐量(high throughput)来访问应用程序的数据,适合那些有着超大数据集(large data set)的应用程序。HDFS放宽了(relax)POSIX的要求,可以以流的形式访问(streaming access)文件系统中的数据。Hadoop的框架最核心的设计就是:HDFS和MapReduce。HDFS为海量的数据提供了存储,则MapReduce为海量的数据提供了计算。

二、软件要求

1、JDK1.7+

2、hadoop-2.7.3.tar.gz

3、软件统一安装到 /opt/soft文件夹中

三、安装配置

本次使用6台机器,上一篇文章已经做好Zookeeper的集群配置

修改网络配置/etc/hosts修改完成拷贝到其他机器

| IP | 主机名 | 启动的进程 |

|---|---|---|

| 192.168.0.11 | hadoop01 | NameNode、DFSZKFailoverController(zkfc) |

| 192.168.0.12 | hadoop02 | NameNode、DFSZKFailoverController(zkfc) |

| 192.168.0.13 | hadoop03 | ResourceManager |

| 192.168.0.14 | zk01 | DataNode、NodeManager、JournalNode、QuorumPeerMain |

| 192.168.0.15 | zk02 | DataNode、NodeManager、JournalNode、QuorumPeerMain |

| 192.168.0.16 | zk03 | DataNode、NodeManager、JournalNode、QuorumPeerMain |

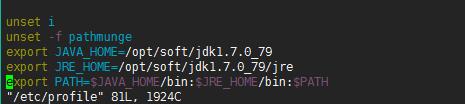

1、配置JDK环境变量

/etc/profile

确定JDK环境变量配置成功 java -version

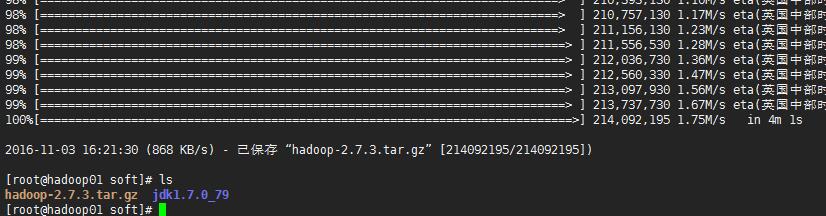

2、下载稳定版本的Hadoop2.X

在hadoop01中下载,本次使用hadoop-2.7.3.tar.gz版本

wget http://apache.fayea.com/hadoop/common/hadoop-2.7.3/hadoop-2.7.3.tar.gz3、解压hadoop-2.7.3.tar.gz

解压tar -zxvf hadoop-2.7.3.tar.gz

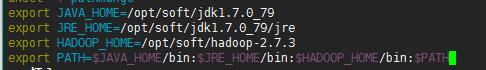

配置Hadoop的环境变量/etc/profile中添加

添加完成后source /etc/profile刷新一下

将配置好的环境变量同步到其他机器

4、修改Hadoop配置文件

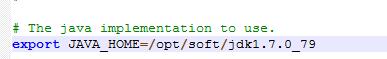

4.1 、修改hadoo-env.sh文件

4.2、修改core-site.xml

<configuration>

<!-- 指定hdfs的nameservice为ns1 -->

<property>

<name>fs.defaultFS</name>

<value>hdfs://ns1</value>

</property>

<!-- 指定hadoop临时目录 -->

<property>

<name>hadoop.tmp.dir</name>

<value>/opt/soft/hadoop-2.7.3/tmp</value>

</property>

<!-- 指定zookeeper地址 -->

<property>

<name>ha.zookeeper.quorum</name>

<value>zk01:2181,zk02:2181,zk03:2181</value>

</property>

</configuration>4.3、修改hdfs-site.xml

<configuration>

<!--指定hdfs的nameservice为ns1,需要和core-site.xml中的保持一致 -->

<property>

<name>dfs.nameservices</name>

<value>ns1</value>

</property>

<!-- ns1下面有两个NameNode,分别是nn1,nn2 -->

<property>

<name>dfs.ha.namenodes.ns1</name>

<value>nn1,nn2</value>

</property>

<!-- nn1的RPC通信地址 -->

<property>

<name>dfs.namenode.rpc-address.ns1.nn1</name>

<value>hadoop01:9000</value>

</property>

<!-- nn1的http通信地址 -->

<property>

<name>dfs.namenode.http-address.ns1.nn1</name>

<value>hadoop01:50070</value>

</property>

<!-- nn2的RPC通信地址 -->

<property>

<name>dfs.namenode.rpc-address.ns1.nn2</name>

<value>hadoop02:9000</value>

</property>

<!-- nn2的http通信地址 -->

<property>

<name>dfs.namenode.http-address.ns1.nn2</name>

<value>hadoop02:50070</value>

</property>

<!-- 指定NameNode的元数据在JournalNode上的存放位置 -->

<property>

<name>dfs.namenode.shared.edits.dir</name>

<value>qjournal://zk01:8485;zk02:8485;zk03:8485/ns1</value>

</property>

<!-- 指定JournalNode在本地磁盘存放数据的位置 -->

<property>

<name>dfs.journalnode.edits.dir</name>

<value>/opt/soft/hadoop-2.7.3/journal</value>

</property>

<!-- 开启NameNode失败自动切换 -->

<property>

<name>dfs.ha.automatic-failover.enabled</name>

<value>true</value>

</property>

<!-- 配置失败自动切换实现方式 -->

<property>

<name>dfs.client.failover.proxy.provider.ns1</name>

<value>org.apache.hadoop.hdfs.server.namenode.ha.ConfiguredFailoverProxyProvider</value>

</property>

<!-- 配置隔离机制方法,多个机制用换行分割,即每个机制暂用一行-->

<property>

<name>dfs.ha.fencing.methods</name>

<value>

sshfence

shell(/bin/true)

</value>

</property>

<!-- 使用sshfence隔离机制时需要ssh免登陆 -->

<property>

<name>dfs.ha.fencing.ssh.private-key-files</name>

<value>/root/.ssh/id_rsa</value>

</property>

<!-- 配置sshfence隔离机制超时时间 -->

<property>

<name>dfs.ha.fencing.ssh.connect-timeout</name>

<value>30000</value>

</property>

</configuration>4.4、修改mapred-site.xml

将文件名称 mapred-site.xml.template 修改成 mapred-site.xml

mv mapred-site.xml.template mapred-site.xml<configuration>

<!-- 指定mr框架为yarn方式 -->

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

</configuration>4.5、修改yarn-site.xml

<configuration>

<!-- 指定resourcemanager地址 -->

<property>

<name>yarn.resourcemanager.hostname</name>

<value>hadoop03</value>

</property>

<!-- 指定nodemanager启动时加载server的方式为shuffle server -->

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

</configuration>4.6、修改slaves

DataNode指定安装位置

zk01

zk02

zk034.7 ssh免密码登录

由于做zookeeper时候已经将zk01 到 zk02,zk03配置完成

现在需要将hadoop01 - hadoop02、03、zk01、zk02、zk03的免密码

还需要将 hadoop01的免密码配置给自己

在hadoop01上生产一对钥匙 ssh-keygen -t rsa

将公钥拷贝到其他节点,包括自己

ssh-coyp-id hadoop01

ssh-coyp-id hadoop02

ssh-coyp-id hadoop03

ssh-coyp-id zk01

ssh-coyp-id zk02

ssh-coyp-id zk03配置 hadoop03 到 zk01 、zk02、zk03的免登陆,在hadoop03上生成密匙

ssk-keygen -t rsa

ssh-copy-id zk01

ssh-copy-id zk02

ssh-copy-id zk03注意:两个namenode之间要配置ssh免密码登陆,别忘了配置hadoop02到hadoop01的免登陆

4.8、将配置好的Hadoop拷贝到其他节点

scp -r hadoop-2.7.3 hadoop01:/opt/soft

scp -r hadoop-2.7.3 hadoop02:/opt/soft

scp -r hadoop-2.7.3 zk01:/opt/soft

scp -r hadoop-2.7.3 zk02:/opt/soft

scp -r hadoop-2.7.3 zk03:/opt/soft5、启用Hadoop集群

5.1、需要先启动zookeeper集群

在zk01、zk02、zk03中启动zookeeper

查看状态:一个leader,两个follower

5.2、启动journalnode

在hadoop01上启动所有journalnode,注意:是调用的hadoop-daemons.sh这个脚本运行jps命令检验,zk01、zk02、zk03上多了JournalNode进程

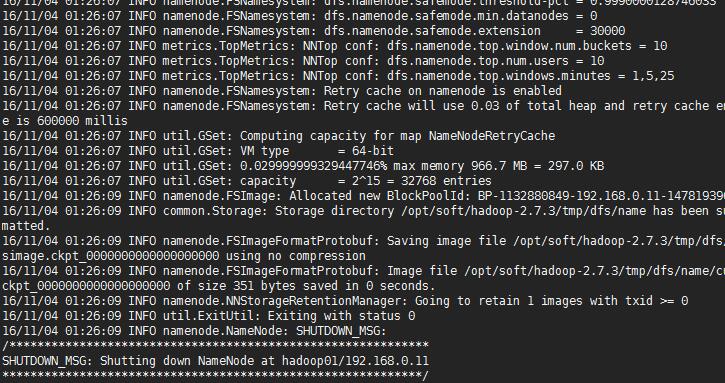

./hadoop-daemons.sh start journalnode5.3、格式化HDFS

在hadoop01上执行,

格式化后会在根据core-site.xml中的hadoop.tmp.dir配置生成个文件,这里我配置的是/opt/soft/hadoop-2.7.3/tmp,然后将/opt/soft/hadoop-2.7.3/tmp拷贝到hadoop02的/opt/soft/hadoop-2.7.3/tmp下。

hdfs namenode -format格式化成功后拷贝tmp目录scp -r tmp hadoop02:/opt/soft/hadoop-2.7.3/

5.4、格式化ZK

在hadoop01上执行`hdfs zkfc -formatZK`

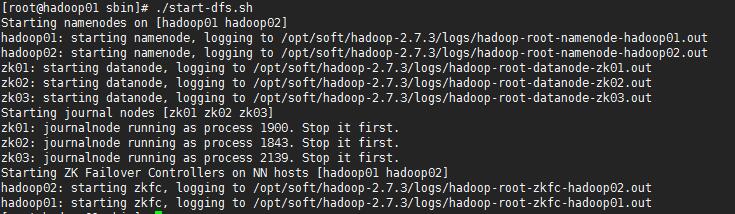

5.5、启动hdfs

在hadoop01上执行:start-dfs.sh

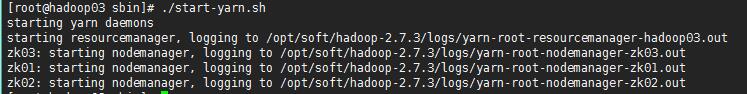

5.6、启动yarn

在hadoop03上启动yarn:start-yarn.sh

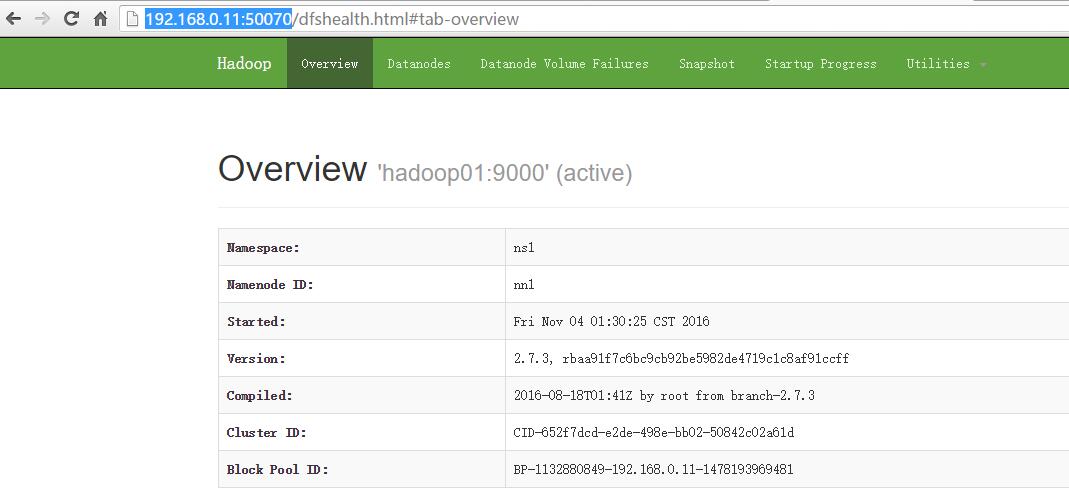

5.7、完成

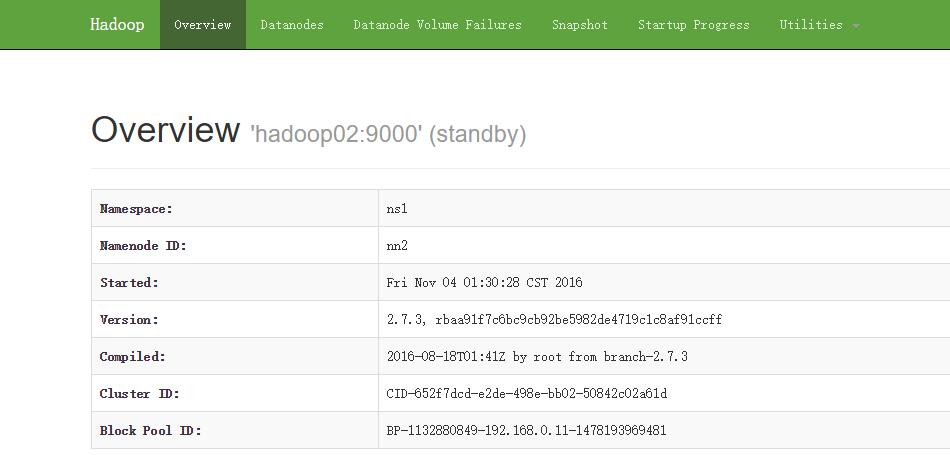

hadoop-2.7.3配置完毕,可以统计浏览器访问:

http://192.168.0.11:50070

NameNode ‘hadoop01:9000’ (active)

http://192.168.0.12:50070

NameNode ‘hadoop02:9000’ (standby)

可以手动停止一个NameNode进程,查看是否快速切换到192.168.0.12 Active状态

至此Hadoop2.X配置完成,有什么不对的请大家多多提意见。

1945

1945

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?