LRN(Local Response Normalization) 局部响应归一化笔记

本笔记记录学习 LRN(Local Response Normalization),若有错误,欢迎批评指正,学习交流。

1.侧抑制(lateral inhibition)

2.计算公式

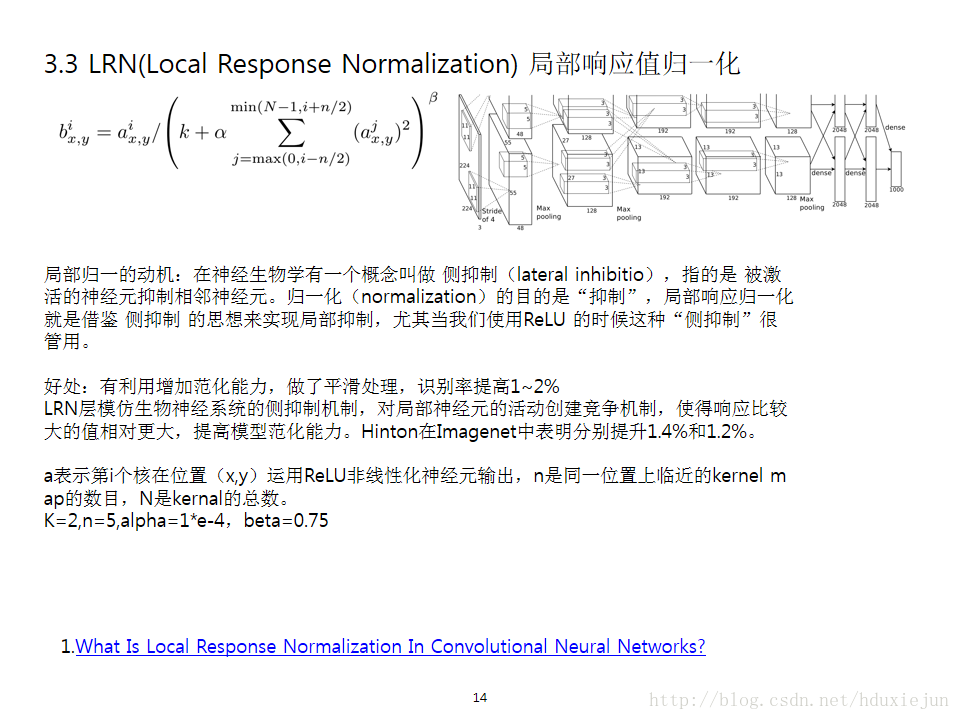

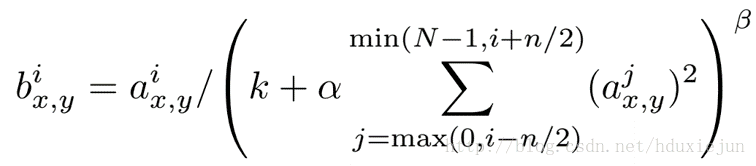

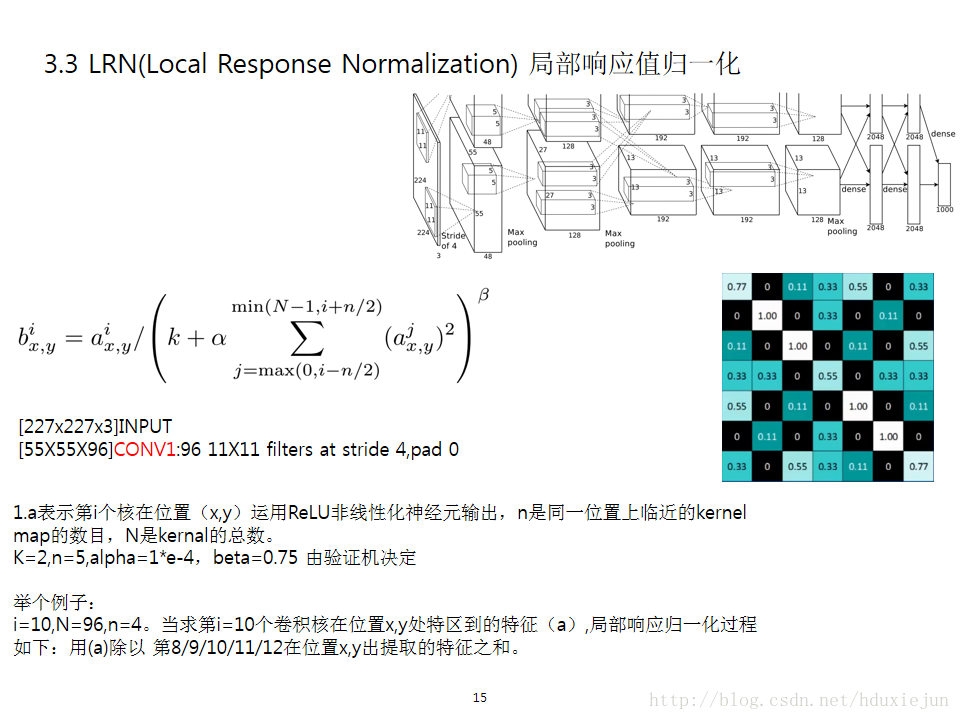

Hinton在2012年的Alexnet网络中给出其具体的计算公式如下:

公式看上去比较复杂,但理解起来非常简单。i表示第i个核在位置(x,y)运用激活函数ReLU后的输出,n是同一位置上临近的kernal map的数目,N是kernal的总数。参数K,n,alpha,belta都是超参数,一般设置k=2,n=5,aloha=1*e-4,beta=0.75。

3.后期争议

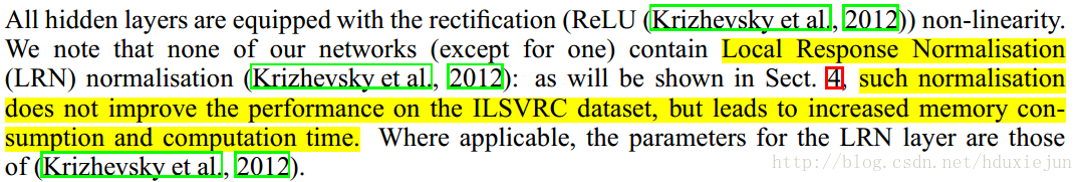

在2015年 Very Deep Convolutional Networks for Large-Scale Image Recognition.提到LRN基本没什么用。

在Alexnet模型中首次提出这个概念。

参考文献:

[LRN]:ImageNet Classification with Deep Convolutional Neural Networks

1679

1679

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?