一,course introducation

二, Large-margin Separating Hyperplane

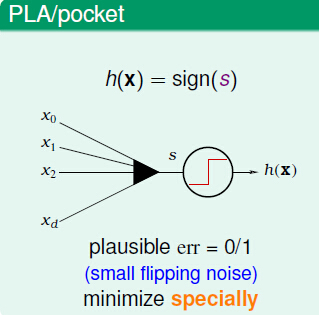

我们先回顾PLA/pocket 问题:

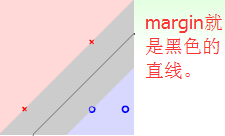

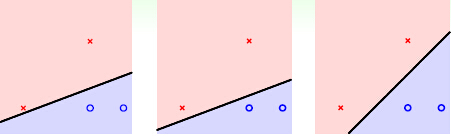

根据上面知,我们有很多选择的线,如:

由于我们采样时会产生误差,假设我们真实值是x,采取带误差的值是x_n。

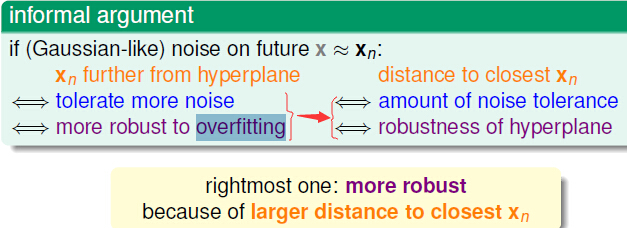

每个x_n最好是离超平面越远越好,这样就能更好的承受噪音,对过拟合有更好的robust。这样我们推广到全部采取点的x_n,最好全部的x_n都离超平面越远越好。

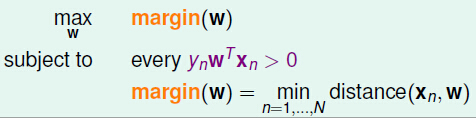

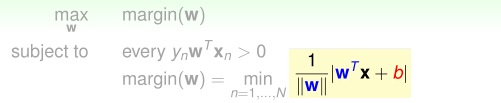

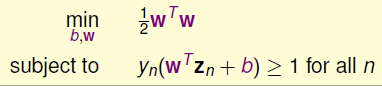

那么我们应该就称最大边界的分开(Large-Margin Separating Hyperplane)。我们用数学公式写成:

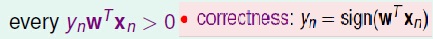

其中,margin是x_n离最大超平面最远最好的直线,(y_n)(w^t*x_n)是指直线分类必须正确:

三,Standard Large-Margin Problem(标准的最大边界问题)

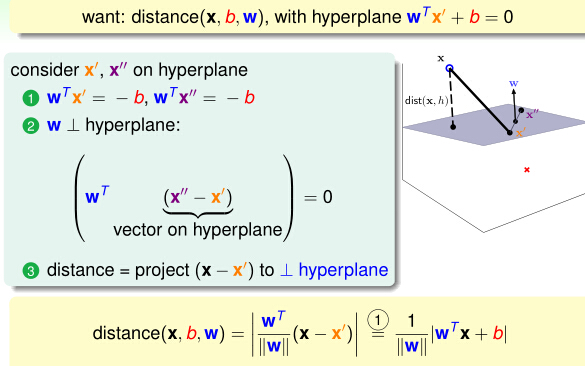

那么distance to hyperplane 到底应该怎么计算呢?

其实,distance就是我们在超平面是选两个点x’’和x’,那么(x‘’-x’)就是超平面的方向,distance to Hyperplane 就是(x’’-x’)在超平面的投影。

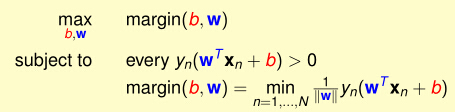

我们现在就知道Large-margin 的定义,其定义是:

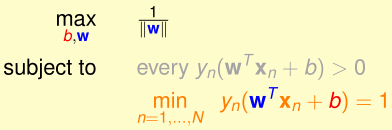

我们为了更好的计算,我们要将其简化。我们对其进行四部简化:

第一步:去除绝对值

由于y_n(w^T*x_n + b)>0,那么我们对distance乘以一个y_n,那么就可以去除绝对值。那我们就可以将其简化为:

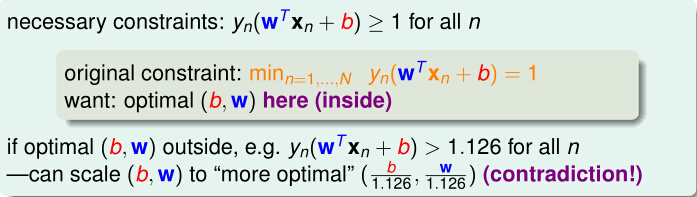

第二步:尺度变换

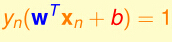

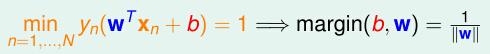

由于(w^T + b)=0,而3(w^T + b) = 0,尺度对其没有变换,那我们将其尺度特殊化,我们只考虑:

那么我们就可以将Large-margin简化为:

由于

第三步:放松条件

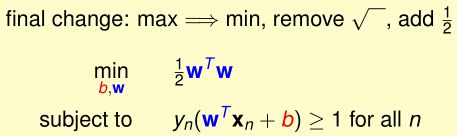

第四步:把目标函数改写

四,SupportVector Machine(支撑向量机)

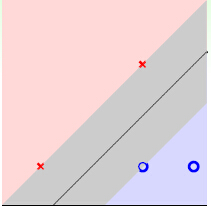

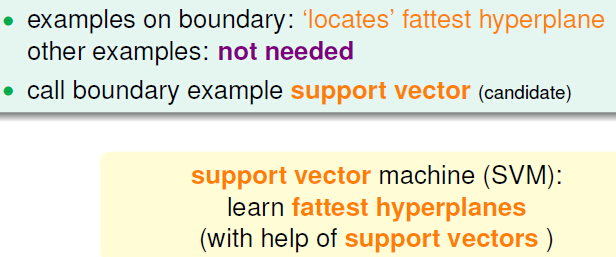

1,支撑向量机的简单定义

如图,我们得到的资料集是4个点,而真正要用到的点只是三个点,在此处只是讲到要用到的最重要的点叫支撑向量。

2,解决SVM的问题

我们要用二次规划(Quardratic Programming)解决SVM问题,因为

我们把SVM问题与标准的二次规划问题进行对比,把参数带进标准二次规划进行对比,得出:

最后我们就得到SVM witih QP(Quardratic Programming) Solver:

其中,hard-margin和Linear是因为:

Hard-margin要把全部的类别分开,而Linear是原来的数据是线性的。

五,Reason Behind Large-Margin Hyperplane

我们刚才说了Large-Margin Hyperplane,那我们如何运用我们学到的相关解释最大边界超平面(Large-Margin Hyperplane)呢?

我们已经知道的Large-Margin的表达式是:

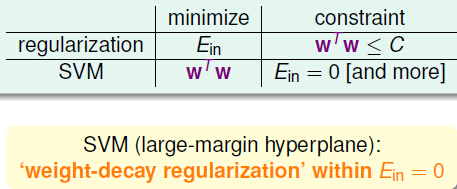

1,与正则化对比

正则化与Large-Margin Hyperplane的对比:

正则化可以看成是SVM的退化,让E_(in)=0。

2,Large-MarginRestricts Dichotomies(最大边界的约束二分法)

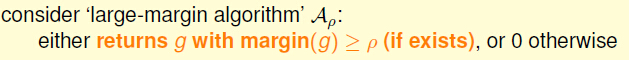

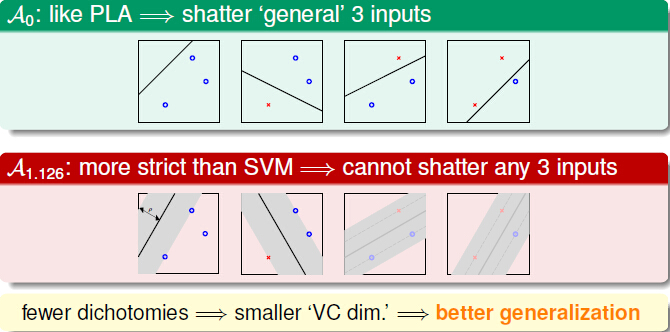

我们定义’Large-Margin Algorithm’,其中ρ是margin的距离。如下面的例子所示:

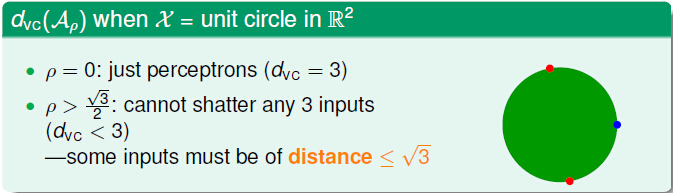

当ρ=0时和ρ=1.126时,Large-Margin的‘VC dim.’将会减小。所以当ρ>0时,VC dim.将会减小。

再通过另外一个例子:

我们得出结论:

所以我们计算SVM的VC dim.时,可以利用上面的公式。

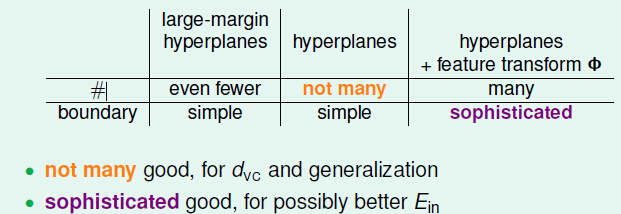

接下来我们把Large-Margin Hyperplane和 Hyperplanes 、Hyperplane+feature transform 的假设数目和boundary的数目进行比较。

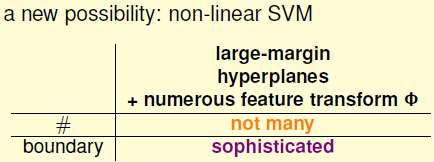

那么,我们如果能找到一个假设数量不多,而且边界尽量精确的模型,那不是更好么。我们就提出了:

这也是我们下一讲要说到的。

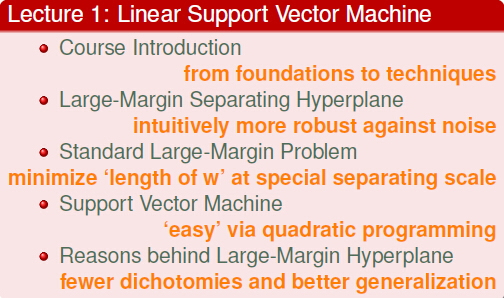

总结:

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?