决策树是机器学习中基本的分类与回归算法,本文主要讨论用于分类的决策树模型。

在学习决策树之前先以简单的例子作为引入,大家在电视节目中或者游戏中(记得以前李咏主持的《非常6+1》有这样的游戏)都玩过“提问题猜答案”,即游戏者向主持人提出若干个问题,主持人只回答是或者不是,最后游戏者通过一系列的提问猜出问题的答案。决策树模型原理和这个游戏类似。

决策树是一种对实例进行分类的树形结构,由节点和有向边组成。节点有两种类型,一种为内部节点(游戏中提出的问题),一种为叶节点(结束时得出的答案),而有向边类似于游戏中问题的不同答案(分支)。

决策树的学习包括特征选择,决策树的生成和决策树的剪枝。特征选择的目的是选取具有分类能力的特征,就像游戏中所提问题对最终答案的确定带来多少价值。举个例子,如果想对班级进行男女分类,以头发,眼睛,鼻子这样的特征进行分类效果肯定好不到哪儿去,但是如果以DNA特征来区分明显能百分之百进行区分(也许可能不是100%,嘎嘎嘎)。

特征选取:

好的特征关乎到树的分类效果,而怎么样选取好的特征?换句话说怎样评价特征的好坏呢?

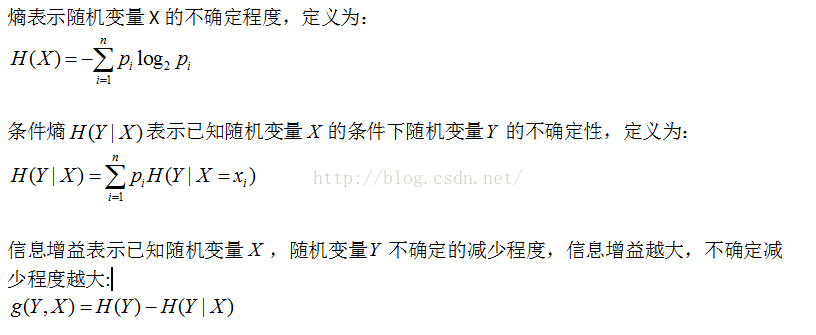

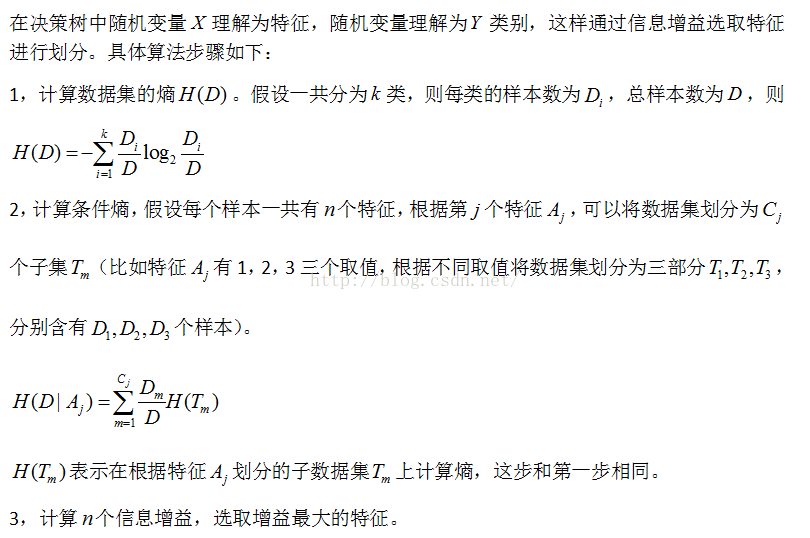

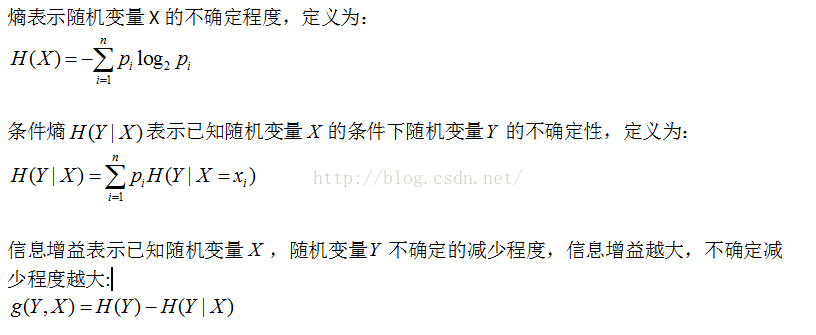

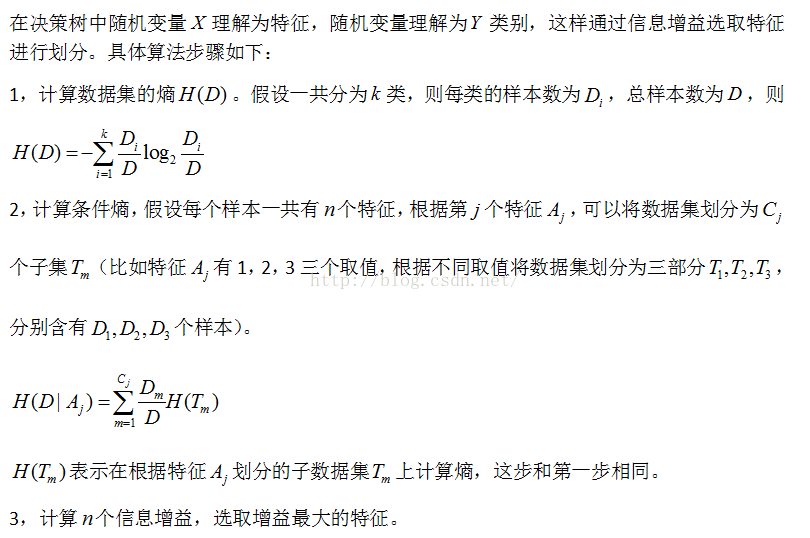

信息增益就可以拿来进行对特征的评价,下面介绍信息增益在信息论中的定义,接着介绍在决策树中的应用。

决策树构建:

决策树的构建采用递归的方法进行构建,递归结束的条件(树建立完成)分为两个:1,数据集类别完全相同(数据集本来全都是一类);2,在信息增益阈值范围内,遍历所有特征。每次递归时,选取当前训练集下分类能力最强的特征,并沿着特征对数据集进行分割。

在学习决策树之前先以简单的例子作为引入,大家在电视节目中或者游戏中(记得以前李咏主持的《非常6+1》有这样的游戏)都玩过“提问题猜答案”,即游戏者向主持人提出若干个问题,主持人只回答是或者不是,最后游戏者通过一系列的提问猜出问题的答案。决策树模型原理和这个游戏类似。

决策树是一种对实例进行分类的树形结构,由节点和有向边组成。节点有两种类型,一种为内部节点(游戏中提出的问题),一种为叶节点(结束时得出的答案),而有向边类似于游戏中问题的不同答案(分支)。

决策树的学习包括特征选择,决策树的生成和决策树的剪枝。特征选择的目的是选取具有分类能力的特征,就像游戏中所提问题对最终答案的确定带来多少价值。举个例子,如果想对班级进行男女分类,以头发,眼睛,鼻子这样的特征进行分类效果肯定好不到哪儿去,但是如果以DNA特征来区分明显能百分之百进行区分(也许可能不是100%,嘎嘎嘎)。

特征选取:

好的特征关乎到树的分类效果,而怎么样选取好的特征?换句话说怎样评价特征的好坏呢?

信息增益就可以拿来进行对特征的评价,下面介绍信息增益在信息论中的定义,接着介绍在决策树中的应用。

决策树构建:

决策树的构建采用递归的方法进行构建,递归结束的条件(树建立完成)分为两个:1,数据集类别完全相同(数据集本来全都是一类);2,在信息增益阈值范围内,遍历所有特征。每次递归时,选取当前训练集下分类能力最强的特征,并沿着特征对数据集进行分割。

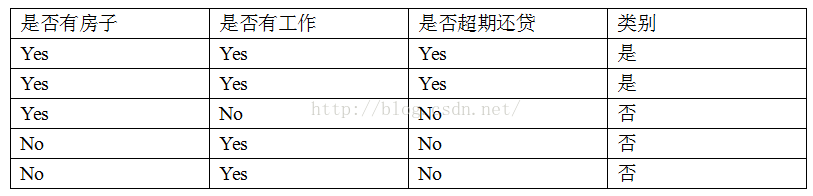

假设5个样本组成的贷款申请的训练数据:

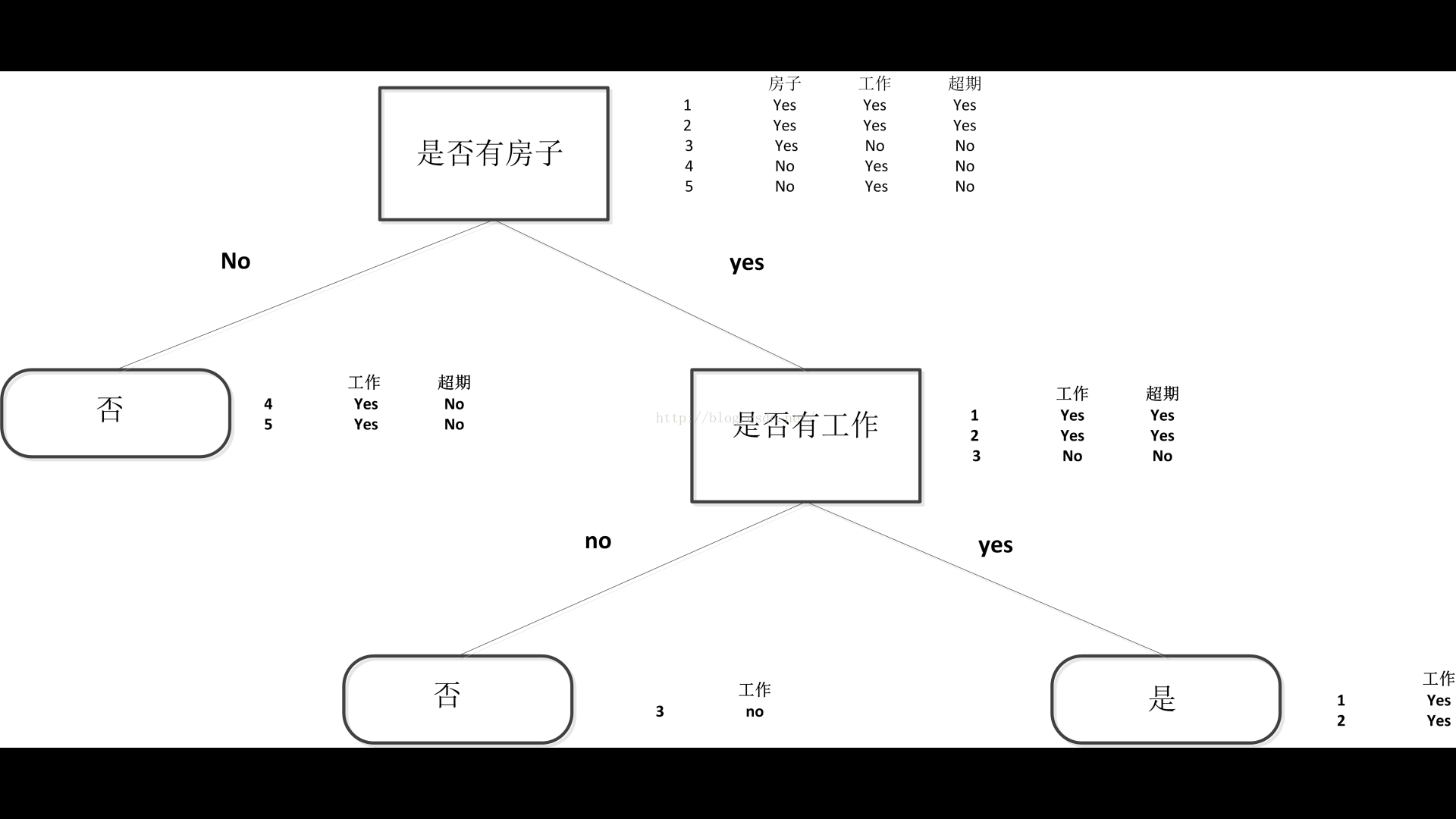

则最后形成的决策树为:

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?