学习和使用Hadoop Yarn已有半年多,其中遇到了一些常见问题,在网上搜索基本可以找到答案,出处已找不到,我只是对自己遇到的问题做个总结,也感谢解决这些问题的大神们,原谅我已经忘记到底从哪里获得的答案o(╯□╰)o。我目前使用的Hadoop版本是2.6.0。下面是我遇到的问题,以后会不定期更新:

- 配置了HDFS的federation,eclipse插件配置连接Hadoop2.6.0后无法查看远程文件目录结构

- 使用Maven开发MapReduce时,无法下载Hadoop2.6.0相关包

- MapReduce工程报错Missing artifact jdk.tools:jdk.tools:jar:1.7

- Container … is running beyond virtual memory limits

- Container … is running beyond physical memory limits

- java.lang.OutOfMemoryError: Java heap space

- 不关闭防火墙的情况下提交作业失败

- containner日志报错找不到类方法

- 提交作业指定-D、-libjars等常规选项失败

配置了HDFS的federation,eclipse插件配置连接Hadoop2.6.0后无法查看远程文件目录结构

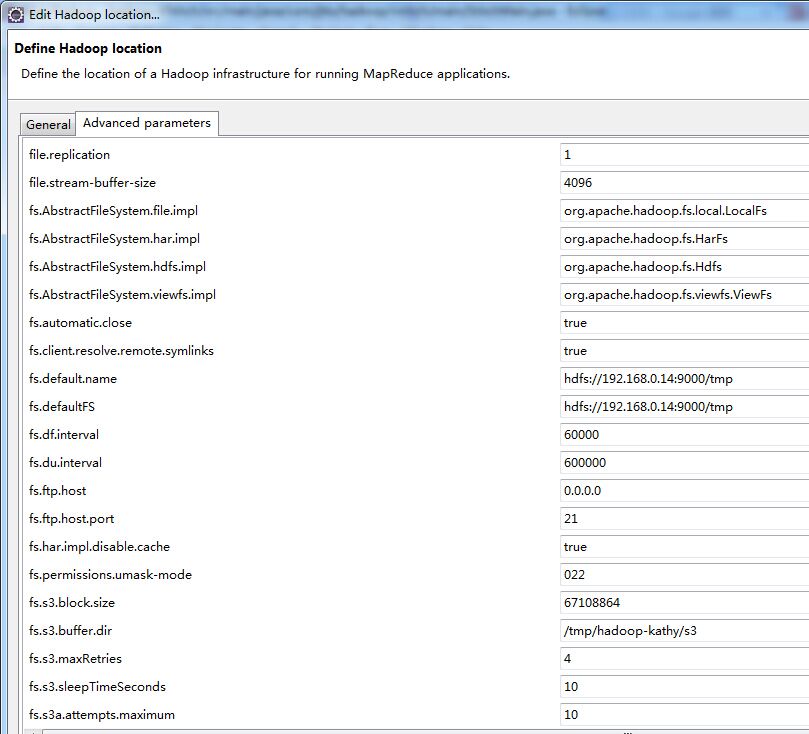

如图所示,在Edit Hadoop location中,切换到Advanced parameters标签,修改fs.defaultFS为hdfs://192.168.0.14:9000/tmp。其中/tmp就是我在配置文件中配置的其中一个HDFS相对路径。

使用Maven开发MapReduce时,无法下载Hadoop2.6.0相关包

在pom.xml中增加如下配置:

<repositories>

<repository

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2117

2117

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?