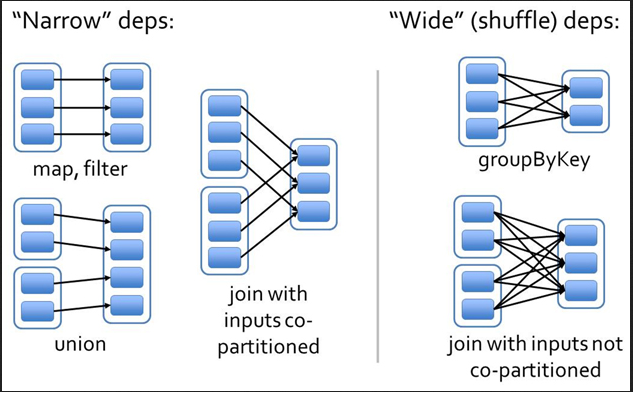

1.窄依赖是指每个父RDD的一个Partition做多被子RDD的一个Partition所使用,例如map、filter、union等都会产生窄依赖;

2.宽依赖是指一个父RDD的Paratition会被多个子RDD的Partition所使用,例如groupByKey、reduceByKey、sortByKey等操作都会产生宽依赖;

总结:如果父RDD的一个Partition被一个子RDD的Partition所使用就是窄依赖,否则的话就是宽依赖。

特别说明:对join操作有两种情况,如果说jion操作中使用的每个Partition仅仅和已知的Partition进行join,其实是join操作的窄依赖;其他情况下的join操作就是宽依赖;

因为是确定的Partition数量的依赖关系,所以就是窄依赖。所以得出一个结论:窄依赖不仅包含一对一的窄依赖,还包含一对固定个数的窄依赖。(也就是说对父RDD的依赖的Partition不会随着RDD数据规模的改变而改变)

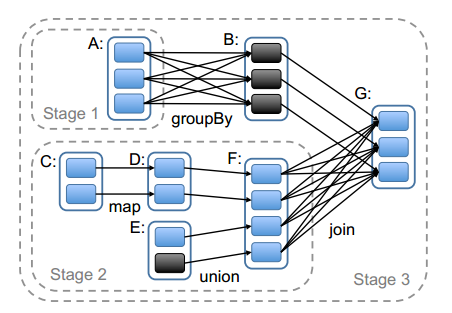

将RDD ABCDEF都放在一个Stage会怎么样?如果都放在一个Stage中:产生大量的中间数据(中间数据需要被存储起来,下一步才会执行)内存无法释放。

可以为每个Partitions产生一个Task?不能,Task太大、遇到Shuffle级别的依赖关系必须计算依赖的RDD的所有Partitions,并且都发生在一个Task中计算

重复计算,浪费内存

两种情况都不可性的原因:遇到Shuffle依赖的时候无法进行pipeline

1.从后往前推理,遇到宽依赖就断开,遇到窄依赖就把当前RDD加入到该Stage

2.每个Stage里面Task的数量是由该Stage中最后一个RDD的Partition的数量所决定的。

3.最后一个Stage里面的任务类型是ResultTask,前面其他所有的Stage的任务类型是ShuffleMapTask。

4.代表当前Stage的算子一定是该Stage的最后一个计算步骤

表面上看是数据在流动,实质上是算子在流动:

1,数据不动代码动

2,在一个Stage内部算子为何会流动(Pipeline)?首先是算子合并,也就是所谓的函数式编程的执行的时候最终进行函数的展开从而把一个Stage内部的多个算子合并成为一个大算子(其内部包含了当前Stage中所有算子对数据的计算逻辑);其次,是由于Transformation操作的Lazy特性!!!在具体算子交给集群的Executor计算之前首先会通过Spark Framework(DAGScheduler)进行算子的优化(基于数据本地性的Pipeline)

补充:如果Hadoop中的MapReduce操作中的Mapper和Reducer在Spark中基本等量算子是:map、reduceByKey。

学习于:

DT大数据梦工厂

新浪微博:www.weibo.com/ilovepains/

微信公众号:DT_Spark

博客:http://.blog.sina.com.cn/ilovepains

TEL:18610086859

Email:18610086859@vip.126.com

3184

3184

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?