实验环境:logstash-2.3.2、kafka_2.10-0.9.0.1、JDK1.8

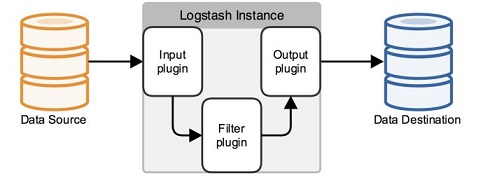

简单介绍下logstash,logstash专门用来收集数据,其功能和flume类似,但功能却比flume强大很多,而且不会丢失数据。其功能结构图如下

logstash主要由3个组件组成

- Input plugin:数据的输入源,比如有文件,数据库等

- Filter plugin:对输入的数据进行业务逻辑处理过滤

- Output plugin:数据的输出地,比如有hdfs、kafka等

1.logstash的搭建

logstash的搭建比较简单,下载官方的压缩包后,解压即可使用

实验过程:使用logstash监听一个日志文件,每当有数据写入的时候,自动把新增数据推送到kafka中

此次使用一个log文件作为输入源,在/tmp下新建一个文件log.txt,键入内容如下;

[root@slave04 tmp]# cat log.txt

logstash_kafka test

这里我们只简单使用Input plugin(file)和Output plugin(kafka)

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?