关于sqoop原理详见官文,这里都不做介绍,此处就记录用sqoop把greenplum数据导到hive中的方法和我测试时候遇到的问题;

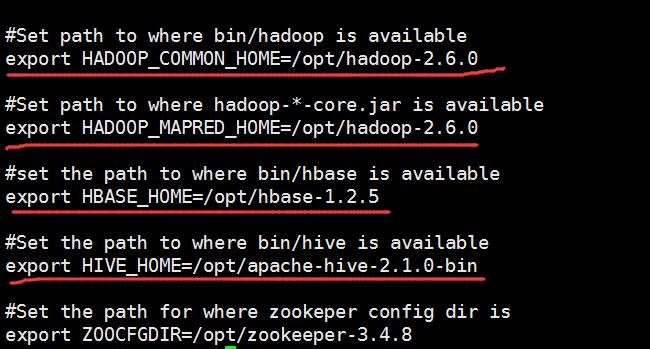

一:sqoop的解压安装后,配置sqoop-env.sh配置文件

二:把链接数据库的mysql-connector-java-5.1.3-jar包传到sqoop lib目录下

三:执行导入命令:

sqoop import -m1 \ --------------------指定mr并行度

--connect jdbc:postgresql://localhost:5432/edf \ ---数据库的驱动

--username gphive --password 123 \ ---------用户名和密码

--table biz_account \ ----------表名称

--hive-import \

--hive-table zt.sqoopTest \ -------------hive库和表

--null-string '\\N' \ ---------------处理空字符

--null-non-string '\\N' \

--hive-drop-import-delims \

--fields-terminated-by "\0001" \ -----------字段分隔符

--lines-terminated-by "\n" --------------行分隔符

四:说明

上面的命令可以直接把greenplum表直接把数据导到hive中,hive的database为zt,表的名字为sqoopTest,在测试过程中可以发现,sqoop命令后会生成一个 biz_account.java编译后的文件,这个文件会当做一个job提交到mr中执行,sqoop第一步会把数据导到hdfs上,然后再把HDFS数据load hive中,hive表会自动建立;

然后当测试的时候,我指定greenplum的schema的时候如下面命令,

----------------------------

sqoop import -m1 \

--connect jdbc:postgresql://localhost:5432/edf \

--username gphive --password 123 \

--table biz_account \

-- --schema df \ -----------------------指定greenplum的schema

--hive-import \

--hive-table zt.sqoopTest10 \

--null-string '\\N' \

--null-non-string '\\N' \

--hive-drop-import-delims \

--fields-terminated-by "\0001" \

--lines-terminated-by "\n"

奇怪的发现sqoop只把数据导到了hdfs中,而没有到hive中?我一直很纳闷?后面对这个项目进行了多次测试结果都是同样的,数据只到HDFS中却没有建hive中,而对于大家常用的MySQL却没有上面的问题;

对于上面的问题解决,还是没有用sqoop方法解决掉(哪位解决了请告诉一下),为了导到hive中最终还是采用别的办法解决了上面问题。

3301

3301

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?