Tensor flow中自带的seq2seq,这么经典的encoder-decoder模型,网上都没有相关的详细介绍。花了一个星期的时间,整理了该模型的详细架构。感兴趣的可以看一下。后面抽时间再把代码注释一下,本博主从来不玩虚的,注释的会很详细,有打算入手的期待一下吧。^-^

这段时间一直忙着做Dialogue Generation相关的实验,刚刚入手,拿了tensorflow现有的seq2seq练练手。总结了下面几页PPT。分享出来,也算给自己做个公开云笔记。如有错误,也希望各路大牛能给指出!

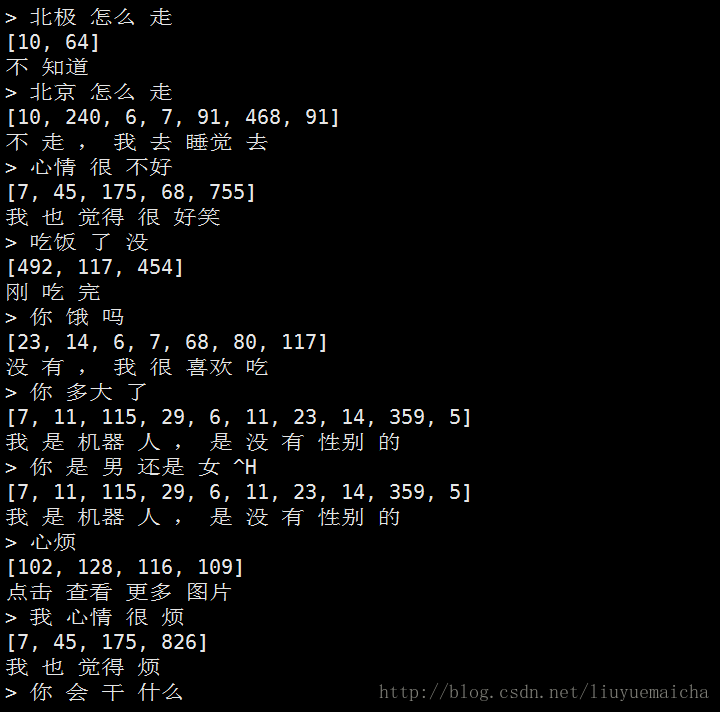

先看下测试效果吧:

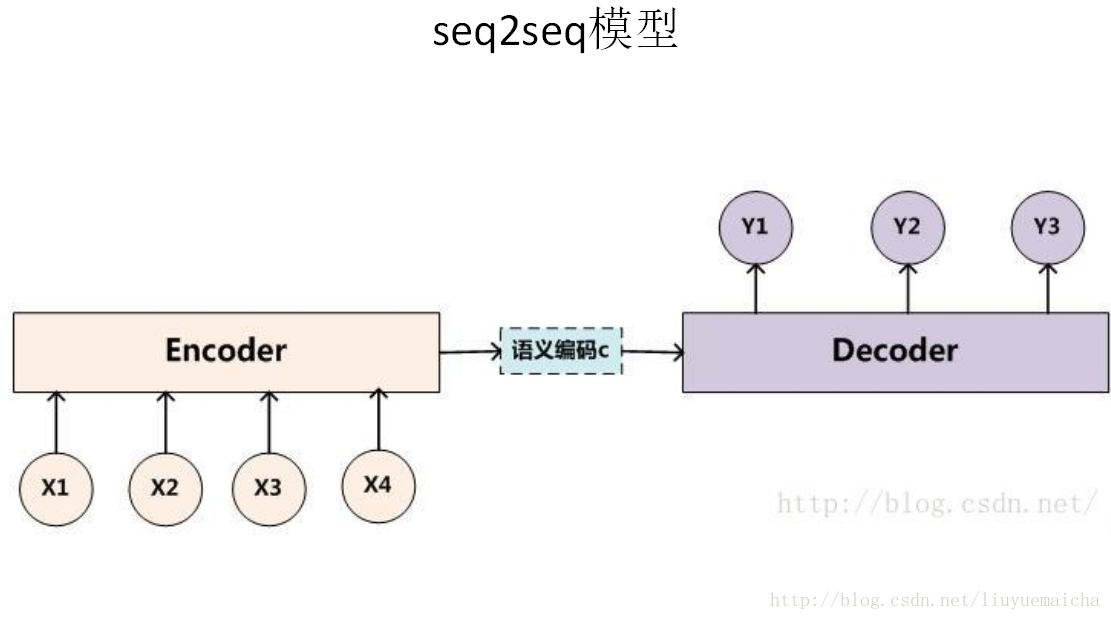

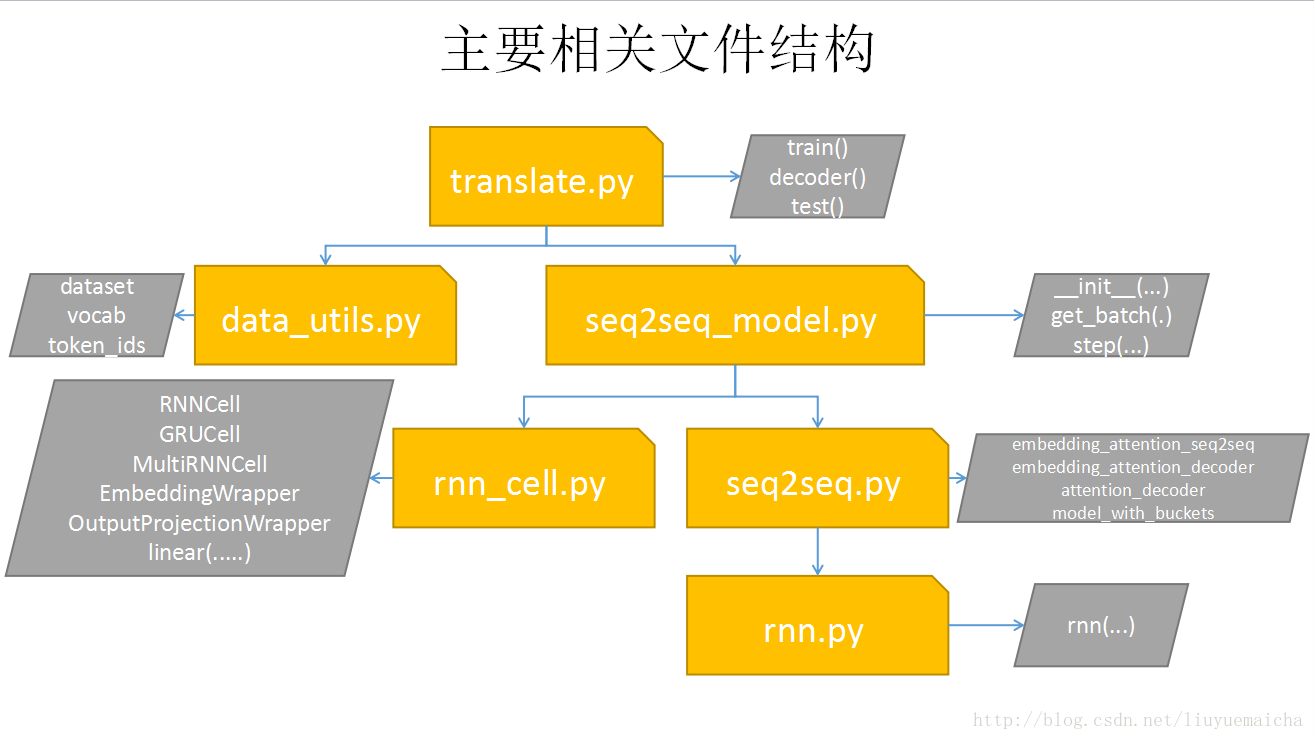

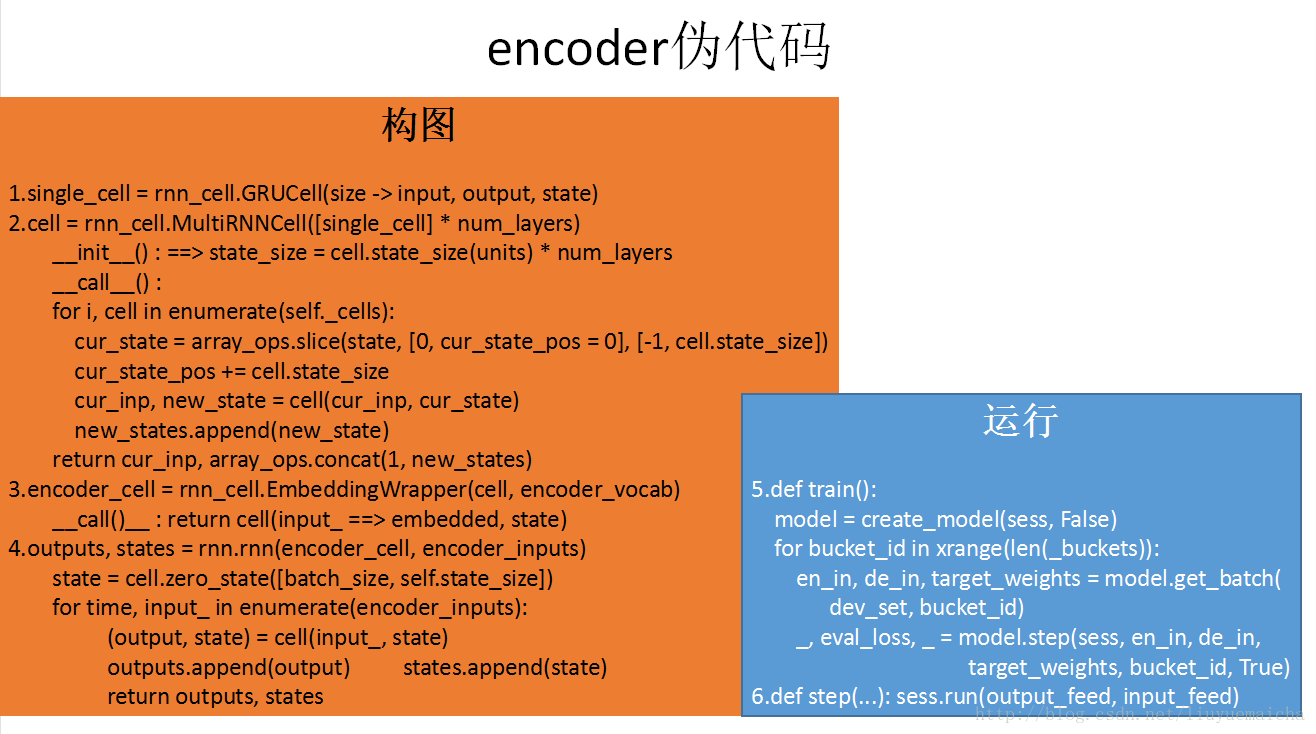

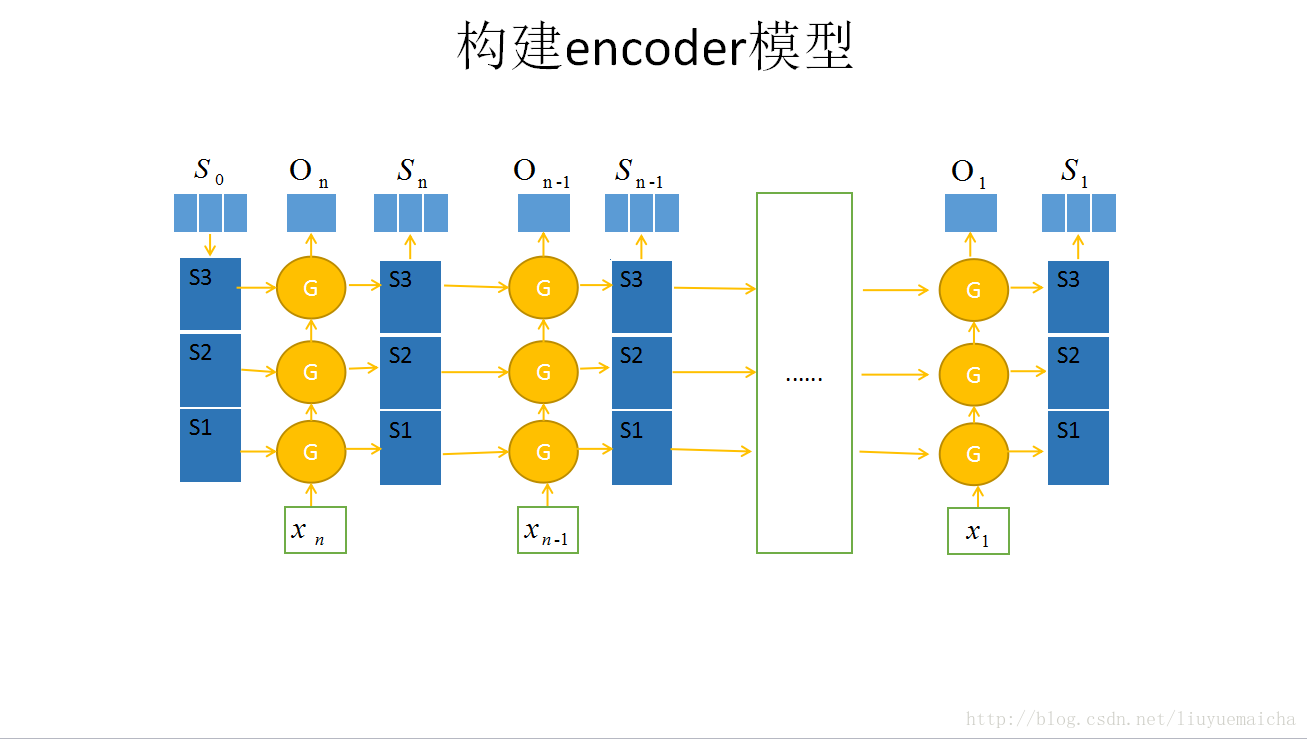

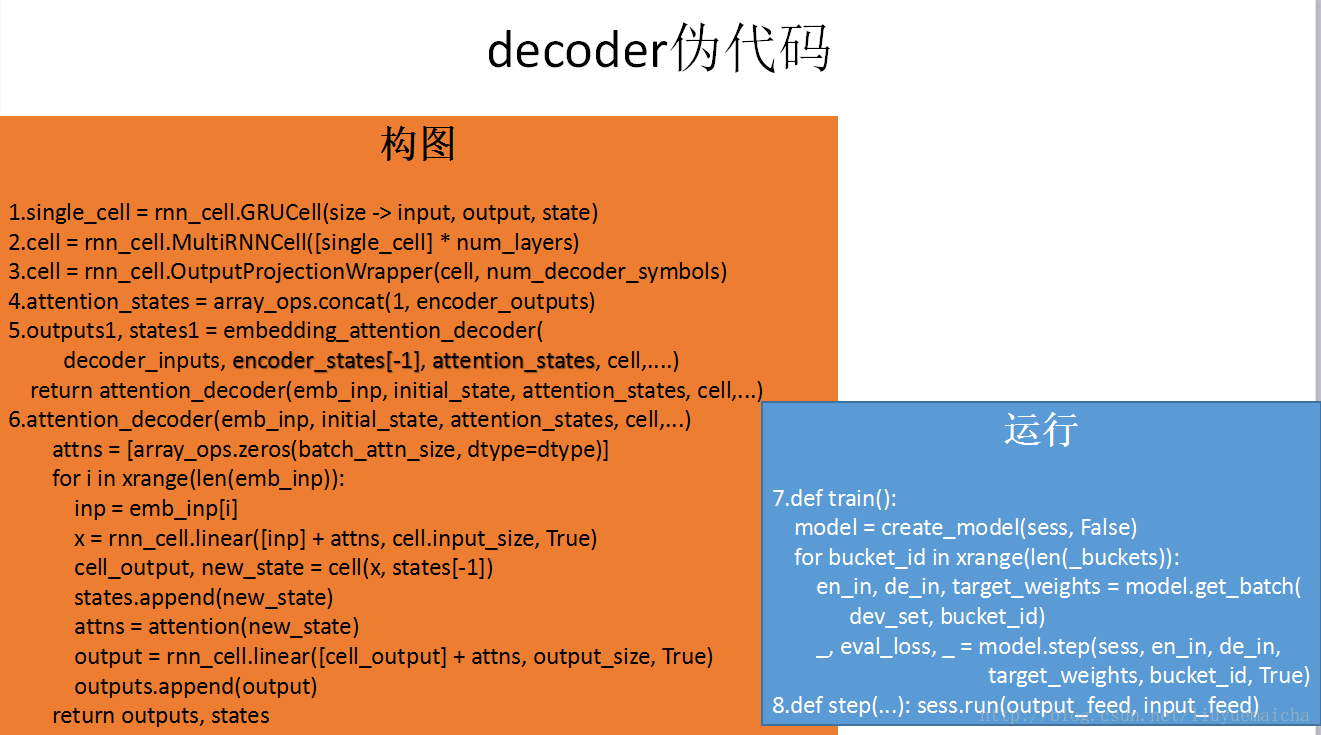

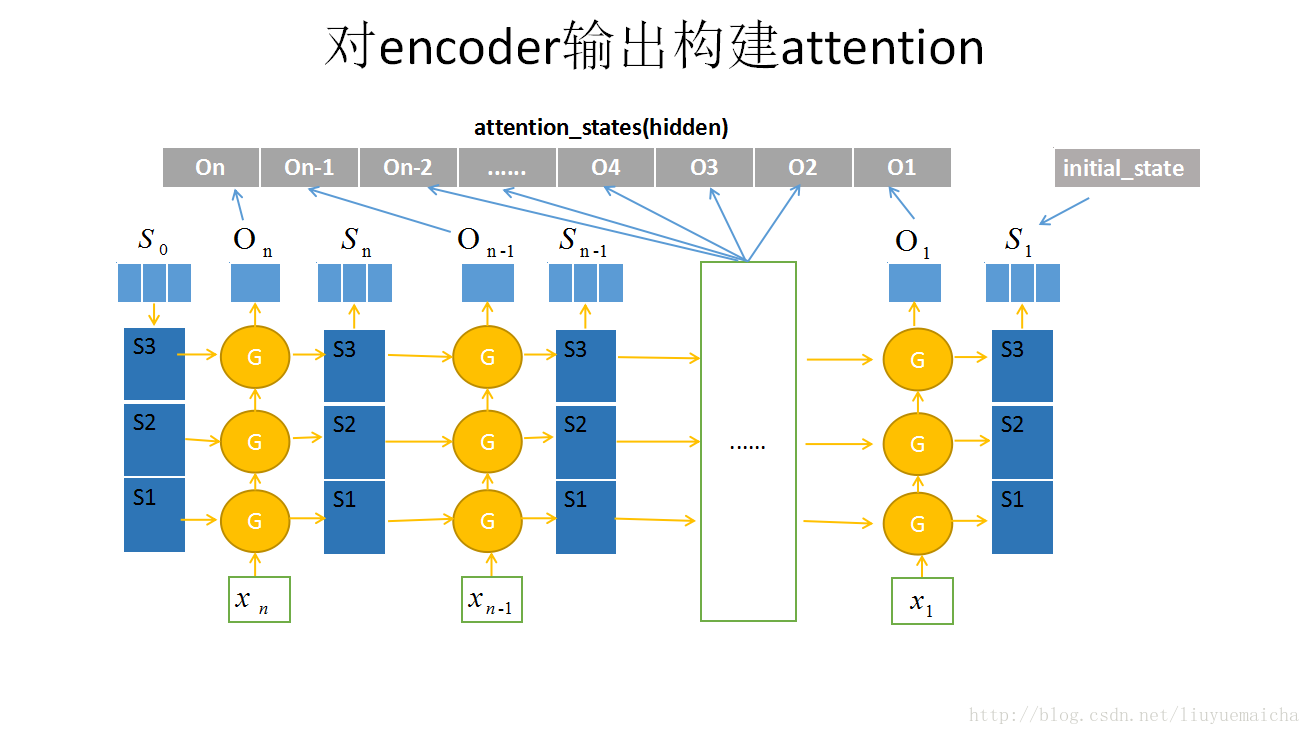

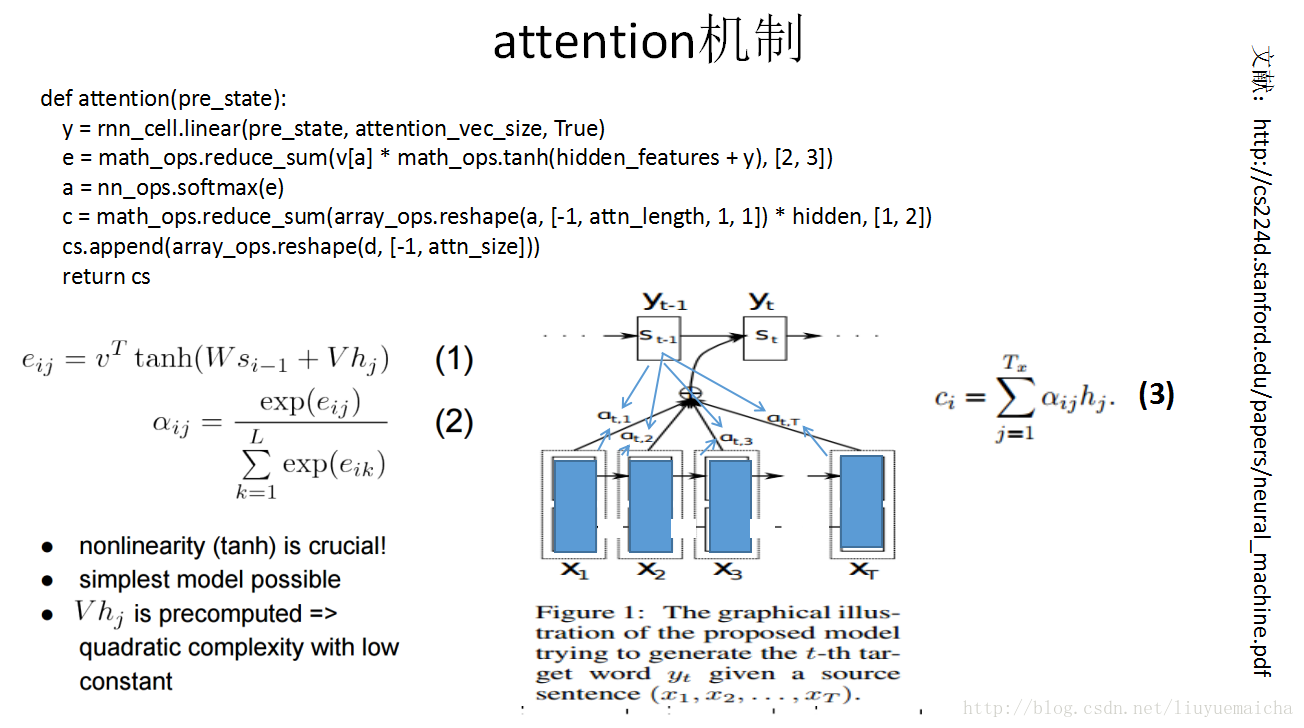

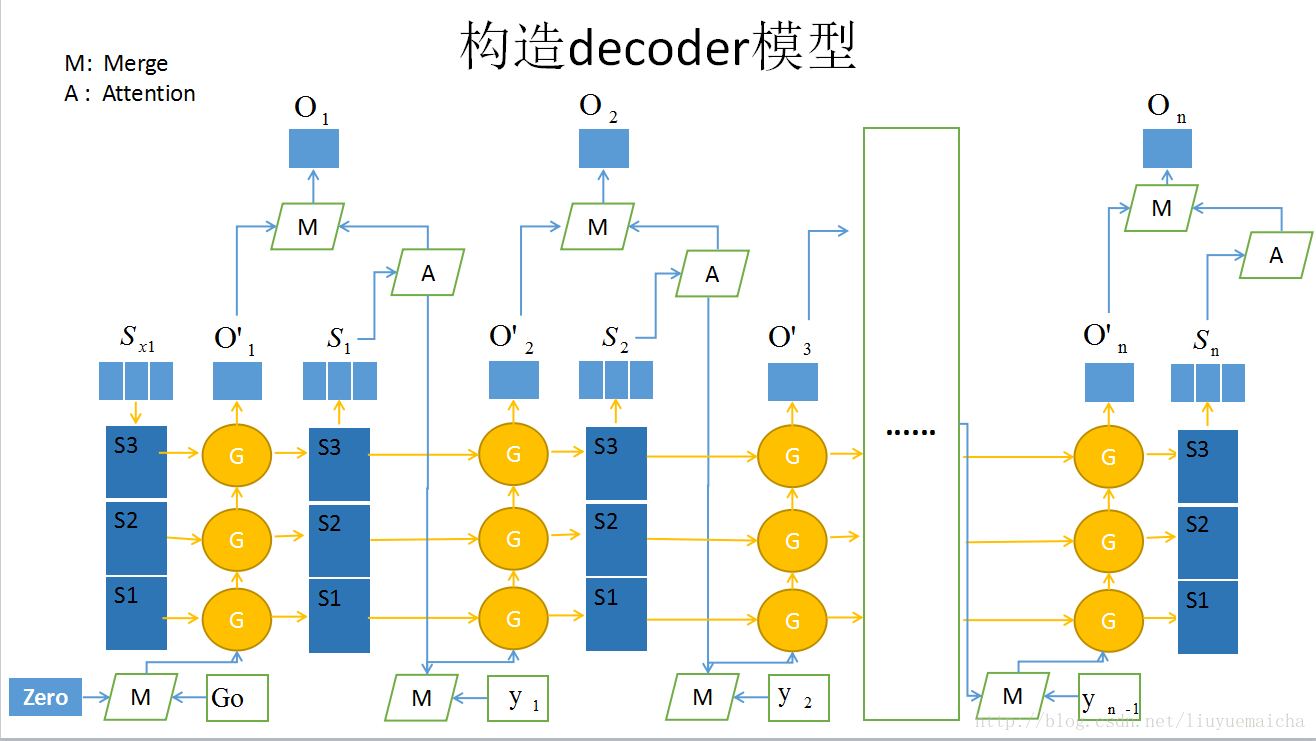

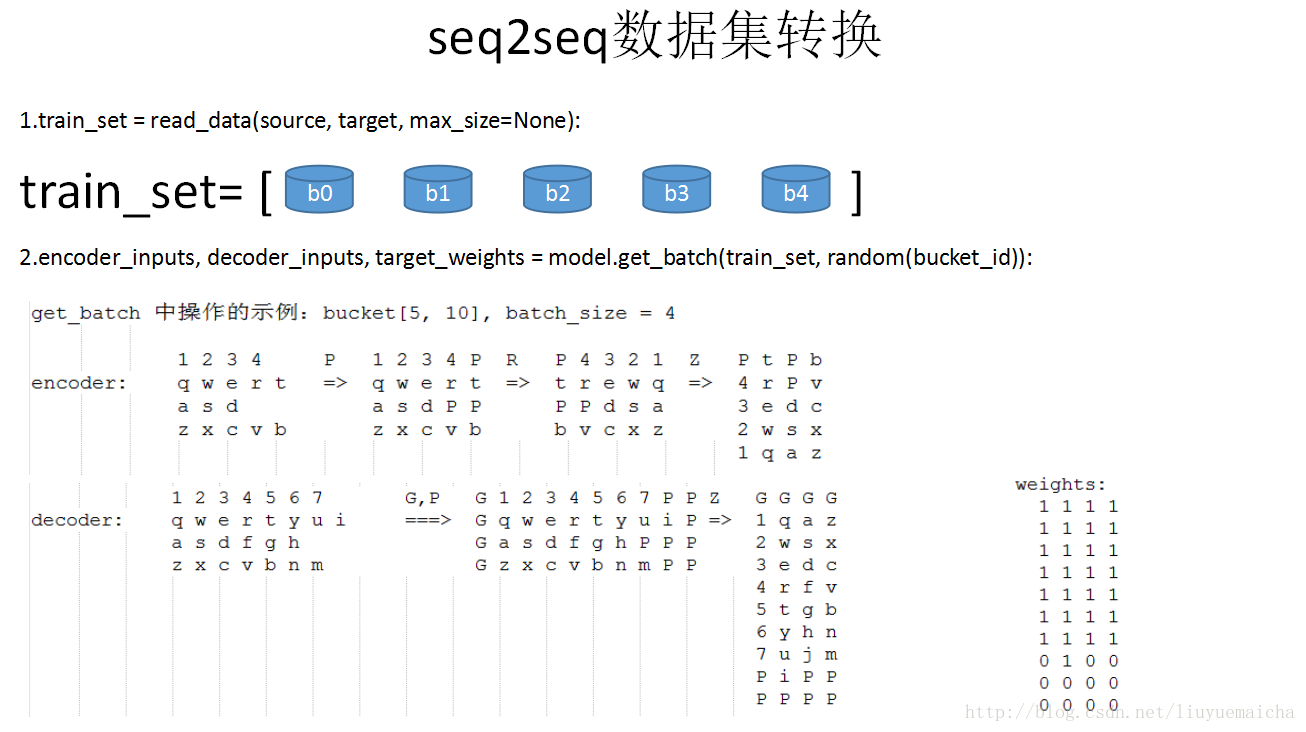

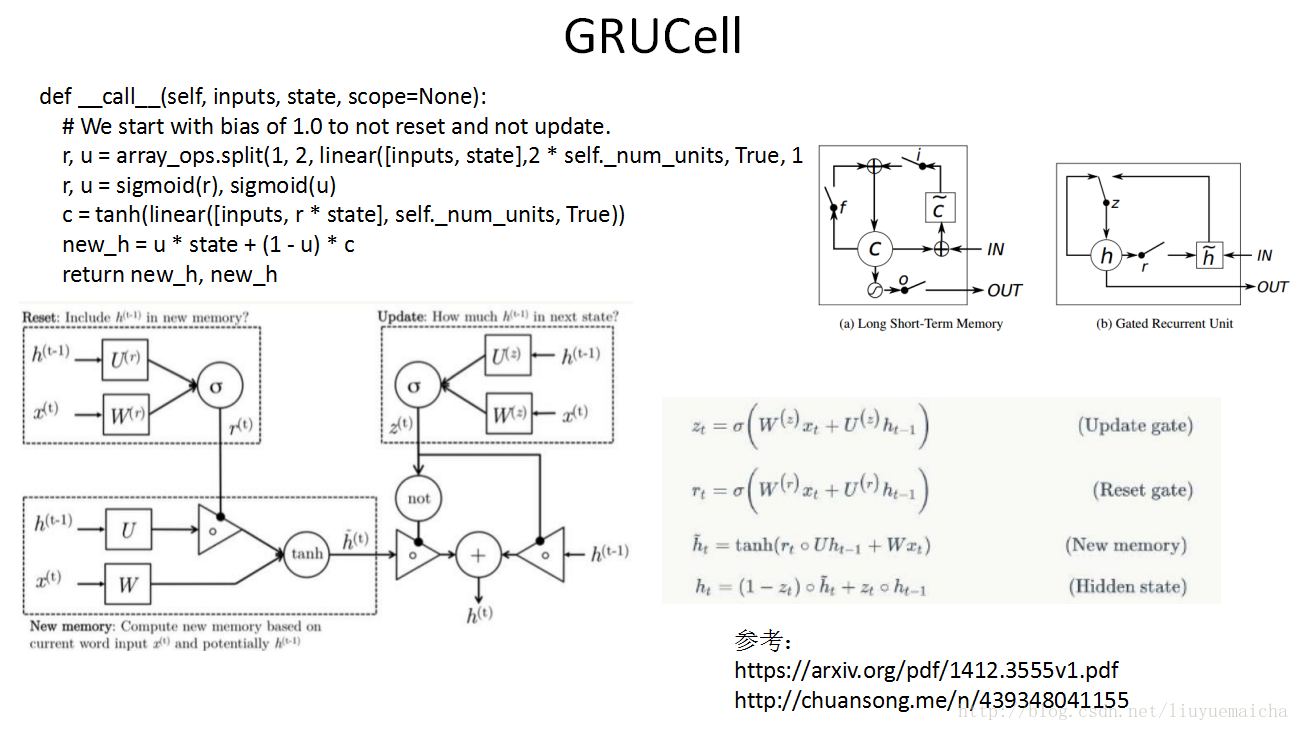

PPT正文:

修正:倒数第二页PPT中,decoder的batch序列在最后一位还有结束标志位:EOS_ID(2). 即:decoder中有开始位:G,填充位PAD(0)和结束标志位EOS_ID(2).

4185

4185

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?