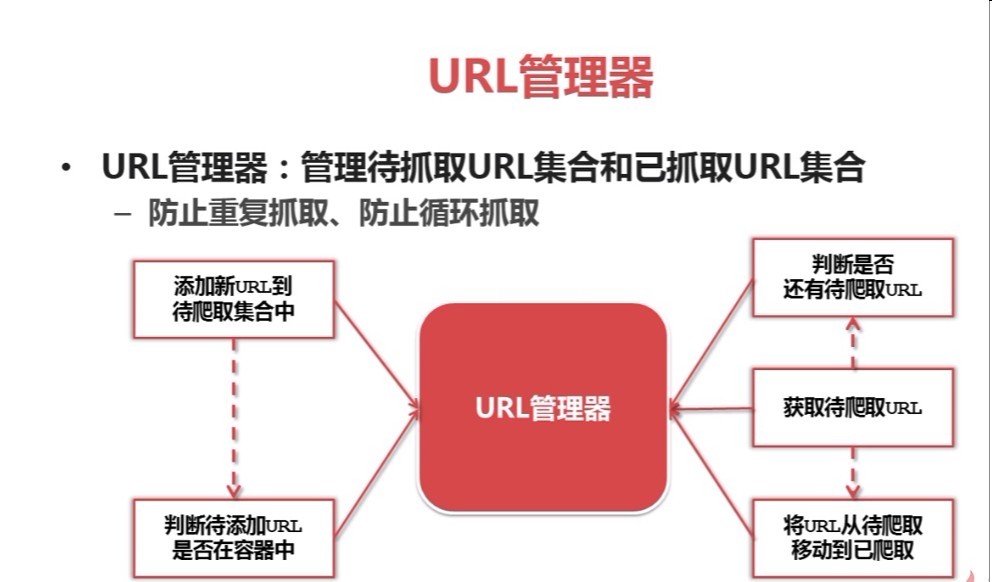

url管理器

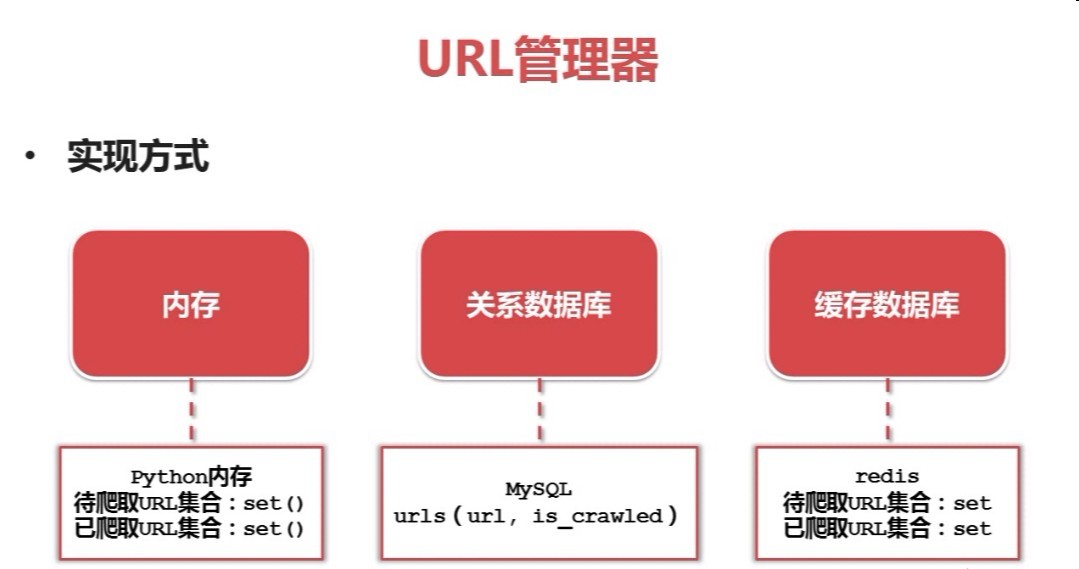

URL管理器一般有三种实现方式。

- set集合,一般小型的爬虫或者不要求永久保存url的程序可以选用set集合来存储url列表。选用set是因为它可以自动去除重复的元素。

s = set([1,2,3]),需要提供一个iterable给set。 - 关系型数据库,例如MySQL。可以创建一个表urls(url,is_crawled),它有两个字段,is_crawled代表这个url是待爬取还是已爬取。

- 缓存数据库,例如redis。支持set。

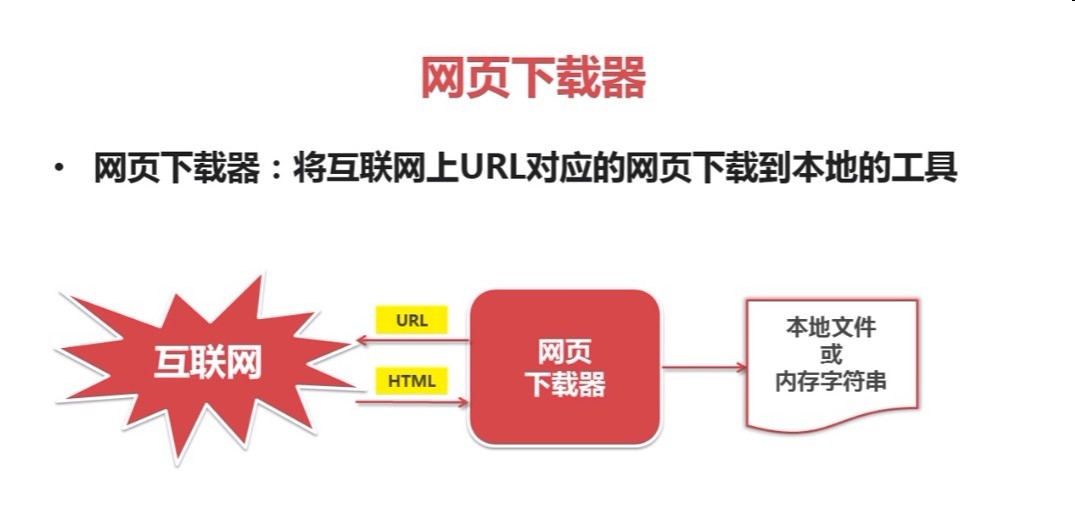

网页下载器

- set集合,一般小型的爬虫或者不要求永久保存url的程序可以选用set集合来存储url列表。选用set是因为它可以自动去除重复的元素。

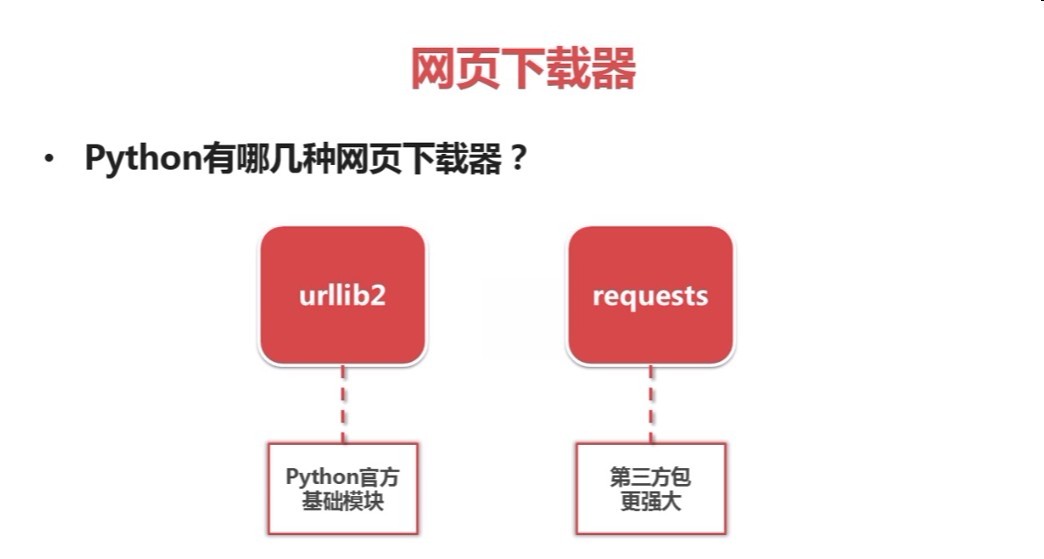

urllib2的使用:

- 最简洁的方法:

import urllib2

#直接请求

response = urllib2.urlopen('http://www.baidu.com')

#获取状态码,如果是200,则说明读取成功

print response.getcode()

#读取内容

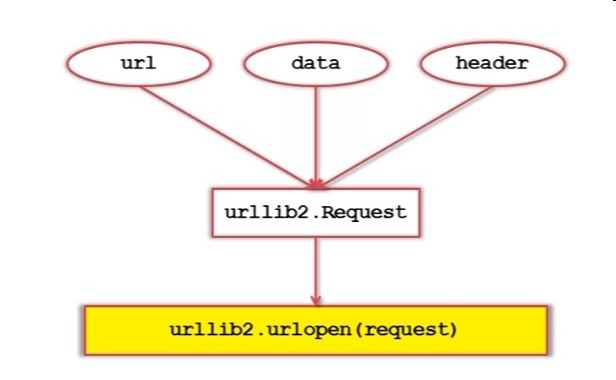

cont = response.read()- 方法2:添加data,http header

import urllib2

#创建request对象

request = urllib2.Request(url)

#添加数据

request.add_data('a', '1')

#添加http的header(伪装成mozilla浏览器)

request.add_header('User-Agent', 'Mozilla/5.0')

#发送请求获取结果

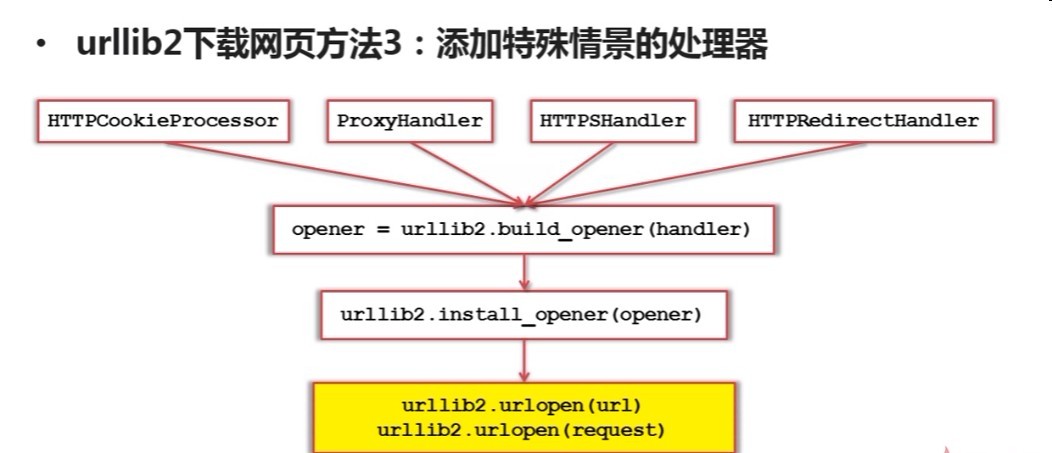

response = urllib2.urlopen(request)- 方法3:

HTTPCookieProcessor可以创建对于网站cookie的handler(用户登录);

ProxyHandler是针对代理登录;

HTTPSHandler是针对使用协议加密访问的的网页的;

HTTPPRedirectHandler针对自动跳转的url进行处理。

import urllib2, cookielib

#创建cookie容器

cj = cookielib.CookieJar()

#创建一个opener

opener = urllib2.build_opener(urllib2.HTTPCookieProcessor(cj))

#给urllib2安装opener

urllib2.install_opener(opener)

#使用带有cookie的urllib2访问网页

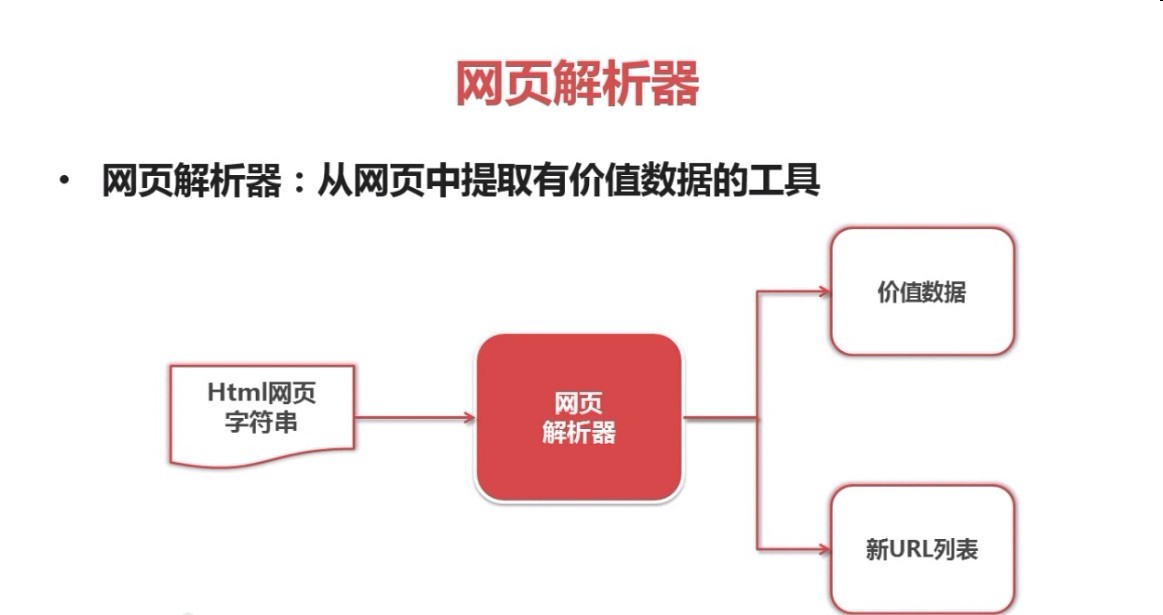

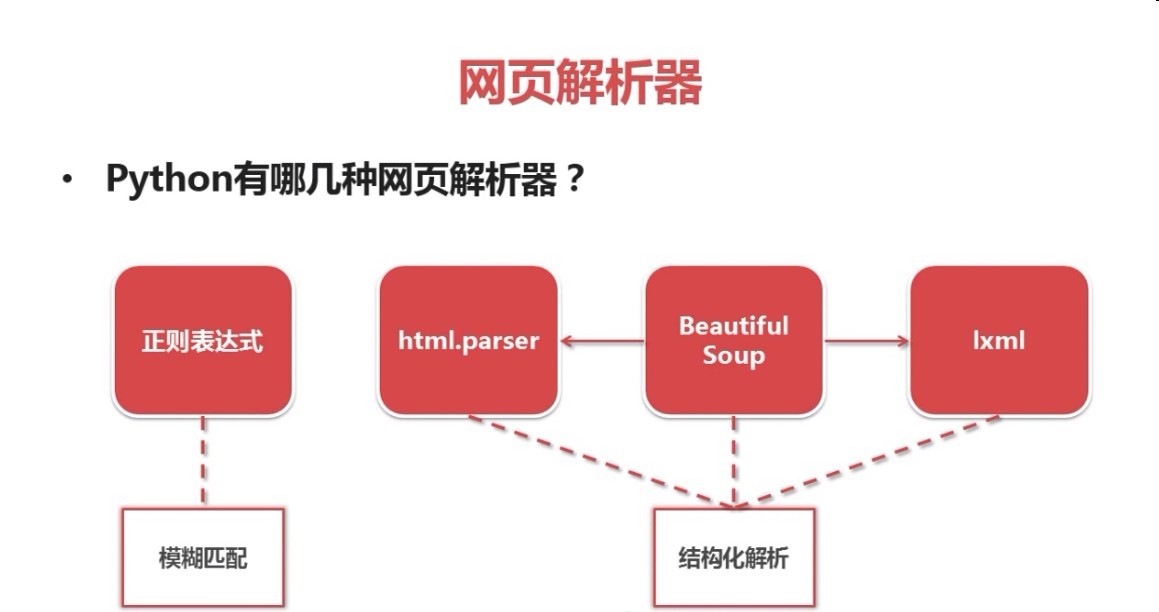

response = urllib2.urlopen('www.baidu.com')网页解析器

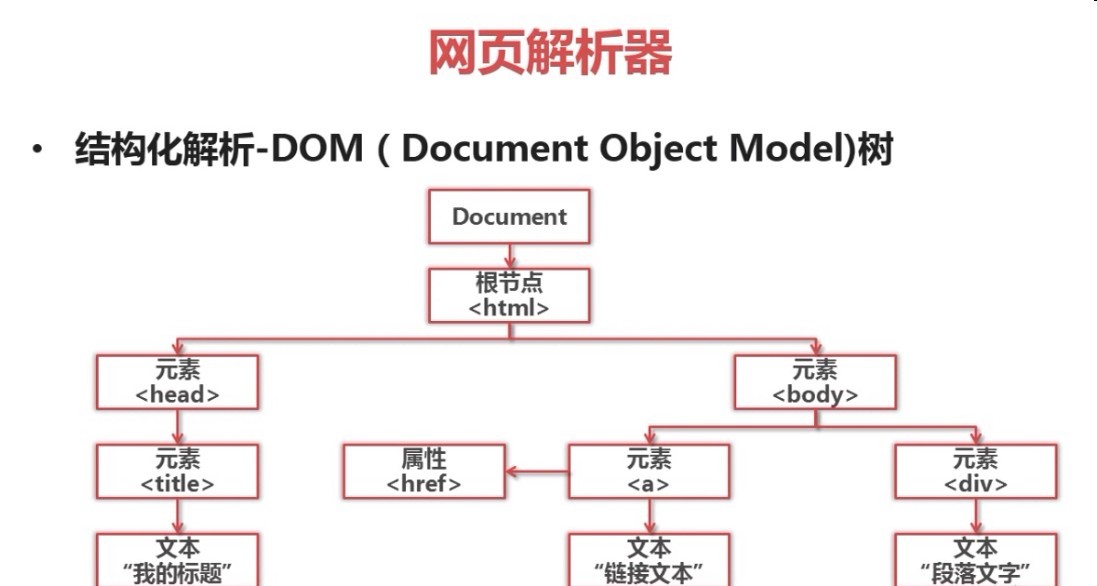

- 结构化解析-DOM(Document Object Model)树

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?