本文由 @lonelyrains 出品,转载请注明出处。

文章链接: http://blog.csdn.net/lonelyrains/article/details/46426645

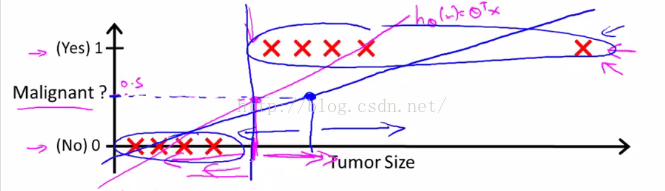

其中紫红色的线表示在未出现最右侧样本点的情况下的预测,而当有最右侧点时,线性回归预测变为蓝色线。这时再看中间的一些点,实际结果都与预测的是相反的。鉴于此,较好的方式是说明预测结果的可能性概率。这个时候用到的是逻辑回归分类。

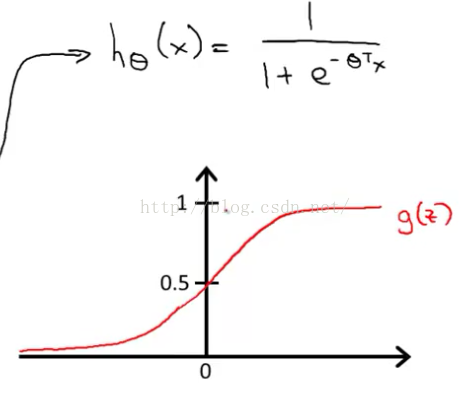

逻辑回归分类利用Sigmoid曲线,可以较好地体现样本分类时,多大地概率可能性接近正或者负分类。

调整参数矩阵,适配不同样本的x向量,使h函数趋近于1或者-1最好了,保证较好地分离。

Sigmoid是一个分界函数,意义是在偏离最小的theta参数下,对新样本进行预测,事实与预期相等的概率。

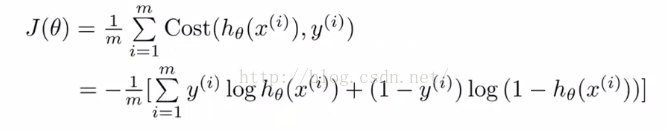

所以在构造代价函数时,如果结果与预测值相反,无限增大代价函数值;而结果与预测值相同时,代价函数为0。

直接将Sigmoid曲线应用于逻辑回归分类,套用线性回归分类的公式,得到的预测曲线可能不是凸函数,有很多局部最优点(具体的数学理论可以不必太关心)。这时,可以用变形的代价函数。

4814

4814

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?