作者:周志湖

微信号:zhouzhihubeyond

本文主要内容

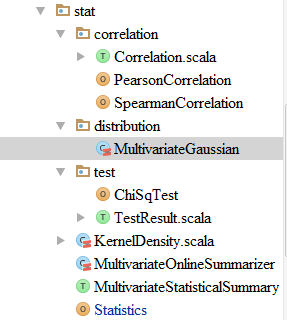

本文对了org.apache.spark.mllib.stat包及子包中的相关统计类进行介绍,stat包中包括下图中的类或对象:

本文将对其中的部分内容进行详细讲解

- 获取矩阵列(column-wise)统计信息

- Kernel density estimation(核密度估计)

- Hypothesis testing(假设检验)

1. 获取矩阵列(column-wise)统计信息

获取列统计信息指的是以矩阵中的列为单位获取其统计信息(如每列的最大值、最小值、均值等其它统计特征)

package cn.ml.stat

import org.apache.spark.SparkConf

import org.apache.spark.SparkContext

import org.apache.spark.mllib.linalg.Vectors

import org.apache.spark.mllib.stat.Statistics

import org.apache.spark.mllib.stat.MultivariateStatisticalSummary

object StatisticsDemo extends App {

val sparkConf = new SparkConf().setAppName("StatisticsDemo").setMaster("spark://sparkmaster:7077")

val sc = new SparkContext(sparkConf)

val rdd1= sc.parallelize(

Array(

Array(1.0,2.0,

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

560

560

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?