欠拟合与过拟合概念

本次课程大纲:

1、 局部加权回归:线性回归的变化版本

2、 概率解释:另一种可能的对于线性回归的解释

3、 Logistic回归:基于2的一个分类算法

4、 感知器算法:对于3的延伸,简要讲

复习:

令

n为特征数量

定义成本函数J,定义为:

m为训练样本

通过正规方程组推导的结论:

1、 过拟合与欠拟合

通常,你选择交给学习算法处理的特征的方式对算法的工作过程有很大影响。

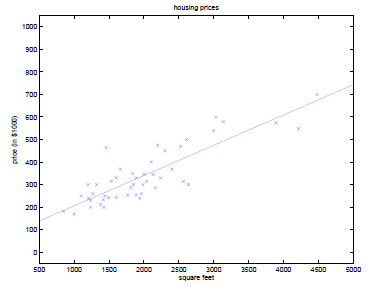

例:上次课的例子中,用x1表示房间大小。通过线性回归,在横轴为房间大小,纵轴为价格的图中,画出拟合曲线。回归的曲线方程为:

若定义特征集合为:x1表示房子大小,x2表示房子大小的平方,使用相同的算法,拟合得到一个二次函数,在图中即为一个抛物线,即:

以此类推,若训练集有7个数据,则可拟合出最高6次的多项式,可以找到一条完美的曲线,该曲线经过每个数据点。但是这样的模型又过于复杂,拟合结果仅仅反映了所给的特定数据的特质,不具有通过房屋大小来估计房价的普遍性。而线性回归的结果可能无法捕获所有训练集的信息。

所以,对于一个监督学习模型来说,过小的特征集合使得模型过于简单,过大的特征集合使得模型过于复杂。

对于特征集过小的情况,称之为欠拟合(underfitting);

对于特征集过大的情况,称之为过拟合(overfitting)

解决此类学习问题的方法:

1) 特征选择算法:一类自动化算法,在这类回归问题中选择用到的特征

2) 非参数学习算法:缓解对于选取特征的需求,引出局部加权回归

本文介绍了机器学习中欠拟合与过拟合的概念,通过局部加权回归(Loess)进行非参数学习以解决过拟合问题。此外,还探讨了线性回归的概率解释,以及Logistic回归和感知器算法在分类问题中的应用。

本文介绍了机器学习中欠拟合与过拟合的概念,通过局部加权回归(Loess)进行非参数学习以解决过拟合问题。此外,还探讨了线性回归的概率解释,以及Logistic回归和感知器算法在分类问题中的应用。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

760

760