0)高斯判别分析模型适用于输入特征x是连续型随机变量的情况,主要目的是确定后验概率p(x|y)。

1)判别模型和生成模型(Discriminative/Generative Model)

2)高斯判别分析(Gaussian Discriminant Analysis(GDA))

2.1) 多元正态分布

2.2) 高斯判别模型分析

2.3) 利用高斯判别模型进行分类

2.4)高斯判别分析(GDA)与logistic回归的关系

0)高斯判别分析模型适用于输入特征x是连续型随机变量的情况,主要目的是确定后验概率p(x|y)。

1)判别模型和生成模型(Discriminative/Generative Model)

Discriminative Algorithms:mapping directly from X to the labels {0, 1}。

Generative Algorithms: try to model p(x|y=0), p(x|y=1),p(x) = p(x|y=1)*p(y=1)+p(x|y=0)*p(y=0),p(y=1),p(y=0)

然后利用贝叶斯公式将统一性:

由于我们关注的是y的离散值结果中哪个概率大,而并不是关心具体的概率,因此上式改写为:

其中![]() 称为先验概率,人为指定或根据每个y=0/1在样本中所占的比例近似;

称为先验概率,人为指定或根据每个y=0/1在样本中所占的比例近似;![]() 称为后验概率,是我们想要真正计算的。

称为后验概率,是我们想要真正计算的。

高斯判别分析:assume that p(x|y) is distributed according to a multivariate normal distribution(多元正态分布)。

2.1) 多元正态分布

多变量正态分布描述的是n维随机变量的分布情况,这里的![]() 变成了向量,

变成了向量,![]() 也变成了矩阵

也变成了矩阵![]() 。写作

。写作![]() 。假设有n个随机变量X1,X2,…,Xn。

。假设有n个随机变量X1,X2,…,Xn。![]() 的第i个分量是E(Xi),而

的第i个分量是E(Xi),而![]() 。

。

概率密度函数如下:

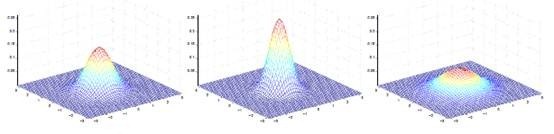

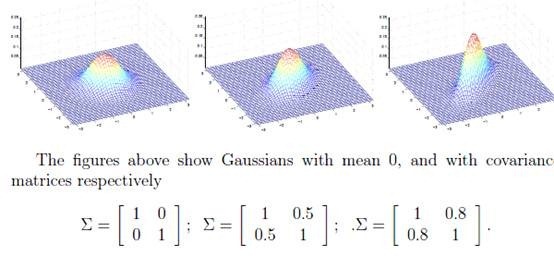

如下图:

2.2) 高斯判别模型分析如果输入特征x是连续型随机变量,那么可以使用高斯判别分析模型来确定p(x|y)。

模型如下:

输出结果服从伯努利分布,在给定模型下特征符合多元高斯分布。通俗地讲,在山羊模型下,它的胡须长度,角大小,毛长度等连续型变量符合高斯分布,他们组成的特征向量符合多元高斯分布。

这样,可以给出概率密度函数:

最大似然估计如下:

注意这里的参数有两个![]() ,表示在不同的结果模型下,特征均值不同,但我们假设协方差相同。反映在图上就是不同模型中心位置不同,但形状相同。这样就可以用直线来进行分隔判别。

,表示在不同的结果模型下,特征均值不同,但我们假设协方差相同。反映在图上就是不同模型中心位置不同,但形状相同。这样就可以用直线来进行分隔判别。

求导后,得到参数估计公式:

如前面所述,在图上表示为:

直线两边的y值不同,但协方差矩阵相同,因此形状相同。![]() 不同,因此位置不同。

不同,因此位置不同。

a)根据训练样例,利用2.2)中描述的方法计算出了高斯判别模型中的4个参数。

b)对于一个新的待分类数据x,根据下面的式子计算p(x|y=0)*p(y=0)和p(x|y=1)*p(y=1)哪个大,对应的y就是x要归为的类。

将GDA用条件概率方式来表述的话,如下:

进一步推导出

也就是说,如果p(x|y)符合多元高斯分布,那么p(y|x)符合logistic回归模型。反之,不成立。为什么反过来不成立呢?因为GDA有着更强的假设条件和约束。

如果认定训练数据满足多元高斯分布,那么GDA在训练集上是最好的模型。然而,我们往往事先不知道训练数据满足什么样的分布,更不应该做很强的假设,此时采用logistic回归的方法就比较合适。 例如,如果训练数据满足泊松分布(而不是多元高斯分布),即

![]()

![]() ,此时p(y|x)仍然是logistic回归的,但不是多元高斯分布,采用GDA效果也会比较差。这也是logistic回归用的更多的原因。

,此时p(y|x)仍然是logistic回归的,但不是多元高斯分布,采用GDA效果也会比较差。这也是logistic回归用的更多的原因。

![clip_image011[8] clip_image011[8]](http://images.cnblogs.com/cnblogs_com/jerrylead/201103/201103052258388155.png)

![clip_image001[4] clip_image001[4]](http://images.cnblogs.com/cnblogs_com/jerrylead/201103/201103052258396419.png)

![clip_image018[28] clip_image018[28]](http://images.cnblogs.com/cnblogs_com/jerrylead/201103/201103052258476117.png)

![clip_image025[6] clip_image025[6]](http://images.cnblogs.com/cnblogs_com/jerrylead/201103/201103052259044957.png)

![clip_image026[8] clip_image026[8]](http://images.cnblogs.com/cnblogs_com/jerrylead/201103/201103052259053363.png)

![clip_image027[8] clip_image027[8]](http://images.cnblogs.com/cnblogs_com/jerrylead/201103/201103052259066611.png)

![clip_image028[4] clip_image028[4]](http://images.cnblogs.com/cnblogs_com/jerrylead/201103/20110305225909982.png)

![clip_image035[8] clip_image035[8]](http://images.cnblogs.com/cnblogs_com/jerrylead/201103/201103052259177615.png)

![clip_image038[4] clip_image038[4]](http://images.cnblogs.com/cnblogs_com/jerrylead/201103/201103052259216172.png)

4070

4070

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?