朴素贝叶斯,选择具有最高概率的决策。

优点:在数据较少的情况下仍然有效,可以处理多类别问题。

缺点:对于输入数据的准备方式较为敏感。

适用数据类型:标称型数据。

条件概率的计算公式:

P(gray | bucketB) = P(gray and bucketB) / P(bucketB)

贝叶斯准则:

p(c|x) = p(x|c)p(c) / p(x)

贝叶斯分类准则:

如果P(c1|x,y) > P(c2|x,y),那么属于类别c1。

如果P(c1|x,y) < P(c2|x,y),那么属于类别c2。

朴素贝叶斯的一般过程

收集数据:可以使用任何方法。本章使用RSS源。

准备数据:需要数值型或者布尔型数据。

分析数据:有大量特征时,绘制特征作用不大,此时使用直方图效果更好。

训练算法:计算不同的独立特征的条件概率。

测试算法:计算错误率。

使用算法:一个常见的朴素贝叶斯应用是文档分类。可以在任意的分类场景中使用朴素贝叶斯分类器,不一定非要是文本。

p(ci|w)=p(w|ci)p(ci)/p(w) w表示一个向量。

函数的伪代码如下:

计算每个类别中的文档数目

对每篇训练文档:

对每个类别:

如果词条出现文档中——增加该词条的计数值

增加所有词条的计数值

对每个类别:

对每个词条:

将该词条的数目除以总词条数目得到条件概率

返回每个类别的条件概率chapter 4.5.4 准备数据:文档词袋类型

词集模型 (sef-of-words-models) :将每个词的出现与否作为一个特征

词袋模型 (bag-of-words-models) :如果一个词在文档中出现不止一次,这可能意味着包含该词是否出现在文档中所不能表达的某种信息。

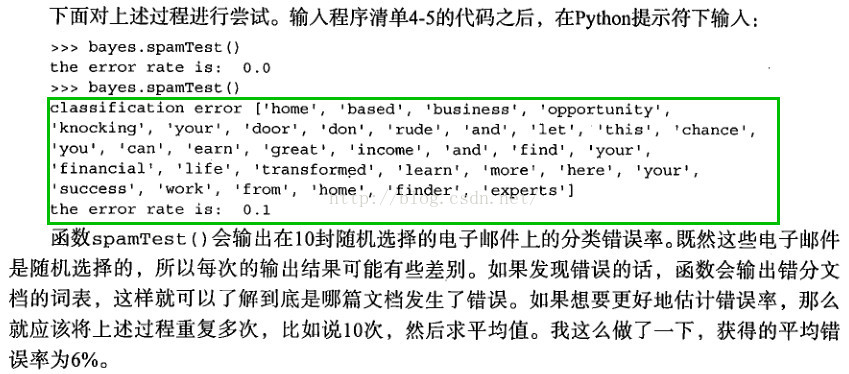

chapter 4.6.2 测试算法:使用朴素贝叶斯进行交叉验证

如果想要更好地估计错误率,那么就应该上述过程重复多次,比如说10次,然后就平均值。

这里要指出的是,书中漏写一段代码,关于 classification error 列表的输出。

完整代码如下:

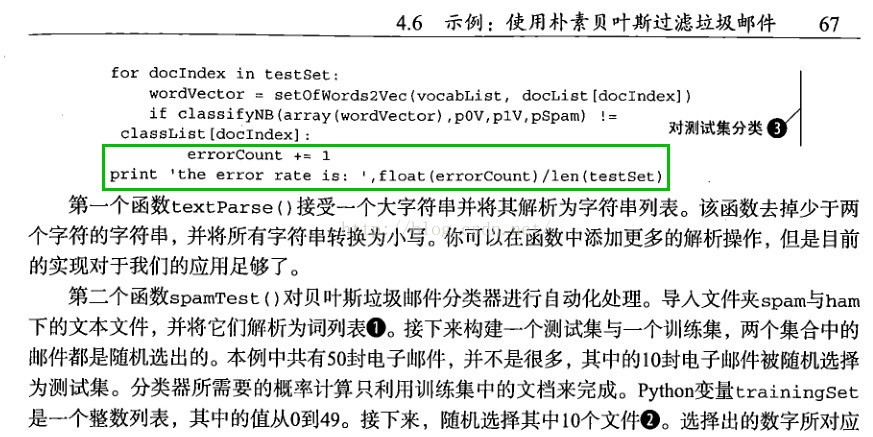

for docIndex in testSet:

wordVector = bagOfWords2VecMN(vocabList, docList[docIndex])

if classifyNB(array(wordVector),p0V,p1V,pSpam) != classList[docIndex]:

errorCount += 1

print 'classification error ',docList[docIndex]

print 'the error rate is: ',float(errorCount)/len(testSet)

小结:

对于分类而言,使用概率有时要比使用硬规则更为有效。贝叶斯概率及贝叶斯准则提供了一种利用已知值来估计未知概率的有效方法。

2298

2298

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?