环境:

1、windows7、eclipse

2、centos6.6、hadoop版本为CDH5.4.1,4台物理机搭建的集群1、将hadoop-eclipse-plugin-2.6.0.jar放入eclipse的plugins目录下,重启eclipse

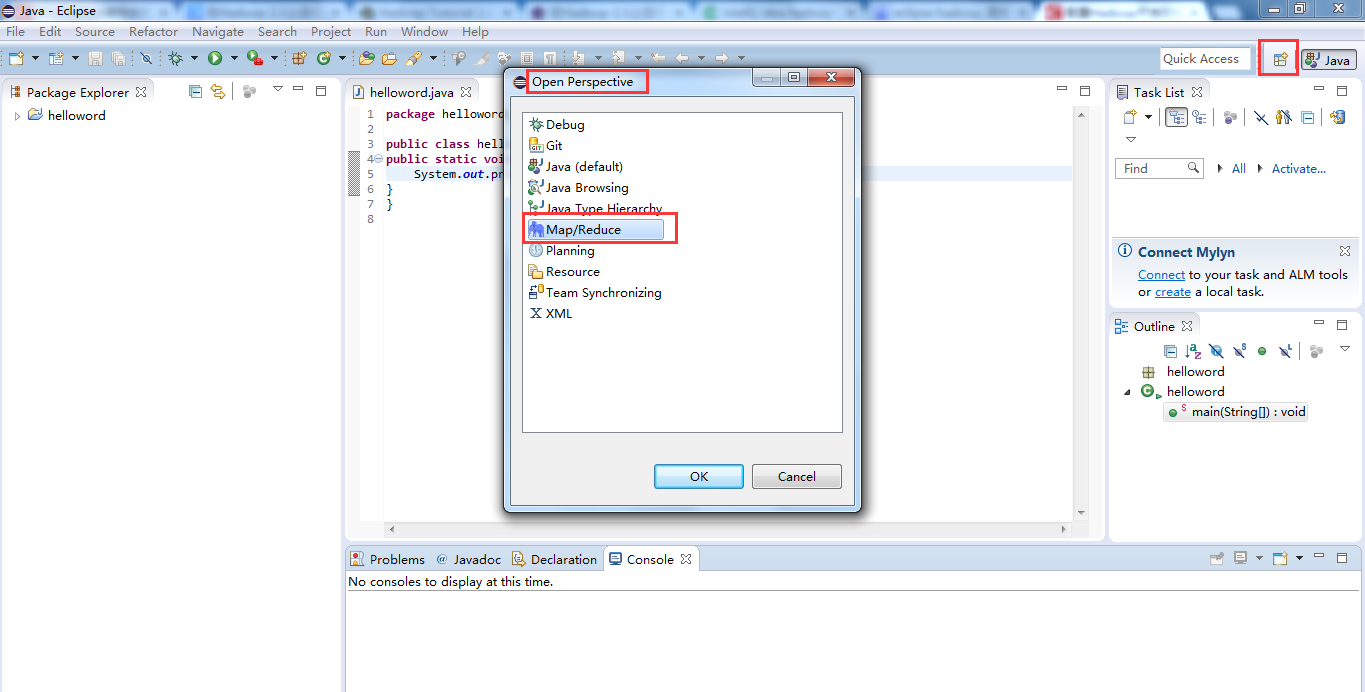

2、然后通过Open Perspective菜单打开Map Reduce视图:

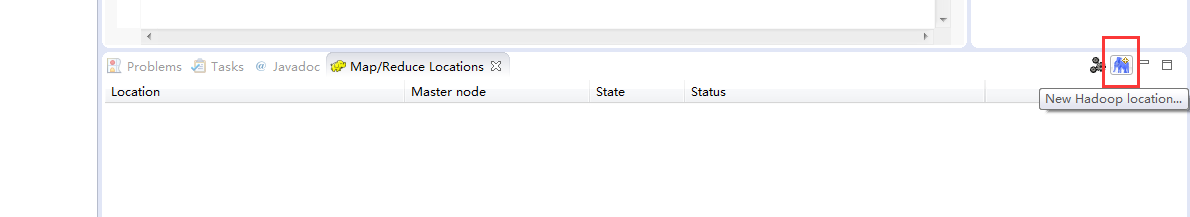

3、然后选中大象图标:

4、填写正确的Map/Reduce和HDFS信息。(具体根据您的配置而定):

(1)map/reduce master这个框里 host和port:就是jobtracker的ip和port,这两个参数就是mapred-site.xml里面的mapred.job.tracker里面的ip和port。

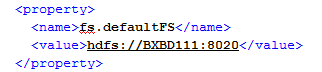

(2)端口8020为core-stie.xml中的参数设置

(3)User name为hadoop的用户名。

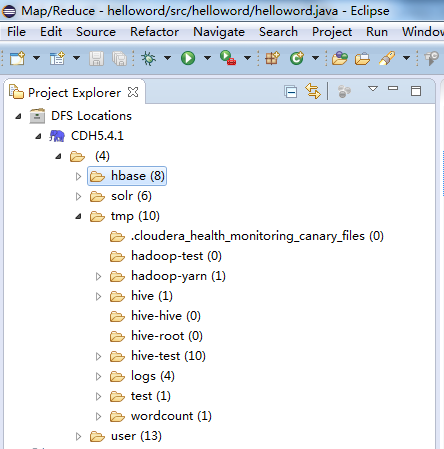

5、此时,你可对DFS进行一些操作,比如上传本地文件到HDFS等等,如下图:

至此,Hadoop的开发环境大致配置完成。

513

513

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?