列表是一个类似于数组的东西,但是却比数组更加智能

数组里类型必须一致,而列表中的数据类型可以不一致,可以混合(可以同时包含整型,浮点型,字符串,对象等等)。

普通列表: tmp = [1, 2 ,3]

混合列表: tmp = [1, 2, 'str1', 'str2', [4, 'A']]

空列表: tmp = []

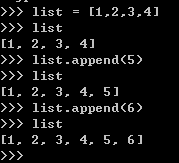

向列表中增加元素

(1)增加一个元素 append()

并且增加的元素都是在末尾增加

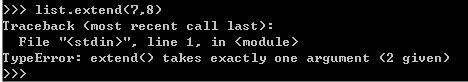

(2)增加多个元素 extend()

如果你想要增加两个元素在末尾,直接像增加一个元素的方法添加是不对的,添加多个元素时,必须是用列表框起来

(3)在任意位置插入元素 insert()

我们前面不管是增加一个元素还是增加多个元素,都只能在列表的末尾添加,如何在列表任意位置插入呢,这时候就需要insert()

insert(插入的位置下标,插入的元素)

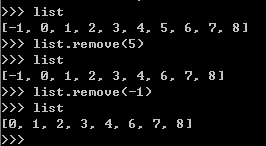

从列表中删除元素

(1)删除指定元素 remove()remove(删除的元素值)

(2)删除指定下标的元素,删除整个列表 del

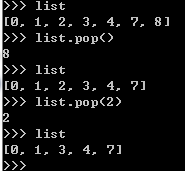

(3)删除最后一个元素或删除指定下标元素 pop()

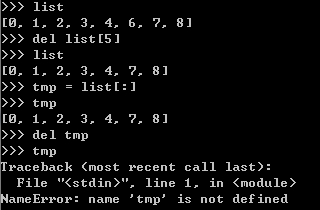

列表分片(切片)

如何一次性获取多个元素呢?

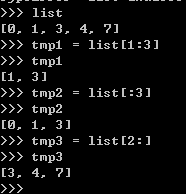

tmp可以得到列表list的拷贝,而原列表是不会发生改变的

list[1:4] 相当于从列表下标为1开始取元素拷贝,一直到下标为4停止(不会取到下标为4的值)

list[ :5] 相当于从最开始的0号下标开始取元素拷贝,直到5为止

list[3: ] 相当于从下标为3开始取元素进行拷贝,一直拷贝到结束

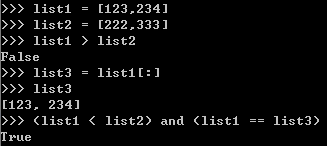

list[ : ] 相当于完全的将list的所有元素都拷贝一模一样的一份

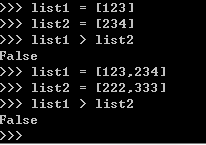

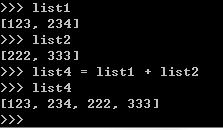

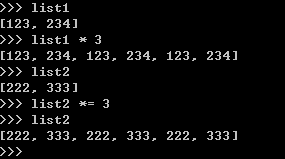

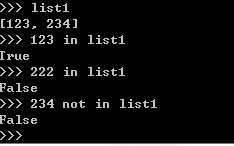

列表常用的操作符

(1)比较操作符

(2)逻辑操作符

(3)连接字符串

(4)重复操作符

(5)成员关系

如何访问列表中内嵌列表的值

类似于二维数组的访问

下面我们在学习几个内置函数

(1)count(i) 寻找在列表中i出现的次数

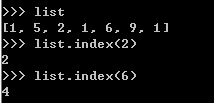

(2)index(i) 查找i第一次出现的位置,返回一个下标

index(i,begin,end) 寻找i在begin位置开始,end位置结束时出现的下标位置

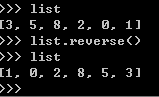

(3)reverse() 将列表逆置过来

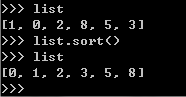

(4)sort() 排序(默认为升序)

那么如果想降序呢?

sort()其实默认为sort(reverse == false)升序,要想列表排序出来是降序,那么就是翻转逆置一下就可以了

sort(reverse(True))或者是sort(reverse == True)这列表中的元素经过升序排序后又逆置,那么就可以得到降序排序了

93

93

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?