最早是上学期元旦的时候老板发邮件让我看这篇paper,但是当时一直在复习随机过程跟矩阵论一直没时间细看。后来这学期选修的机器学习课的老师也安排了这个文献的阅读。于是乎就仔细的看了两遍。。(虽然很科普,没有很多的公式推理,但本人看得还是很模糊),现在把本人的一些阅读认识写下来跟大家共同分享。认识不当之处希望相互指正。

摘要介绍:人类能够通过几个简单的例子就能够学会新的概念,但是机器的学习算法确需要几十甚至几百倍的数据训练才能达到相近的准确性。所以作者在本文中提出了一种计算模型,用来模拟人类的这些学习能力,将其用于识别大量类别的手写字符的。该模型在贝叶斯准则下对观察到的例子给出了最好的解释。在一个具有挑战性的一次性分类任务上,该模型实现了人类层面的性能胜过最近的深度学习方法。该论文也通过”视觉图灵测试”探索了模型创造性泛化能力,表明该模型在很多方面和人类的行为是极为相似的。

主要的理念:语义合成性、因果关系、学会学习;

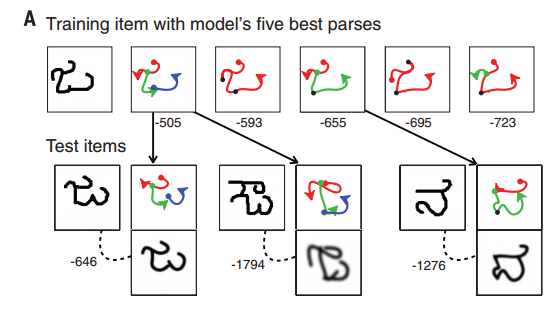

复杂的概念能够通过“语义合成性”由简单的基元形成;这种的概率语义处理噪声并且支持创造性的归纳然后产生一个类别的例子,不像其他的概率模型,仅仅捕捉真实世界事物的”抽象“的因果结构的过程。学习过程中利用贝叶斯准则下构造的程序最好的解释了观察结果,”学会学习“模型利用分层的先验概率,通过当前的先验知识帮助学习新的概念。BPL能够通过重复使用存在样本的碎片,构造新的样本,用于获取现实生活中产生过程的“因果”属性在多尺度下进行操作。

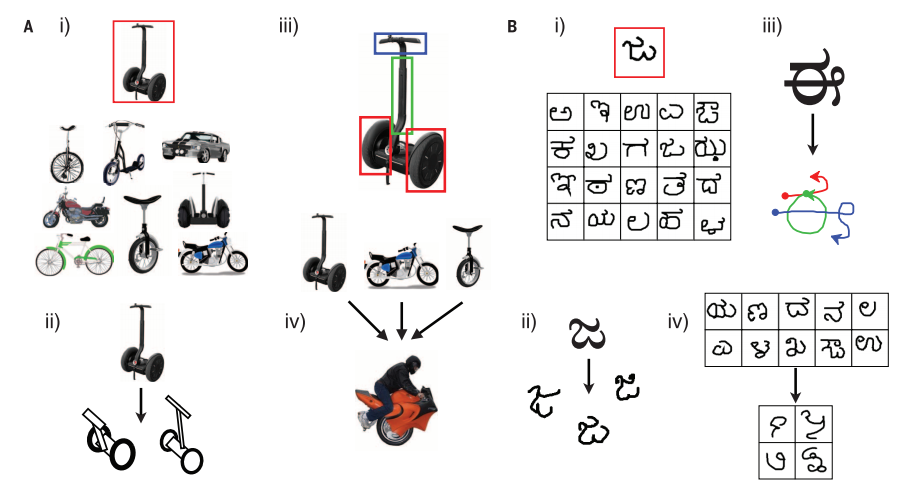

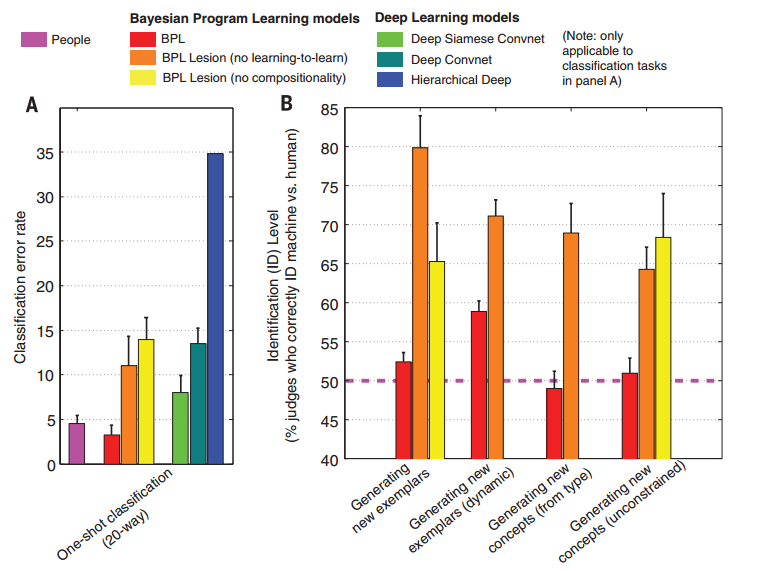

具体的思路和内容:每个concept都是有多个简单的“组件”构成,”组件“之间有位置、时间、因果等关系,这些“组件”根据一定的关系选择性的组合,就会得到相应的concept的实例,进而作出一次性的分类或者产生新的样例;BPL就是这种将上述关系参数化的一个model,通过一定的概率计算,自动的学习这些参数;最后将BPL应用在手写字符的单样本概念学习中,并且实现模拟手写字符、一次性分类手写字符、产生新的手写字符。然后将效果(错误率)与几种深度学习方法、人工方法进行对比;最后通过对上述语义合成性、因果关系、学会学习三个条件分别进行限制,测试ID Leve的水平。(具体生成手写字符模型的伪代码算法我不是很懂)

一次性归类的过程(同时能够生产新的concept):

我们的策略是使用快速的自底向上的方法引入一系列的候选解析,使用连续优化和局部搜索,形成离散的后验概率分布的近似值;最后由概率的后验分布选出最优类别属性。

实验结果分析:

通过两个来自于不同的训练集(这些训练集由自于5个不同的背景的字符组成),BPL对于一次性分类实现了近似与人的表现(在两个训练集上分别只有4.3%和4.0%的错误率),相反,深度卷积网络的错误率分别达到了24.0%和22.3%;结果表明,虽然“learn to learn”是BPL获得成功的至关重要的一部分,但是模型的结构使它在有限的背景训练下能够充分的利用语义相似性的优点。本文还指出模型生成新样本的能力是通过测试至关重要的因素,它主要是产生合理的新颖的字符,而不是文体本身一直的字符。

最后这篇论文的Discussion部分主要介绍了BPL在机器学习和计算机视觉领域潜在的一些应用,比如BPL怎么在演讲领域的应用。以及再次强调了语义合成性、因果关系、学会学习这些原理和人层面的一次性分类的相似性。

3096

3096

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?