1、准备工作

下载地址: Kafka官网地址: http://kafka.apache.org/ 2、开始安装

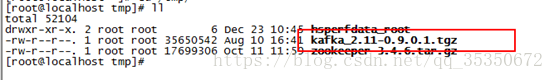

1、把下载好的kafka压缩包上传到服务器上/tmp上

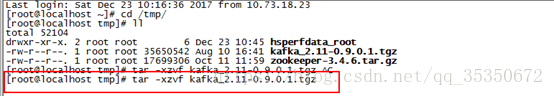

2、解压kafka的安装包:tar -xzvfkafka_2.11-0.9.0.1.tgz

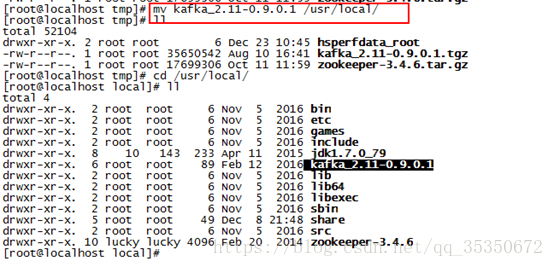

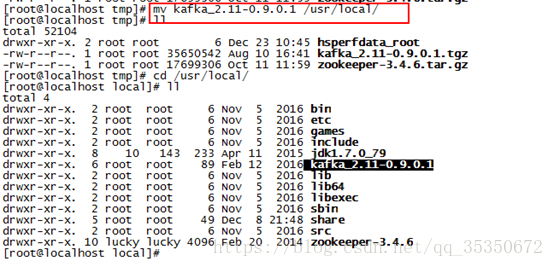

3、把kafka包移动到目录/usr/local; mv kafka_2.11-0.9.0.1/usr/local/

4、配置 kafka 环境变量(可选)

4、配置 kafka 环境变量(可选)

vi /etc/profile

在profile中添加如下内容

KAFKA_HOME=/opt/kafka_2.11-0.9.0.1

PATH=$PATH:$KAFKA_HOME/bin

6、修改/usr/local/kafka/config/servier.properties

############################# Server Basics #############################

# 唯一标识一个broker. /为依次增长的:1、2、3、4,集群中唯一id

broker.id=1

############################# Socket Server Settings

#绑定服务监听的地址和端口,要填写hostname -i 出来的地址,否则可能会绑定到127.0.0.1,producer可能会发不出消息

listeners=PLAINTEXT://:9092

#broker对producers和consumers服务的地址和端口,如果没有配置,使用listeners的配置,本文没有配置该项

host.name=本机IP

advertised.host.name=本机IP

# 处理网络请求的线程数

num.network.threads=3

# 处理磁盘I/O的线程数

num.io.threads=8

# socket server的发送buffer大小 (SO_SNDBUF)

socket.send.buffer.bytes=102400

# socket server的接收buffer大小 (SO_RCVBUF)

socket.receive.buffer.bytes=102400

#一个请求的最大size,用来保护防止oom

socket.request.max.bytes=104857600

############################# Log Basics #############################

#存放日志和消息的目录,可以是用逗号分开的目录,同样不推荐使用/tmp

log.dirs=/usr/local/kafka_2.11-0.9.0.1/logs

#每个topic默认partitions的数量,数量较大表示消费者可以有更大的并行度。

num.partitions=1

num.recovery.threads.per.data.dir=1

#日志的过期时间,超过后被删除,单位小时

log.retention.hours=168

#一个日志文件最大大小,超过会新建一个文件

log.segment.bytes=1073741824

#根据过期策略检查过期文件的时间间隔,单位毫秒

log.retention.check.interval.ms=300000

############################# Zookeeper #############################

#Zookeeper的连接配置,用逗号隔开, kafka数据在zk中的根目录

zookeeper.connect=fee-prod-zk1:2181,fee-prod-zk2:2181,fee-prod-zk3:2181

# 连接zk的超时时间

zookeeper.connection.timeout.ms=6000

7、启动

/usr/local/kafka/bin/kafka-server-start.sh -daemon /usr/local/kafka/config/server.properties

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?