在处理文本时,经常遇到超过1g存储的数据,直接简单的读取,可能遇到java空间不足的问题,为解决此问题,可将大文本数据按照行进行切分为很多块,并将每一块存储为一个文本。然后单独去操作每一个小文本,比如,我所做的分词,便是利用此原理。所要分词的文本是几个G,所有我将这样一个大文本切割成一个一个的小文本,接着对每个小文本进行分词。

public class BigDataRead {

/*

* author:合肥工业大学 管院学院 钱洋

* email:1563178220@qq.com

*/

public static void main(String[] args) throws IOException {

long timer = System.currentTimeMillis();

int bufferSize = 20 * 1024 * 1024;//设读取文件的缓存为20MB

//建立缓冲文本输入流

File file = new File("I:/qianyang/预测数据/user_contentdetection_qianyang");

FileInputStream fileInputStream = new FileInputStream(file);

BufferedInputStream bufferedInputStream = new BufferedInputStream(fileInputStream);

//注意这里有时会乱码,根据自己的文本存储格式,进行调整

InputStreamReader inputStreamReader = new InputStreamReader(bufferedInputStream,"utf-8");

BufferedReader input = new BufferedReader(inputStreamReader, bufferSize);

//要分割的块数减一,这里表示分割为31个文件

int splitNum = 30;

//12046表示我的输入本文的行数,我的文本12046行,由于每行文本较长,所有存储占用较大

int fileLines = 12046;

//分割后存储每个块的行数

long perSplitLines = fileLines / splitNum;

for (int i = 0; i <= splitNum; ++i){

//分割

//每个块建立一个输出

BufferedWriter output = new BufferedWriter( new OutputStreamWriter( new FileOutputStream( new File("I:/qianyang/预测数据/分块/part" + i + ".txt")),"gbk"));

String line = null;

//逐行读取,逐行输出

for (long lineCounter = 0; lineCounter < perSplitLines && (line = input.readLine()) != null; ++lineCounter)

{

output.append(line + "\r");

}

output.flush();

output.close();

output = null;

}

input.close();

timer = System.currentTimeMillis() - timer;

//我的1.6g数据不要1分钟,分割完毕

System.out.println("处理时间:" + timer);

}

}

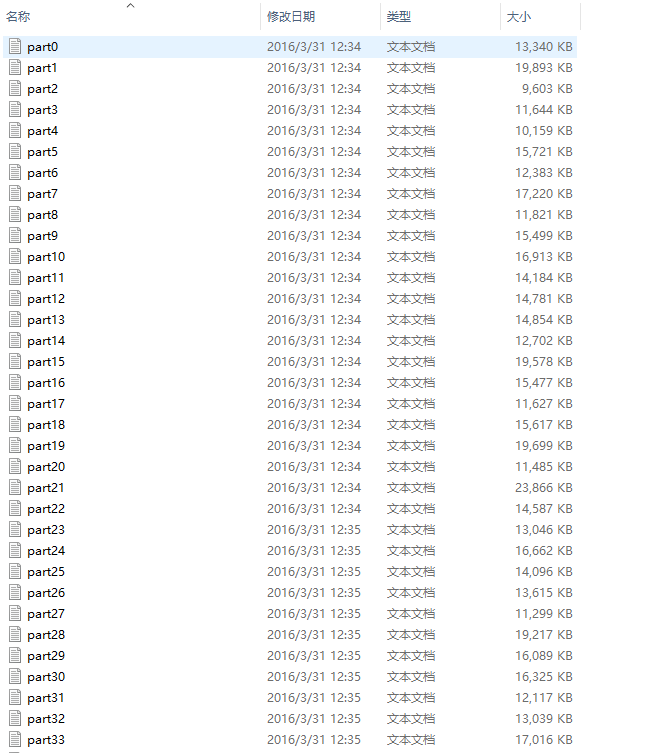

操作结果如下图所示,将一个文本切分成了一个一个的小文本:

1889

1889

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?