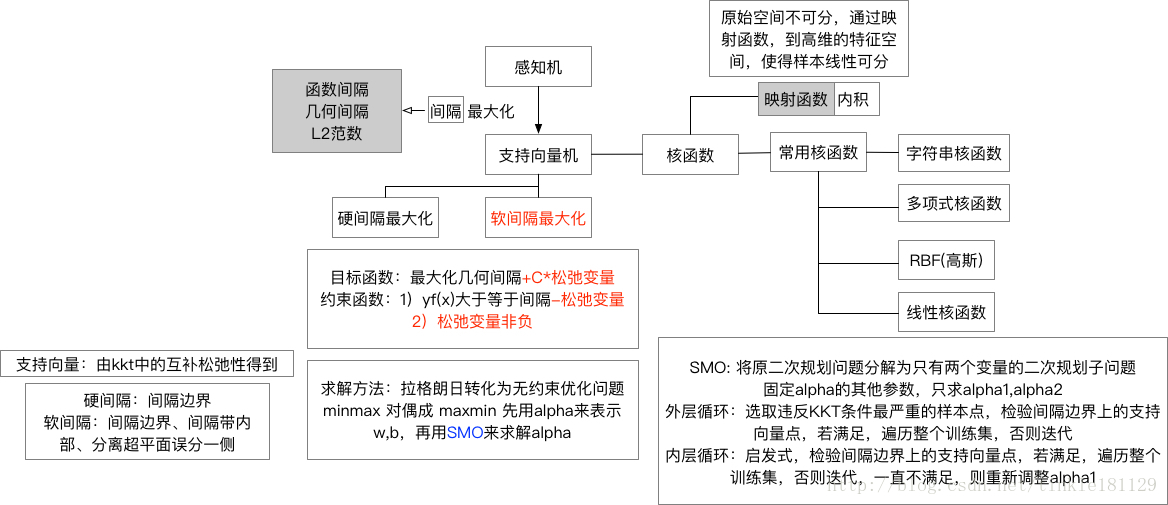

- SVM 知识框架

- SVM的原理是什么?

有别于感知机,SVM在特征空间中寻找间隔最大化的分离超平面的线性分类器 - SVM为什么采用间隔最大化?

超平面可以有无穷多个,但是几何间隔最大的分离超平面是唯一的,这样的分类结果也是鲁棒的,对未知实例的泛化能力最强。 - 什么是支持向量?

对于硬间隔,支持向量就是间隔边界上的样本点

对于软间隔,支持向量就是间隔边界、间隔带内、分离超平面误分类一侧的样本点

在确定分类超平面时只有支持向量起作用,因此SVM由很少的“重要的“训练样本确定 - 为什么要将SVM的原始问题转化为对偶问题?

更容易求解(引入拉格朗日乘子,将约束优化转化为无约束优化问题)

引入核函数 ( ϕ(x)ϕ(x) ),推广到非线性分类 - 为什么要scale the inputs?(对数据进行归一化处理)

SVM对特征规模非常敏感,如果不对特征进行规范化,会导致生成的间隔带依赖于scale大的那个特征,即生成不合适的svm - 为什么SVM对缺失数据敏感?

不同于决策树,SVM没有处理缺失值的策略,它希望样本在特征空间中线性可分,所以特征空间的好坏对SVM的性能很重要 - 什么是核函数?

当样本在原始空间线性不可分时,可以将样本从原始空间映射到一个更高维的特征空间,使得样本在这个特征空间内线性可分。这个映射函数我们记为 ϕ(x)

在原始问题的对偶问题中需要求解 ϕ(x)ϕ(y) ,直接计算比较困难,因此找一个核函数 k(x,y)=ϕ(x)ϕ(y) ,即在特征空间的内积等于它们在原始样本空间中进行核函数 k 计算 - 常用的核函数有哪些,如何选择?

- RBF核/高斯核 :

k(xi,x

- RBF核/高斯核 :

支持向量机知识点整理

最新推荐文章于 2022-11-30 09:56:32 发布

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2324

2324

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?