上面是从如下地址中截取的内容:https://www.zybuluo.com/Dounm/note/591752#mjx-eqn-eq4

下面说下我对它的理解

还是以“今天 我 和 小明 去 北京 玩” 这句为例

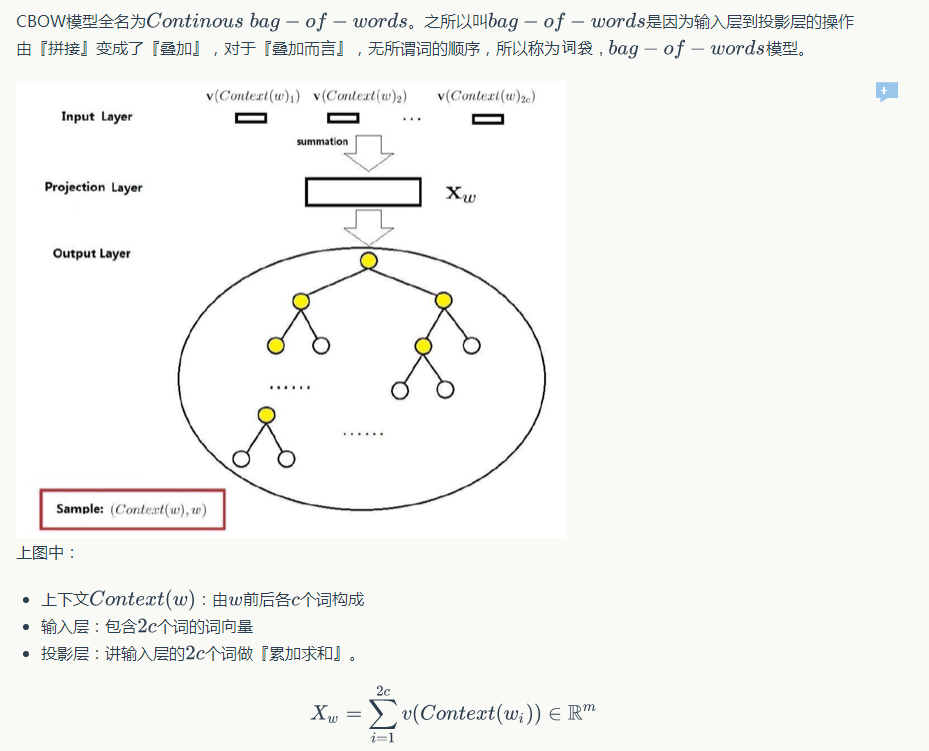

输入层: “小明”的前后三个词向量,即首先要把这些词全部表示成向量

投影层: 将这写词的向量求和,得到的结果就是:

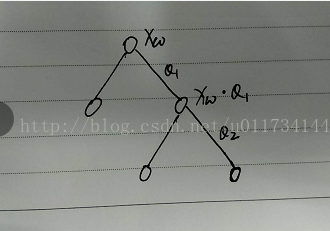

将投影层的向量输入到哈夫曼树中

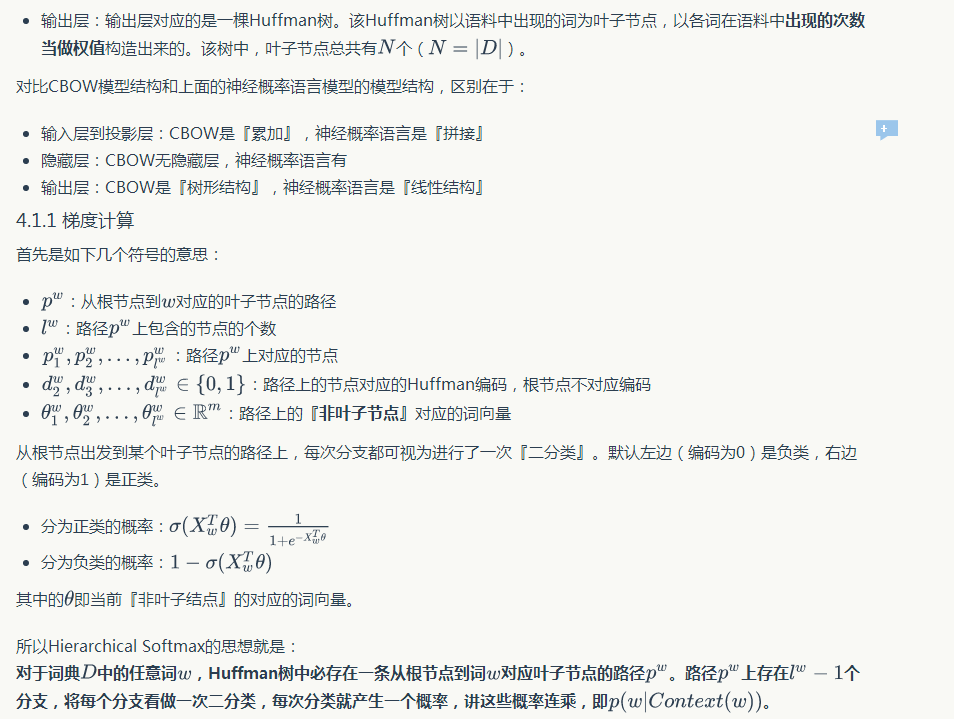

哈夫曼树怎么来的? 将语料库中词以及词出现的频率构造一颗哈夫曼树,默认左边(编码为0)是负类,右边(编码为1)是正类,哈夫曼树的叶子节点就是语料库中的所有的词

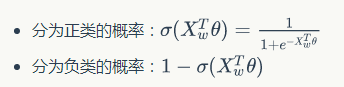

将向量Xw输入到哈夫曼树,在每个节点上进行二分类,每个节点上二分类的概率如下

这里的概率是逻辑回归概率模型

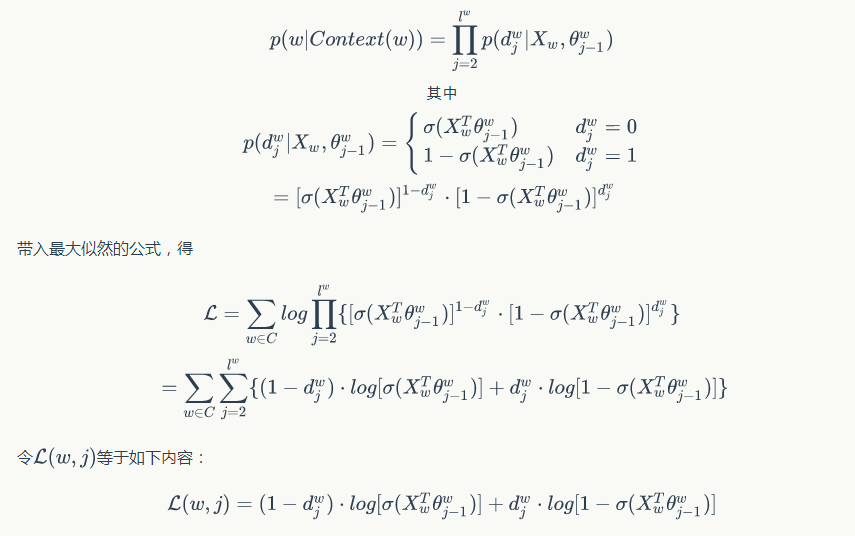

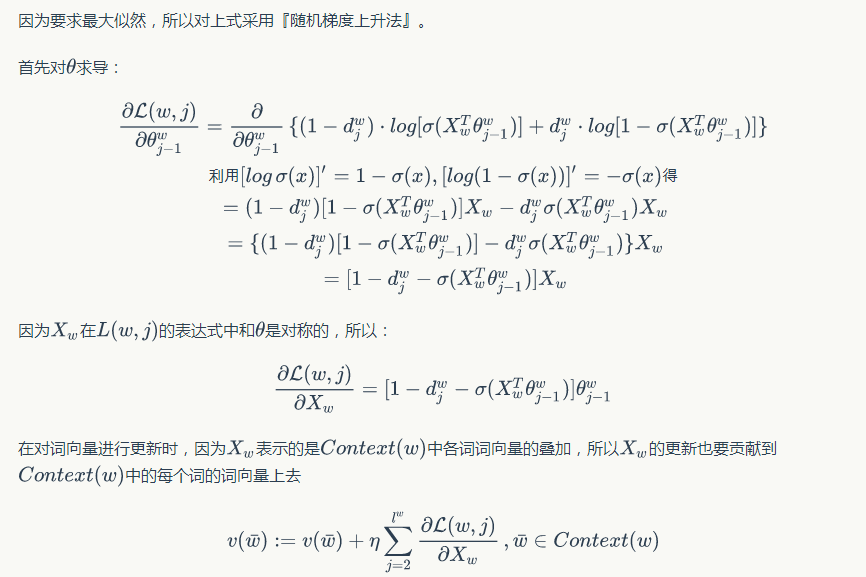

那么我们的目标是沿着哈夫曼树找到最终的叶子节点是“小明”, 那么就求出走到“小明”这个叶子节点的路径的概率,其实就是将这条路线上的概率全部乘起来, 然后极大化这个概率

这里也是采用随机梯度上升法

最后要对各个词的词向量进行更新。另外有一点:

哈夫曼树中,节点之间的连线其实也是一个神经网络连线,两个节点的连线其实也是由很多条连线组成,参数θ是一个权重向量

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?