第二周

第四讲 多元线性回归(Linear Regression with multiple variables)

1.多元线性回归模型

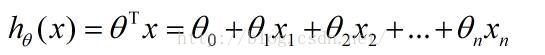

假设/拟合函数Hypothesis:

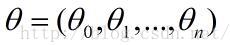

参数parameter:

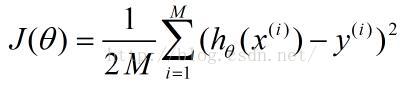

代价函数Cost Function:

目标Goal:

2.梯度下降算法

Gradient decent algorithm

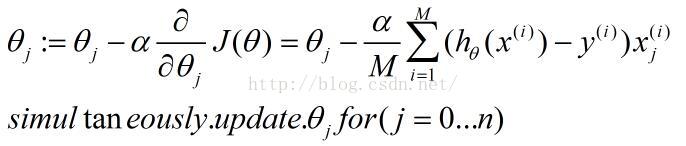

与一元的梯度下降算法一致,沿偏导数的方向按学习速率α的步伐下降,直至代价函数J收敛(或找到局部最优解)

repeat until convergence{

}

★★★3.特征缩放Feature scaling(归一化)

Idea:Make sure features are on a similar scale.

原理:X'=X/(Max-Min)

特征缩放可以理解为平时我们常说的归一化,使得变量x的范围落在区间[-1,1]里,一方面对多个范围差别很大的特征量可以更直观的表示,另一方面当使用梯度下降算法时可以更快的收敛,即迭代次数少。

但要注意的是,特征缩放的使用是有范围的,当-3<x<3 or -1/3<x<1/3属于可接受的范围,如果-100<x<100 or -0.0001<x<0.0001,特征缩放带来的误差较大,不可使用。

特殊地,平均标准化Mean normalization就是基于特征缩放实现的,使得期望E为0;

原理:X' = (X-μ)/(Max-Min),μ为均值

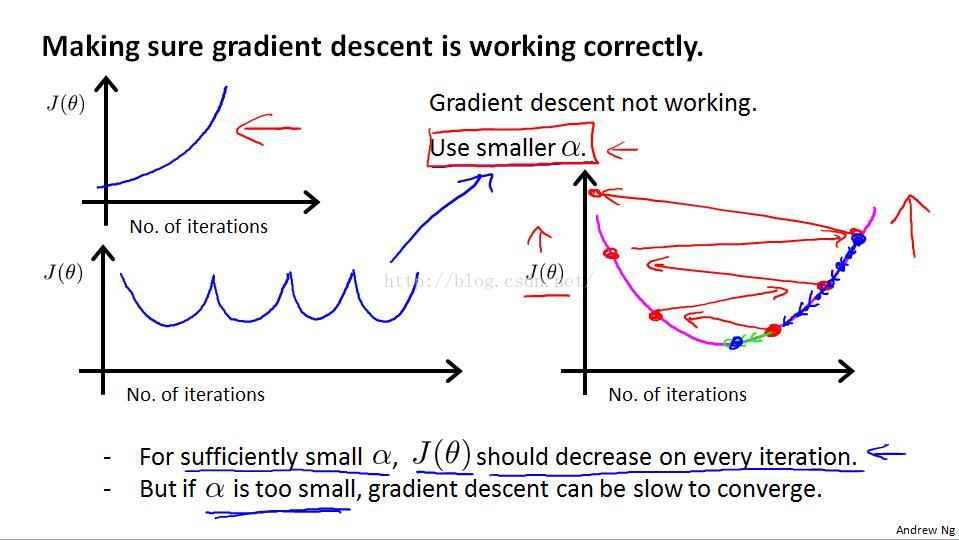

4.学习速率α的选取

α决定每次下降的步长,α的选取决定了gradient decent algorithm是否正常工作(α选择不当J会发散,或者J收敛速度太慢,需要迭代许多次)

理论上讲,只要α充分的小,相应的代价函数J在每次迭代都会减小直至收敛;算法实现上,如果α太小,J每次下降的太少,需要迭代的次数过多,时间复杂度太高又不可行;综上,α的正确选取对于梯度下降算法能否正常工作至关重要,可以给α从0.001,0.01,0.1,1依次幅值,找到对应的区间再去试探合适的α。

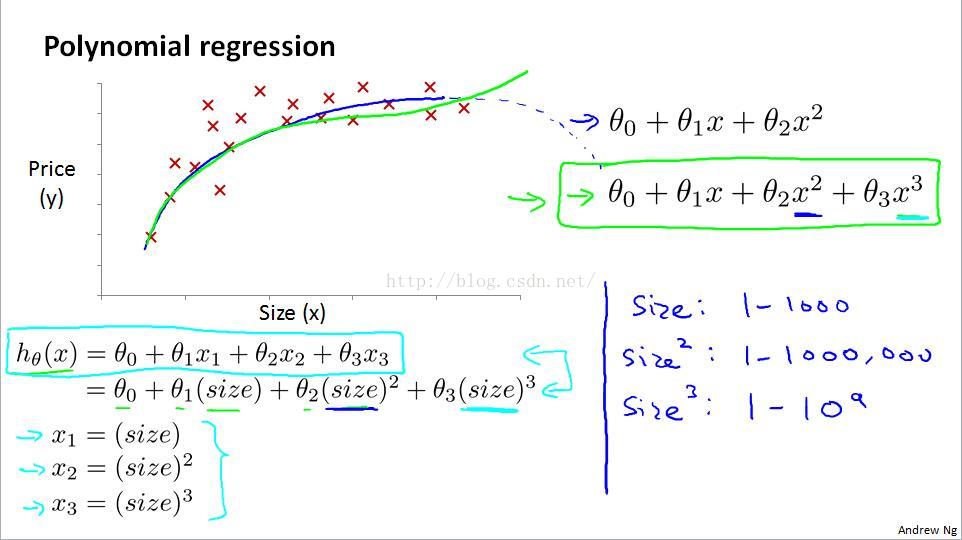

5.多项式回归

Polynomial regression

如果你想用一元高次多项式做拟合函数去拟合离散数据,比如h(x)=θ0+θ1*x+θ2*x^2+θ3*x^3,那么,有一种简单的作法,可以实现一元非线性回归问题转化为多元线性回归问题,从而用gradient decent algorithm解决,这种方法叫多项式回归Polynomial regression.

原理:分别把x^2、x^3看成另外两个特征变量x2,x3,则假设函数h(x)=θ0+θ1*x1+θ2*x2+θ3*x3,通过扩元实现降幂。

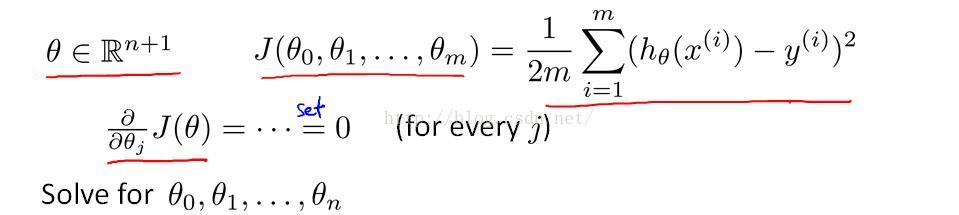

★★★6.正规方程Normal equation

对于多元线性回归模型的算法,常见的有两种:

一种是之前说到的gradient decent algorithm(梯度下降算法),最常用;

还有一种就是normal equation(正规方程),直接求得解析解。

Normal equation:Method to solve for θ analytically.

原理:J对θ的偏导数为零,求解得到的方程组(注意θ为向量):

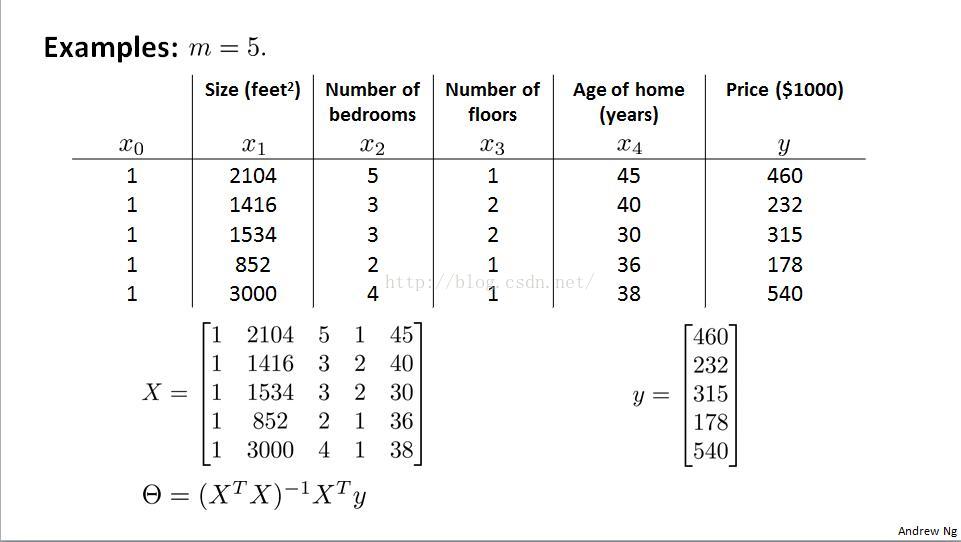

化简有,,利用线性代数的方法得到的θ即为最优解

正规方程可以直接得到全局最优解,不需要像梯度下降算法那样要选择α、迭代次数等,但它也有局限性。

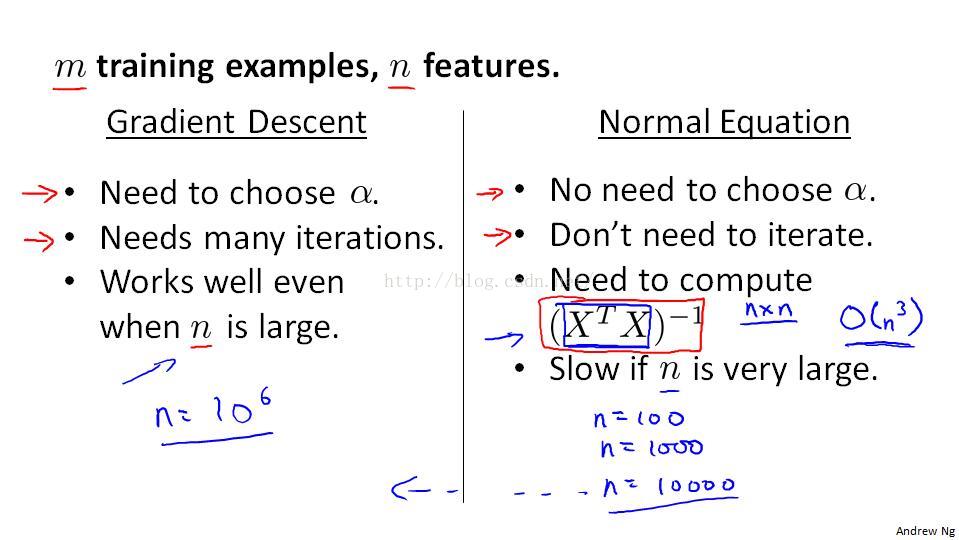

★★★两种算法的比较:

gradient decent Versus normal equation

给定m个样本,n个特征量

Gradient decent:①对于较大的n有很好的效率(n>>1000)②需要合理选取α和迭代次数,以确保J收敛

Normal equation:①利用矩阵元算直接得到最优的解析解,无需迭代和选取α②需要计算(X^T*X)^(-1),时间复杂度O(n^3),对于较大的特征量n(n>1000)运算成本高。

综上,实际上求解线性回归模型,不管是一元线性回归还one variable是多元线性回归multiple variable,最常用梯度下降算法Gradient decent algorithm。

第五讲 Octave/Matlab教程

Octave和Matlab的处理对象是矩阵和向量,开发周期短、速度快,可迁移到C++、Java、Python等环境实现。

①向量化的实现方法Vectorized implementation(矩阵运算替代循环)

②可视化Visualization(会画图plot data)

③常用矩阵操作名称

单位矩阵 identity matrix

转置矩阵 transpose matrix

矩阵A的逆 pinv(A)

End

第二周的课程就到这里,编程作业我觉得收获是很大的,又进一步熟悉了一下matlab的向量化运算方式。

1263

1263

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?