安装步骤

下载编译了Hive的Spark版本

官网下载链接给出的都是编译过Hive的(至少1.6版可以确定是)。CDH自带的Spark都是没有带Hive的,若直接运行./spark-sql,会报错如下Caused by: java.lang.ClassNotFoundException: org.apache.hadoop.hive.cli.CliDriver at java.net.URLClassLoader$1.run(URLClassLoader.java:366) at java.net.URLClassLoader$1.run(URLClassLoader.java:355) at java.security.AccessController.doPrivileged(Native Method) at java.net.URLClassLoader.findClass(URLClassLoader.java:354) at java.lang.ClassLoader.loadClass(ClassLoader.java:425) at sun.misc.Launcher$AppClassLoader.loadClass(Launcher.java:308) at java.lang.ClassLoader.loadClass(ClassLoader.java:358) ... 18 more也可以手动编译带Hive的Spark,见参考博文1,2。

- 测试

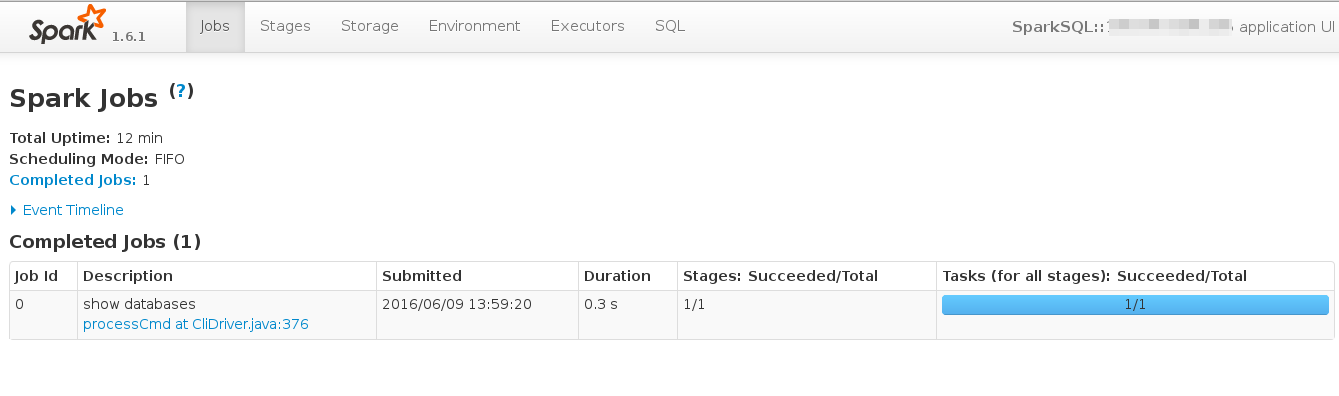

运行./spark-sql后,可以在http://your-host:4040/jobs/界面查看该Spark作业。

在命令行输入show databases;,给出结果default。同时,可以在界面查看到执行该语句的job,见下图,

若执行其它语句时报错,应当是Spark与Hive版本不兼容造成的,见下一小结的解决方案处理。 配置Hive数据源

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

844

844

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?