【前言】

又是一个丰收的时节,一晃眼半年又过去了,每天都是特别的充实,不会再感叹时光易逝。下面总结一下这半年的收获与成长。

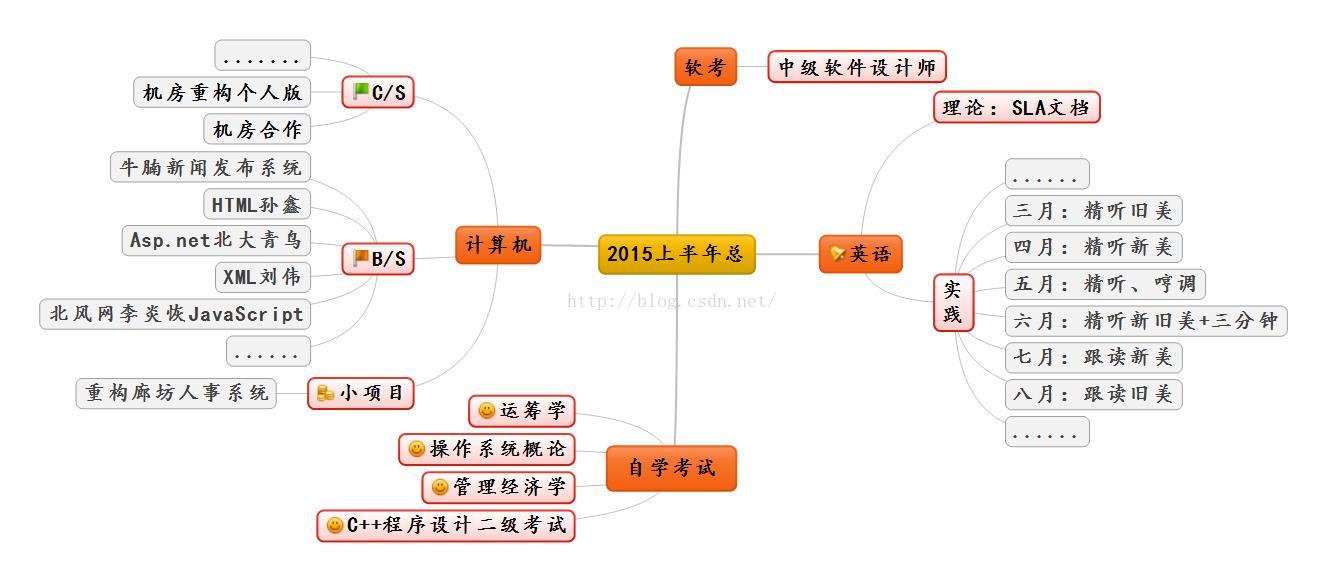

先看一张图:

很明显的展现了我这半年来的学习情况。

【计算机学习】

机房重构个人版:搭建七层、设计模式初体验

机房重构合作版:团队的力量

牛腩新闻发布系统:开启Web前端设计之旅

HTML+CSS:前台界面设计与优化

北大青鸟ASP.NET:网页设计知识积累

重构人事项目:实战MVC

这些都是我在计算机的学习过程中的收获与总结,从一开始的个人版机房重构历时一个多月的探索和学习,对七层有了从理论到实践的深刻认识。机房合作,第一个合作的小项目,真正体验了团队合作的力量,从画图、写文档、编程、设计模式的应用、代码调试等都有了更深层次的理解。进入B/S之后,开始接触网页编程,HTML+CSS是必不可少的,我个人而言,也是比较喜欢弄网页样式的。牛腩新闻发布系统的完成,很有成就感——自己做的小项目也可以发布了。之后的JS在实际的项目中用到的也是比较多的。所以每一步学习的总结都是很有必要的。

【英语学习】——量的积累

哲学上讲质变是由量变积累而成的,量变是质变的基础,没有第一步量变的开始,就没有第二步量变的开始,更没有达成质变的最后一步量变的开始。同理:千里之行也要从第一步开始走,才能一步一步走到达到千里促使质变的最后一步。总不可能像小学寓言里有人埋怨:早知道前面六个烧饼都不吃,只吃第七个烧饼就饱了。所以学英语也是这样,我们不能一口吃个胖子。需要慢慢积累和沉淀。

这半年来主要的学习材料还是新美和旧美,只是形式略有不同。开始是随意听接下来是精听和哼调,现在是跟读。每次学习这俩材料都有不一样的收获,一直提倡重复学习,有些事真的是急不来的,每次的英语答疑活动我并没有发现自己有太多的疑惑,每次师姐布置点什么安排我都是特别乐意完成,不存在抵触心理,站在巨人的肩膀上,自己不断进步。

刚刚过去的这个假期,给自己的英语学习添加了一点新活力:晨读。利用晨读时间先是又复习了一遍赖世雄音标,接下来就是每天早上跟读新美或旧美。找个环境好、空气清新的地方去晨读,一整天的学习都会特别带劲。很开心、很快乐、很充实。

【自学考试】

四月份的时候进行了第二次自考。这次报考的科目是运筹学、操作系统、管理经济学。只有操作系统是计算机专业课程,其他两科是偏文科性的东西。复习起来相对比较简单了就。历时不到两个月的学习,虽然是都通过了,但是还是有一些东西是需要反复学习和积累的。我还报了计算机二级C++程序设计考试。这是第二次报考了,虽然是说等级考试通过了也不可以自考免考了,但是还是想对自己学习的知识进行一次检测,最终是通过了。付出了还是有收获哒。

再有就是软考:中级软件设计师考试。正在紧张备战中。。。

【总结】

半年转瞬即逝,有没有问过自己,你的梦想是离你越来越近了还是越来越远了?还是那句话:趁年轻,多努力。让自己每天都变得充实起来,只有这样我们才会越努力越幸福!

越努力越幸福—2015年度总结

最新推荐文章于 2021-02-17 23:13:57 发布

894

894

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?