因为之前在CNN中用错了BatchNorm的位置,所以特意记录以免再次犯错

- BatchNorm在CNN中的应用(第(1)种正确)

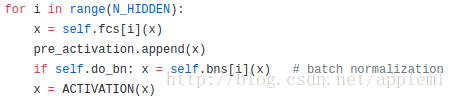

我个人偏向第一种可能,因为在fully connection中batch normalization应用在了激活函数之前

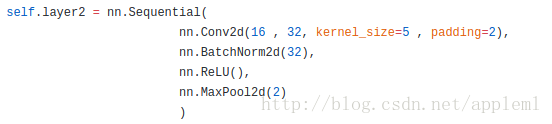

(1)先卷积,再batchnorm, 然后激活函数,最后pooling

https://github.com/PadamSethia/cnn-experiments/blob/master/MNIST-cnn.py

https://github.com/twopointseven/cnn-pytorch/blob/master/cnn.py

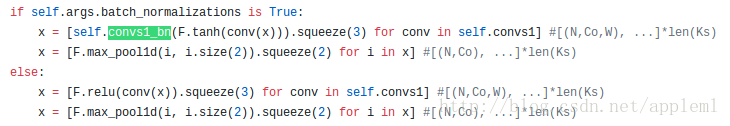

(2) 先卷积,再激活,然后batchnorm, 最后pooling

https://github.com/bamtercelboo/cnn-lstm-bilstm-deepcnn-clstm-in-pytorch/blob/master/models/model_CNN.py - 在fully connection中的应用

用在全连接层之后激活函数之前

https://github.com/MorvanZhou/PyTorch-Tutorial/blob/master/tutorial-contents/504_batch_normalization.py - 在LSTM中的应用

2379

2379

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?