最近需要搭建一套日志监控平台,结合系统本身的特性总结一句话也就是:需要将Kafka中的数据导入到elasticsearch中。那么如何将Kafka中的数据导入到elasticsearch中去呢,总结起来大概有如下几种方式:

- Kafka->logstash->elasticsearch->kibana(简单,只需启动一个代理程序)

- Kafka->kafka-connect-elasticsearch->elasticsearch->kibana(与confluent绑定紧,有些复杂)

- Kafka->elasticsearch-river-kafka-1.2.1-plugin->elasticsearch->kibana(代码很久没更新,后续支持比较差)

elasticsearch-river-kafka-1.2.1-plugin插件的安装及配置可以参考:http://hqiang.me/2015/08/将kafka的数据导入至elasticsearch/

根据以上情况,项目决定采用方案一将Kafka中的数据存入到elasticsearch中去。

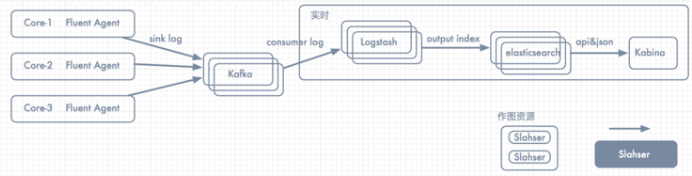

一、拓扑图

项目拓扑图如下所示:

此时消息的整体流向为:日志/消息整体流向Flume => kafka => logstash => elasticsearch => kibana

A.Flume日志收集

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

|

agent.sources = r1

agent.channels = c1

agent.sinks = s1

agent.sources.r1.type = exec

agent.sources.r1.command = tail -F -n 0 /data01/monitorRequst.log

agent.sources.r1.restart =

true

//解决tail -F进程被杀死问题

agent.channels.c1.type = memory

agent.channels.c1.capacity = 1000

|

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

810

810

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?