学习RCNN系列论文时, 出现了感受野(receptive field)的名词, 感受野的尺寸大小是如何计算的,在网上没有搜到特别详细的介绍, 为了加深印象,记录下自己对这一感念的理解,希望对理解基于CNN的物体检测过程有所帮助。

1 感受野的概念

在卷积神经网络中,感受野的定义是 卷积神经网络每一层输出的特征图(feature map)上的像素点在原始图像上映射的区域大小。

RCNN论文中有一段描述,Alexnet网络pool5输出的特征图上的像素在输入图像上有很大的感受野(have very large receptive fields (195 × 195 pixels))和步长(strides (32×32 pixels) ), 这两个变量的数值是如何得出的呢?

2 感受野大小的计算

感受野计算时有下面的几个情况需要说明:

(1)第一层卷积层的输出特征图像素的感受野的大小等于滤波器的大小

(2)深层卷积层的感受野大小和它之前所有层的滤波器大小和步长有关系

(3)计算感受野大小时,忽略了图像边缘的影响,即不考虑padding的大小,关于这个疑惑大家可以阅读一下参考文章2的解答进行理解

这里的每一个卷积层还有一个strides的概念,这个strides是之前所有层stride的乘积。

即strides(i) = stride(1) * stride(2) * ...* stride(i-1)

关于感受野大小的计算采用top to down的方式, 即先计算最深层在前一层上的感受野,然后逐渐传递到第一层,使用的公式可以表示如下:

RF = 1 #待计算的feature map上的感受野大小

for layer in (top layer To down layer):

RF = ((RF -1)* stride) + fsize

stride 表示卷积的步长; fsize表示卷积层滤波器的大小

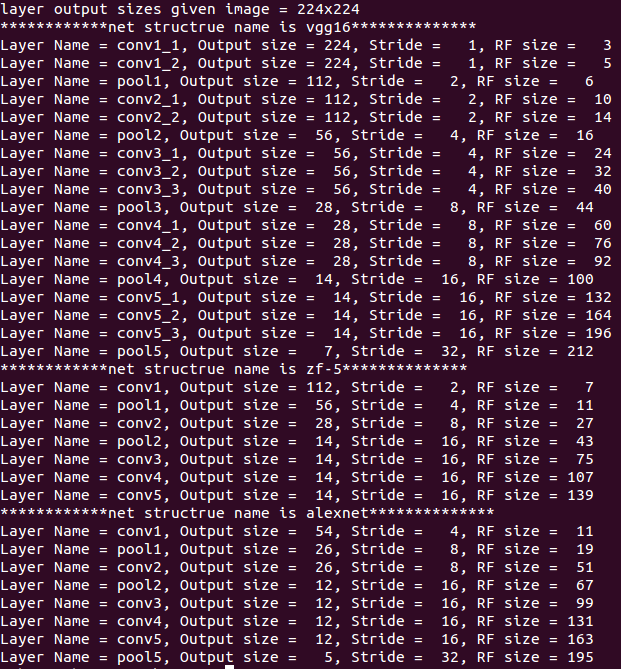

用python实现了计算Alexnet zf-5和VGG16网络每层输出feature map的感受野大小,实现代码:

#!/usr/bin/env python net_struct = {'alexnet': {'net':[[11,4,0],[3,2,0],[5,1,2],[3,2,0],[3,1,1],[3,1,1],[3,1,1],[3,2,0]], 'name':['conv1','pool1','conv2','pool2','conv3','conv4','conv5','pool5']}, 'vgg16': {'net':[[3,1,1],[3,1,1],[2,2,0],[3,1,1],[3,1,1],[2,2,0],[3,1,1],[3,1,1],[3,1,1], [2,2,0],[3,1,1],[3,1,1],[3,1,1],[2,2,0],[3,1,1],[3,1,1],[3,1,1],[2,2,0]], 'name':['conv1_1','conv1_2','pool1','conv2_1','conv2_2','pool2','conv3_1','conv3_2', 'conv3_3', 'pool3','conv4_1','conv4_2','conv4_3','pool4','conv5_1','conv5_2','conv5_3','pool5']}, 'zf-5':{'net': [[7,2,3],[3,2,1],[5,2,2],[3,2,1],[3,1,1],[3,1,1],[3,1,1]], 'name': ['conv1','pool1','conv2','pool2','conv3','conv4','conv5']}} imsize = 224 def outFromIn(isz, net, layernum): totstride = 1 insize = isz for layer in range(layernum): fsize, stride, pad = net[layer] outsize = (insize - fsize + 2*pad) / stride + 1 insize = outsize totstride = totstride * stride return outsize, totstride def inFromOut(net, layernum): RF = 1 for layer in reversed(range(layernum)): fsize, stride, pad = net[layer] RF = ((RF -1)* stride) + fsize return RF if __name__ == '__main__': print "layer output sizes given image = %dx%d" % (imsize, imsize) for net in net_struct.keys(): print '************net structrue name is %s**************'% net for i in range(len(net_struct[net]['net'])): p = outFromIn(imsize,net_struct[net]['net'], i+1) rf = inFromOut(net_struct[net]['net'], i+1) print "Layer Name = %s, Output size = %3d, Stride = % 3d, RF size = %3d" % (net_struct[net]['name'][i], p[0], p[1], rf)

执行后的结果如下:

参考:

1 http://stackoverflow.com/questions/35582521/how-to-calculate-receptive-field-size

4 Convolutional Feature Maps: Elements of Efficient (and Accurate) CNN-based Object Detection

5 Spatial Pyramid Pooling in Deep Convolutional Networks for Visual Recognition

6 http://blog.cvmarcher.com/posts/2015/05/17/cnn-trick/

这篇文章主要讲一下Convolutional Neural Network(CNN)里面的一些概念以及技巧。

Receptive Field (感受野)

这是一个非常重要的概念,receptive field往往是描述两个feature maps A/B上神经元的关系,假设从A经过若干个操作得到B,这时候B上的一个区域 areab areab只会跟a上的一个区域相关 areaa areaa,这时候 areaa areaa成为 areab areab的感受野。用图片来表示:

在上图里面,map 3里1x1的区域对应map 2的receptive field是那个红色的7x7的区域,而map 2里7x7的区域对应于map 1的receptive field是蓝色的11x11的区域,所以map 3里1x1的区域对应map 1的receptive field是蓝色的11x11的区域。

那么很容易得出来,receptive field的计算公式如下:

- 对于Convolution/Pooling layer:

其中 ri ri表示第 i i层layer的输入的某个区域, si si表示第 i i层layer的步长, ki ki表示kernel size,注意,不需要考虑padding size。

- 对于Neuron layer(ReLU/Sigmoid/…)

Coordinate Mapping

通常,我们需要知道网络里面任意两个feature map之间的坐标映射关系,如下图,我们想得到map 3上的点 p3 p3映射回map 2所在的位置 p2 p2。

计算公式如下:

- 对于Convolution/Pooling layer:

其中 pi pi表示第 i i层layer的输入的某个点, si si表示第 i i层layer的步长, ki ki表示kernel size, paddingi paddingi

- 对于Neuron layer(ReLU/Sigmoid/…)

上面是计算任意一个layer输入输出的坐标映射关系,如果是计算任意feature map之间的关系,只需要用简单的组合就可以得到,下图是一个简单的例子:

Convolutionalize (卷积化)

最近掀起了FCN(全卷积网络)风,这种网络里面不包括全连接层(fully connected layer)。

卷积层跟全连接层的区别

卷积层的操作跟传统的滑窗(sliding windows)很相似,把kernel作用于输入的不同的区域然后产生对应的特征图,由于这样的性质,给定一个卷积层,它并不要求输入是固定大小的,它可能根据输入大小的不同而产生大小不一样的特征图。

全连接层的操作是把输入拉成一个一维的向量,然后对这一维的向量进行点乘,这就要求输入大小是固定的。

那么如果使用一个包含fc层的模型(如AlexNet)就必须使用固定大小的输入,其实有时候这是非常不方便以及不合理的,比如下图,如果我要把红框的塔输入网络,就必须得对它进行变成,假设是放到AlexNet里面,因为输入是224x224,那么就会对图片产生变形。

那么有没有办法使得网络可以接受任意的输入?实际上是可以的,只需要把全连接层变成卷积层,这就是所谓的卷积化。这里需要证明卷积化的等价性。直观上理解,卷积跟全连接都是一个点乘的操作,区别在于卷积是作用在一个局部的区域,而全连接是对于整个输入而言,那么只要把卷积作用的区域扩大为整个输入,那就变成全连接了,我就不给出形式化定义了。所以我们只需要把卷积核变成跟输入的一个map的大小一样就可以了,这样的话就相当于使得卷积跟全连接层的参数一样多。举个例子,比如AlexNet,fc6的输入是256x6x6,那么这时候只需要把fc6变成是卷积核为6x6的卷积层就好了。

例子:(1) 用全连接的: full-connected.prototxt,(2) 改成全卷积:full-conv.prototxt

1297

1297

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?