版权声明:欢迎转载,原文地址http://blog.csdn.net/aws3217150

如果学习机器学习算法,你会发现,其实机器学习的过程大概就是定义一个模型的目标函数 J(θ) ,然后通过优化算法从数据中求取 J(θ) 取得极值时对应模型参数 θ 的过程,而学习到的参数就对应于机器学习到的知识。不管学习到的是好的还是无用的,我们知道这其中的动力引擎就是优化算法。在很多开源软件包中都有自己实现的一套优化算法包,比如stanford-nlp,希望通过本篇简要介绍之后,对于开源软件包里面的优化方法不至于太陌生。本文主要介绍三种方法,分别是梯度下降,共轭梯度法(Conjugate Gradient Method)和近似牛顿法(Quasi-Newton)。具体在stanford-nlp中都有对应的实现,由于前两种方法都涉及到梯度的概念,我们首先从介绍梯度开始。

梯度(Gradient)

什么是梯度,记忆中好像和高数里面的微积分有关。好,只要您也有这么一点印象就好办了,我们知道微积分的鼻祖是牛顿,人家是经典力学的奠基人,那么我们先来看看一道简单的物理问题:

一个小球在一个平面运动,沿着x轴的位移随时间的变化为: Sx=20−t2 ,沿着y轴的位移随时间的变化为: Sy=10+2t2 ,现在求在 t0 时刻小球的速度 v ?

大家都是为高考奋战过的人,这样的小题应该是送分题吧。牛老师告诉我们,只要通过求各个方向的分速度,然后再合成就可以求解得出。好,现在我们知道各个方向的位移关于时间的变化规律,我们来求各个方向的速度。如何求速度呢,牛老师说位移的变化率就是速度,那么我们来求在 t0 时刻的变化率:

梯度下降法

做机器学习(监督学习)的时候,一般情况是这样的,有 N 条训练数据 (X(i),y(i)) ,我们的模型会根据 X 预测出对应的 y ,也就是:

如何找到最优的

θ

呢?一个想法是这样的:我们随机在超平面上取一个点,对应我们

θ

的初始值,然后每次改变一点

Δθ

,使

J(θ)

也改变

ΔJ(θ)

,只要能保证

ΔJ<0

就一直更新

θ

直到

J(θ)

不再减少为止。具体如下:

如何找到最优的

θ

呢?一个想法是这样的:我们随机在超平面上取一个点,对应我们

θ

的初始值,然后每次改变一点

Δθ

,使

J(θ)

也改变

ΔJ(θ)

,只要能保证

ΔJ<0

就一直更新

θ

直到

J(θ)

不再减少为止。具体如下:

- 随机初始化 θ

- 对于每一个 θi 选择合适的 Δθi ,使得 J(θ+Δθ)−J(θ)<0 ,如果找不到这样的 Δθ ,则结束算法

- 对于每一个 θi 进行更新: θi=θi+Δθi ,回到第2步。

想法挺好的,那么如何找到所谓合适的 Δθ 呢?根据上一节中我们知道:

- 随机初始化 θ

- 求取 θ 的梯度 ∇θ ,也就是对于每个 θi 求取其偏导数 ∂J(θ)∂θi ,并更新 θi=θi−η∗∂J(θ)∂θi(η>0并足够小)

- 判断 ∇θ 是否为0或者足够小,是就输出此时的 θ ,否则返回第2步

上述算法的第二步中多了一个未曾介绍的 η ,这是步伐大小,因为求取每一个维度的偏导,只是求取了该维度上的变化率,具体要变化多大就由 η 控制了, η 的选取更多考验的是你的工程能力,取太大是不可行的,这样导致算法无法收敛,取太小则会导致训练时间太长,有兴趣的可参考An overview of gradient descent optimization algorithms这篇文章中对 η 选取的一些算法。如何计算 ∂J(θ)∂θi 呢?根据定义,可如下计算:

共轭梯度法

上一节中,我们介绍了一般的梯度下降法,这是很多开源软件包里面都会提供的一种算法。现在我们来看看另外一种软件包也经常见到算法——共轭梯度法(Conjugate Gradient Method),Jonathan在94年的时候写过《An Introduction to the Conjugate Gradient Method Without the Agonizing Pain》详细而直观地介绍了CG,确实文如其名。这里我只是简要介绍CG到底是一个什么样的东西,具体还需阅读原文,强烈推荐啊!

最陡下降法(Steepest Descent)

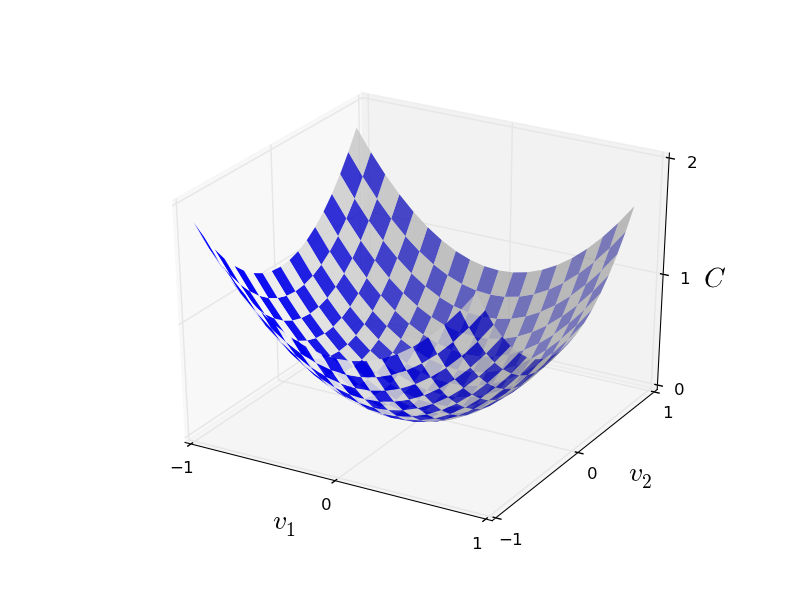

上一节中,我们介绍了如何反复利用 θi=θi−η∗∂J(θ)∂θi 求得最优的 θ ,但是我们说选取 η 是一个艺术活,这里介绍一种 η 的选取方式。首先明确一点,我们希望每次改变 θ ,使得 J(θ) 越来越小。在梯度确定的情况下,其实 ΔJ(θ) 是关于 η 的一个函数:

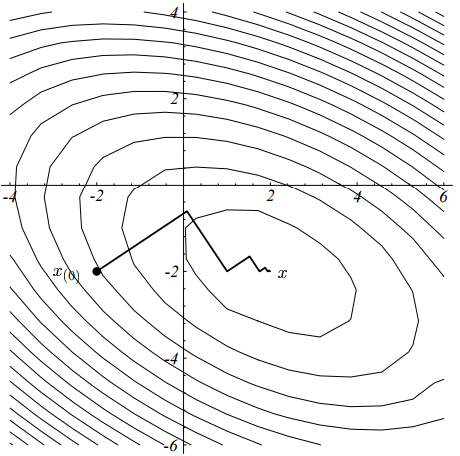

我们可以发现,每一次走的步伐和上一次都是垂直的(事实上是可以证明的,在前面我推荐的文中有详细的证明:-)),这样必然有很多步伐是平行的,造成同一个方向要走好几次。研究最优化的人野心就来了,既然同一个方向要走好几次,能不能有什么办法,使得同一个方向只走一次就可以了呢?

共轭梯度法

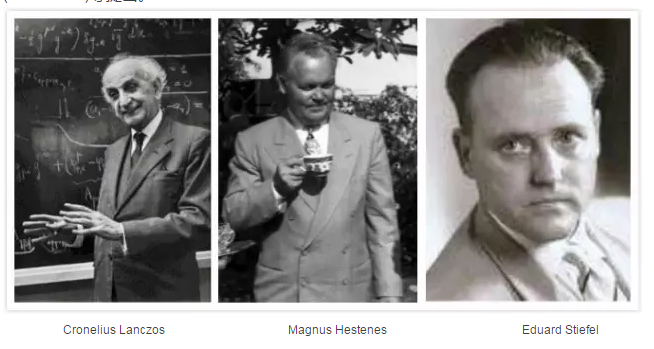

Cornelius,Magnus和Eduard经过研究之后,便设计了这样的方法——共轭梯度法。

具体详细的原理还是强烈推荐《An Introduction to the Conjugate Gradient Method Without the Agonizing Pain》一文,这里我只是利用文章中的思路进行简要介绍。

何谓共轭(Conjugate)

查看维基的介绍,共轭梯度法(CG)最早的提出是为了解决大规模线性方程求解,比如下面形式:

我们已经了解梯度为何物,现在就差修饰词共轭(Conjugate)了,那么何为共轭(conjugate)呢?对于两个非零向量 d(i),d(j) ,如果满足

共轭梯度法求解线性方程组

那么求解上面线性方程组的时候,假如我们已经找到 n 个两两共轭的方向 {d(i)} ,如果将这些方向作为基,也就可以将 Ax=b 的解表示为 d(i) 的线性组合:

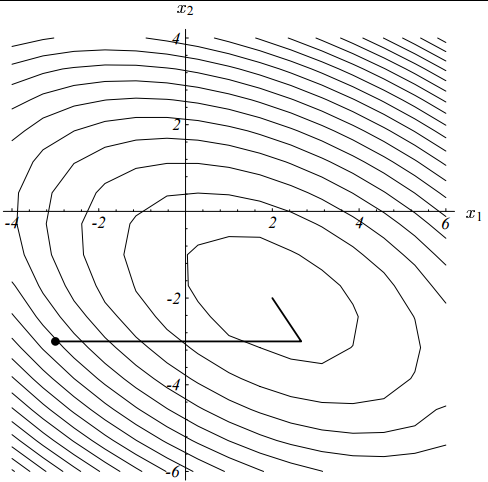

上一小节中利用Steepest Method的优化问题如果利用CG就变成了如下:

二维的情况下,可以保证只走两步就达到收敛(严格的证明请参靠推荐的论文)!

非线性共轭梯度法

机器学习算法中,我们碰到的大部分问题都是非线性的,上面我们只是讲解了线性共轭梯度法,那么它可以解决非线性优化问题吗?很遗憾,不行,但是经过修改,可以利用共轭梯度法求取局部最优解,下面展示非线性共轭梯度法的大致轮廓,对于一个非线性目标函数 J(θ)

- 随机初始化 θ0 ,并令 r0=d(0)=−J′(θ0)

- 对于k = 0,1,2….

- 利用line search找出使得 J(θk+αid(k)) 足够小的 αk

- θk+1=θk+αkd(k)

- rk+1=−J′(θk+1)

- d(k+1)=rk+1+βk+1d(k)

这里又出现了

βi

,对于

β

的研究,著名的方法有:Hestenes-Stiefel方法、Fletcher-Reeves方法、Polak-Ribiére-Polyak 方法和Dai-Yuan方法,分别对应于:

需要注意的是,非线性共轭梯度法并不能像解决线性系统那样,保证 n 步内收敛,一般我们迭代很多次直到 ||rk||<ϵ||r0|| 。

像CG这样高效的方法,一般都有现成的工具库可以使用,只要我们提供目标函数的一次导函数和初始值,CG就能帮我们找到我们想要的了!再次推荐《 An Introduction to the Conjugate Gradient Method Without the Agonizing Pain》一文。

近似牛顿法(Quasi-Newton)

上一节中介绍开源软件包常见的方法Conjugate Gradient Method,这一节我们来介绍另一个常见的方法——Quasi-Newton Method。

牛顿法(Newton Method)

我们高中的时候数学课本上介绍过牛顿求根法,具体的做法是:对于一个连续可导的函数

f(x)

,我们如何求取它的零点呢,看看维基百科是如何展示牛老师的方法:

如图所示,我们首先随机初始化

x0

,然后每一次利用曲线在当前

xi

的切线与横轴的交点作为下一个尝试点

xi+1

,具体更新公式:

- While

J′(θ)

没有足够小:

- θ=θ−J′(θ)J′′(θ)

其中 J′′(θ) 是一个矩阵:

L-BFGS算法

上一小节中,我们介绍了牛顿法,并且指出它一个严重的缺陷,就是计算Hession矩阵和求逆有时候内存和时间都不允许。那么有什么办法可以近似利用牛顿法呢,也就是有没有Quasi-Newton Method呢?答案是有的,BFGS算法就是一个比较著名的近似牛顿法,对于BFGS的介绍,另外有一篇博客有很好的介绍,具体参阅《Numerical Optimization: Understanding L-BFGS》,也是非常直观简洁的介绍,还附有Java和Scala源码,非常值得学习。

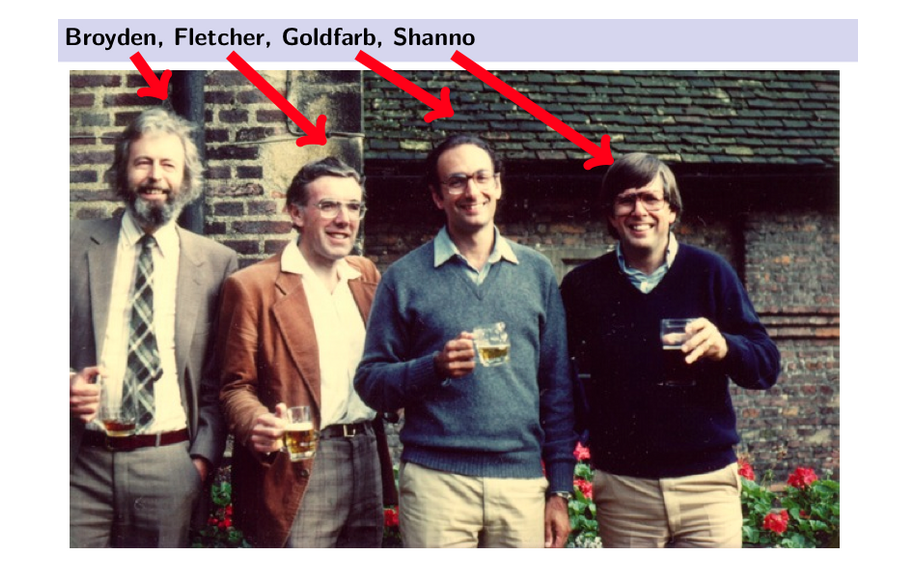

BFGS算法核心在于他利用迭代的方式(具体方式请参考上面推荐的博文,文章不长,可读性很强)近似求解Hession矩阵的逆,使得求解Hession矩阵的逆变得不再是神话。而迭代的过程步骤是无限制的,这也会导致内存不足问题,所以工程上利用有限步骤来近似BFGS求解Hession的逆,就成了Limit-BFGS算法。与很多算法一样,这个算法名字是取4位发明者的名字首字母命名的,所以单看名字是没有意义的:-)。

以上是几位大佬的尊荣。利用Quasi-Newton法,在处理数据规模不大的算法模型,比如Logistic Regression,可以很快收敛,是所有优化算法包不可或缺的利器。

参考引用

-

顶

- 2

-

踩

5万+

5万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?