一:问题

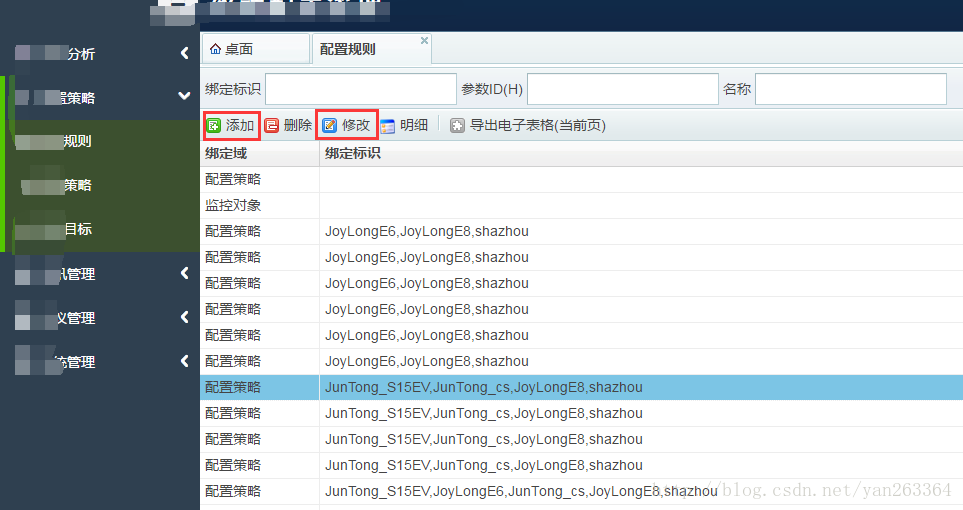

在打开一个页面中,有几个按钮,可以打开一个新的页面,添加新的数据、或者修改数据。先打开添加页面,再打开修改页面。修改页面本该隐藏的内容,出现在input框中。如图:

二、过程

原本以为是页面中的东西被其他页面篡改了。但看了相应的js文件之后,才发现,是id有冲突。

三、解决方法

在id后面添加 navTab.getCurrentPanel() 。如图:

$("#bindingId_show",navTab.getCurrentPanel()).val("");这个问题,在dwz文档中已经给出来了。我是多转了好几圈,才发现T/\T

9756

9756

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?