线性回归

线性回归问题

andrew的Week1和Week2说的也是线性回归。可以比较下二者所讲的。

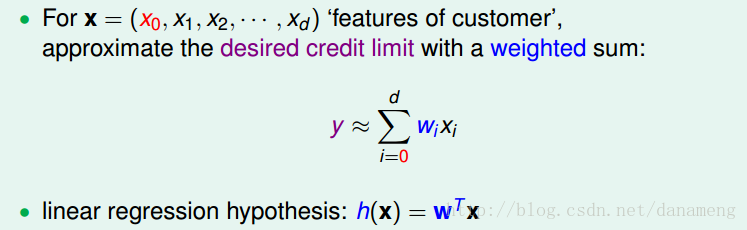

比如银行给顾客信用卡的例子,线性回归做的不是决定“要不要给顾客信用卡”而是“要给顾客多少信用额度”,每个顾客给的不一样。线性回归:

注意,x0是常数项,是阈值。目标是希望加权后的结果和期望接近。没有sign,就是直接算出来的值就是结果,不需要像分类问题一样,取符号。

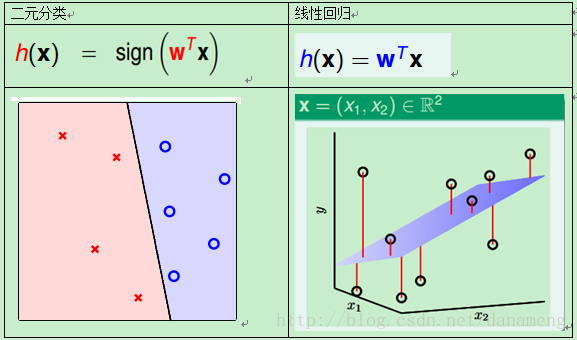

和分类不一样:(有两个特征x1,x2)

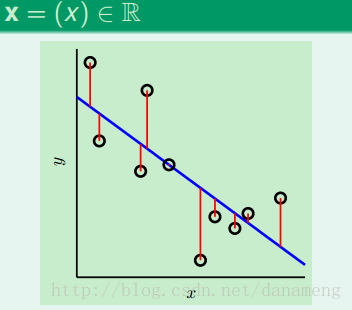

一维的是:

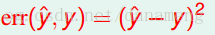

红色的线是误差,即residual余数,预测和实际差多少。希望余数越小越好,用squared error衡量:

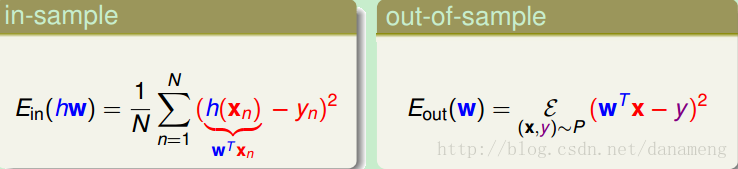

从机器学习角度要看两个,一个是训练数据上的error,另一个是还没看过的资料的error。

注意,有noise,所以(x,y)~P就是x和y都服从某个分布

线性回归算法

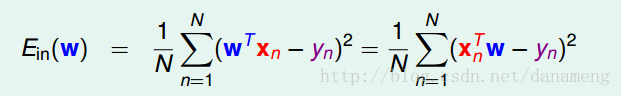

现在的问题就是,怎么minimize Ein(w)。这和Andrew讲的一样,就是要minJ(θ)。

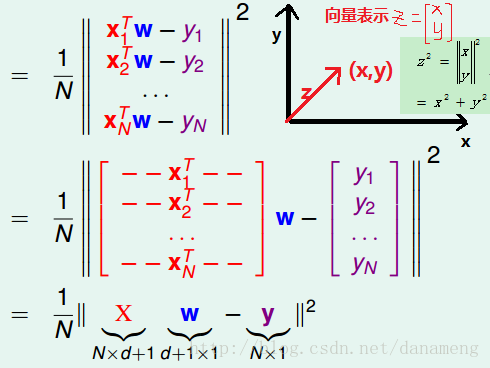

再把连加的展开,有点象

最后简化式子,X表示的是输入的资料,W表示变化的线,y是想要的输出。

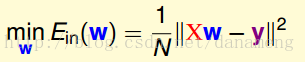

目标是

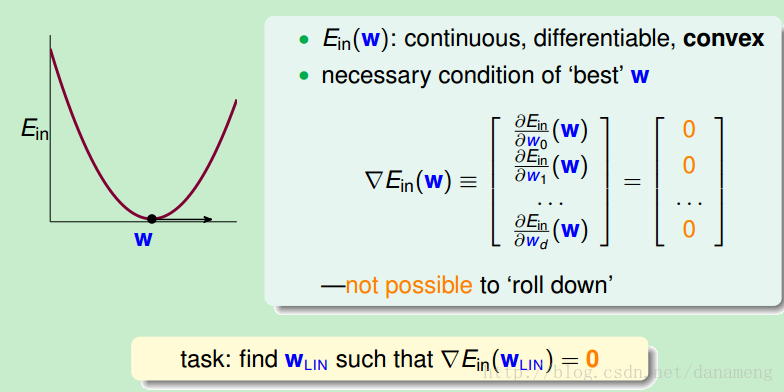

这是一个连续、可导的凸函数,碗状。可以在andrew的Week1中看多维空间的成本函数Ein样子。

因为Ein(W)是碗状的,所以在碗底WLin一定就是Ein最小的地方。梯度是Ein(W)的d个偏导数为分量的向量。梯度方向是函数具有最大变化率的方向。沿正梯度方向,函数是上升的;沿负梯度方向,函数是下降的。

以下是几个常用的梯度公式:

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1679

1679

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?