要想深入的学习hadoop数据分析技术,首要的任务是必须要将hadoop集群环境搭建起来,可以将hadoop简化地想象成一个小软件,通过在各个物理节点上安装这个小软件,然后将其运行起来,就是一个hadoop分布式集群了。

说来简单,但是应该怎么做呢?不急,本文的主要目的就是让新手看了之后也能够亲自动手实施这些过程。由于本人资金不充裕,只能通过虚拟机来实施模拟集群环境,虽然说是虚机模拟,但是在虚机上的hadoop的集群搭建过程也可以使用在实际的物理节点中,思想是一样的。

也许有人想知道安装hadoop集群需要什么样的电脑配置,这里只针对虚拟机环境,下面介绍下环境:

CPU:Intel酷睿双核 2.2Ghz

内存: 4G

硬盘: 320G

系统:xp

说完电脑的硬件配置,下面说说本人安装hadoop的准备条件:

1 安装Vmware WorkStation软件

有些人会问,为何要安装这个软件,这是一个VM公司提供的虚拟机工作平台,后面需要在这个平台上安装linux操作系统。具体安装过程网上有很多资料,这里不作过多的说明。

2 在虚拟机上安装linux操作系统

在前一步的基础之上安装linux操作系统,因为hadoop一般是运行在linux平台之上的,虽然现在也有windows版本,但是在linux上实施比较稳定,也不易出错,如果在windows安装hadoop集群,估计在安装过程中面对的各种问题会让人更加崩溃,其实我还没在windows上安装过,呵呵~

在虚拟机上安装的linux操作系统为ubuntu10.04,这是我安装的系统版本,为什么我会使用这个版本呢,很简单,因为我用的熟^_^其实用哪个linux系统都是可以的,比如,你可以用centos, redhat, fedora等均可,完全没有问题。在虚拟机上安装linux的过程也在此略过,如果不了解可以在网上搜搜,有许多这方面的资料。

3 准备3个虚拟机节点

其实这一步骤非常简单,如果你已经完成了第2步,此时你已经准备好了第一个虚拟节点,那第二个和第三个虚拟机节点如何准备?可能你已经想明白了,你可以按第2步的方法,再分别安装两遍linux系统,就分别实现了第二、三个虚拟机节点。不过这个过程估计会让你很崩溃,其实还有一个更简单的方法,就是复制和粘贴,没错,就是在你刚安装好的第一个虚拟机节点,将整个系统目录进行复制,形成第二和第三个虚拟机节点。简单吧!~~

很多人也许会问,这三个结点有什么用,原理很简单,按照hadoop集群的基本要求,其中一个是master结点,主要是用于运行hadoop程序中的namenode、secondorynamenode和jobtracker任务。用外两个结点均为slave结点,其中一个是用于冗余目的,如果没有冗余,就不能称之为hadoop了,所以模拟hadoop集群至少要有3个结点,如果电脑配置非常高,可以考虑增加一些其它的结点。slave结点主要将运行hadoop程序中的datanode和tasktracker任务。

所以,在准备好这3个结点之后,需要分别将linux系统的主机名重命名(因为前面是复制和粘帖操作产生另两上结点,此时这3个结点的主机名是一样的),重命名主机名的方法:

Vim /etc/hostname

通过修改hostname文件即可,这三个点结均要修改,以示区分。

以下是我对三个结点的ubuntu系统主机分别命名为:master, node1, node2

基本条件准备好了,后面要干实事了,心急了吧,呵呵,别着急,只要跟着本人的思路,一步一个脚印地,一定能成功布署安装好hadoop集群的。

这里面还有问题网络配置:

虚拟机下载地址:

VMware Workstation 10.0.0简体中文正式版官方下载地址

如果是零基础可以参考:

集群搭建必备,云技术基础:Linux及虚拟化知识学习指导(hadoop、openstack)

安装过程主要有以下几个步骤:

一、 配置hosts文件

二、 建立hadoop运行帐号

三、 配置ssh免密码连入

四、 下载并解压hadoop安装包

五、 配置namenode,修改site文件

六、 配置hadoop-env.sh文件

七、 配置masters和slaves文件

八、 向各节点复制hadoop

九、 格式化namenode

十、 启动hadoop

十一、 用jps检验各后台进程是否成功启动

十二、 通过网站查看集群情况

下面我们对以上过程,各个击破吧!~~

一、 配置hosts文件

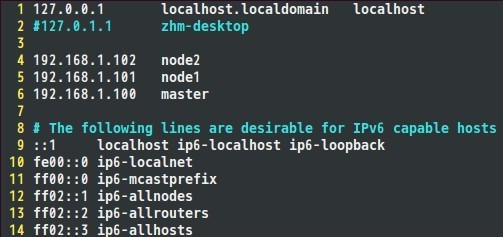

先简单说明下配置hosts文件的作用,它主要用于确定每个结点的IP地址,方便后续

master结点能快速查到并访问各个结点。在上述3个虚机结点上均需要配置此文件。由于需要确定每个结点的IP地址,所以在配置hosts文件之前需要先查看当前虚机结点的IP地址是多少,可以通过ifconfig命令进行查看,如本实验中,master结点的IP地址为:

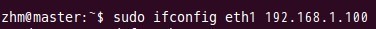

如果IP地址不对,可以通过ifconfig命令更改结点的物理IP地址,示例如下:

通过上面命令可以将IP改为192.168.1.100。将每个结点的IP地址设置完成后,就可以配置hosts文件了,hosts文件路径为;/etc/hosts,我的hosts文件配置如下,大家可以参考自己的IP地址以及相应的主机名完成配置

二、 建立hadoop运行帐号

即为hadoop集群专门设置一个用户组及用户,这部分比较简单,参考示例如下:

sudo groupadd hadoop //设置hadoop用户组

sudo useradd –s /bin/bash –d /home/zhm –m zhm –g hadoop –G admin //添加一个zhm用户,此用户属于hadoop用户组,且具有admin权限。

sudo passwd zhm //设置用户zhm登录密码

su zhm //切换到zhm用户中

上述3个虚机结点均需要进行以上步骤来完成hadoop运行帐号的建立。

三、 配置ssh免密码连入

这一环节最为重要,而且也最为关键,因为本人在这一步骤裁了不少跟头,走了不少弯

路,如果这一步走成功了,后面环节进行的也会比较顺利。

SSH主要通过RSA算法来产生公钥与私钥,在数据传输过程中对数据进行加密来保障数

据的安全性和可靠性,公钥部分是公共部分,网络上任一结点均可以访问,私钥主要用于对数据进行加密,以防他人盗取数据。总而言之,这是一种非对称算法,想要破解还是非常有难度的。Hadoop集群的各个结点之间需要进行数据的访问,被访问的结点对于访问用户结点的可靠性必须进行验证,hadoop采用的是ssh的方法通过密钥验证及数据加解密的方式进行远程安全登录操作,当然,如果hadoop对每个结点的访问均需要进行验证,其效率将会大大降低,所以才需要配置SSH免密码的方法直接远程连入被访问结点,这样将大大提高访问效率。

OK,废话就不说了,下面看看如何配置SSH免密码登录吧!~~

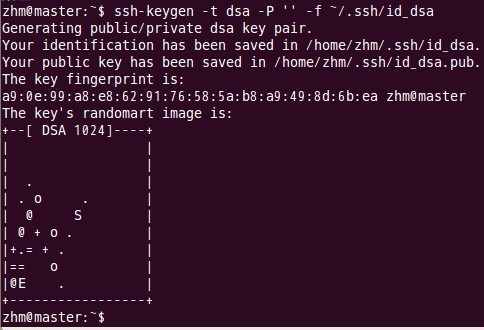

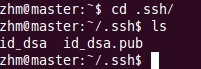

(1) 每个结点分别产生公私密钥。

键入命令:1)ssh-keygen -t rsa -P '' -f ~/.ssh/id_rsa (图片中输入有误。) 用RSA算法,在每台机子上跑一遍,产生公钥与私钥。

2)scp zhm@master:~/.ssh/id_rsa.pub ./master_rsa.pub 把主机master的公钥复制到node1,node2上。

3)cat master_rsa.pub >> authorized_keys 在node1,node2下,把 master_rsa.pub变成authorized_keys 。

4)chmod 600 authorized_keys 改变这个文件的权限 ,这是系统规定的。

5)在master 上可以在第二次后,免密登陆了。至此免密码登陆完成。

6)master 要SSH登陆自己,则要把自己的master_rsa.pub,复制成authorized_keys。并更改其权限为600就可以了。

ZOUYU 2018-1-21 23:21

以上命令是产生公私密钥,产生目录在用户主目录下的.ssh目录中,如下:

Id_dsa.pub为公钥,id_dsa为私钥,紧接着将公钥文件复制成authorized_keys文件,这个步骤是必须的,过程如下:

用上述同样的方法在剩下的两个结点中如法炮制即可。

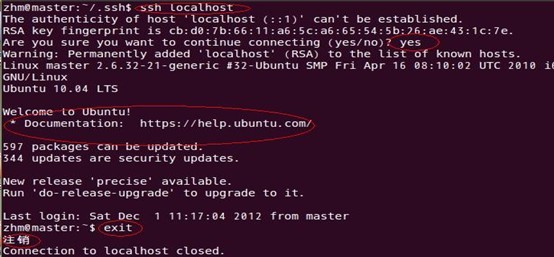

(2) 单机回环ssh免密码登录测试

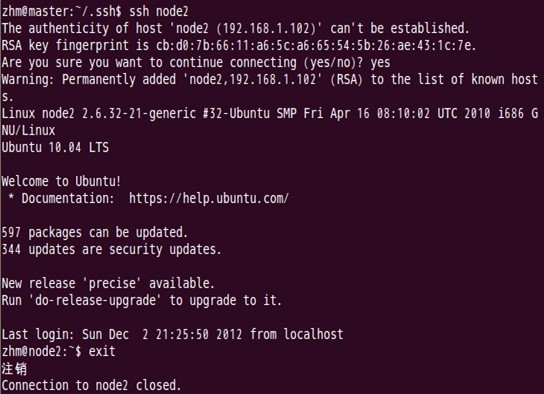

即在单机结点上用ssh进行登录,看能否登录成功。登录成功后注销退出,过程如下:

注意标红圈的指示,有以上信息表示操作成功,单点回环SSH登录及注销成功,这将为后续跨子结点SSH远程免密码登录作好准备。

用上述同样的方法在剩下的两个结点中如法炮制即可。

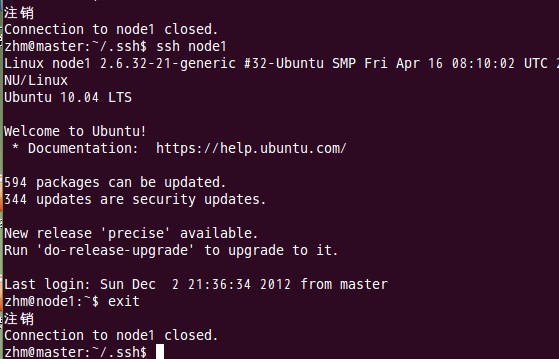

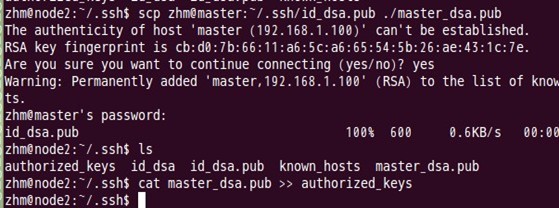

(3) 让主结点(master)能通过SSH免密码登录两个子结点(slave)

为了实现这个功能,两个slave结点的公钥文件中必须要包含主结点的公钥信息,这样

当master就可以顺利安全地访问这两个slave结点了。操作过程如下:

如上过程显示了node1结点通过scp命令远程登录master结点,并复制master的公钥文件到当前的目录下,这一过程需要密码验证。接着,将master结点的公钥文件追加至authorized_keys文件中,通过这步操作,如果不出问题,master结点就可以通过ssh远程免密码连接node1结点了。在master结点中操作如下:

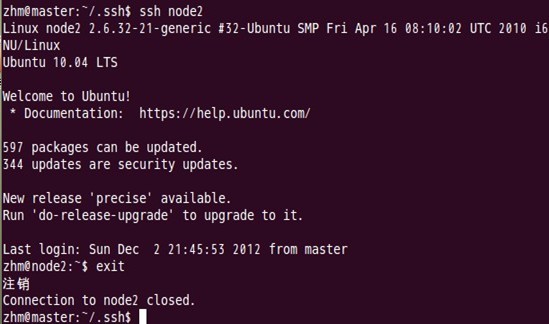

由上图可以看出,node1结点首次连接时需要,“YES”确认连接,这意味着master结点连接node1结点时需要人工询问,无法自动连接,输入yes后成功接入,紧接着注销退出至master结点。要实现ssh免密码连接至其它结点,还差一步,只需要再执行一遍ssh node1,如果没有要求你输入”yes”,就算成功了,过程如下:

如上图所示,master已经可以通过ssh免密码登录至node1结点了。

对node2结点也可以用同样的方法进行,如下图:

Node2结点复制master结点中的公钥文件

Master通过ssh免密码登录至node2结点测试:

第一次登录时:

第二次登录时:

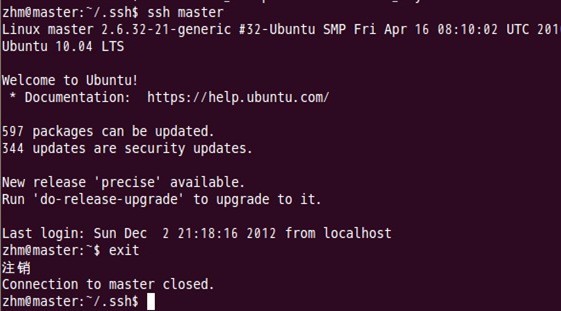

表面上看,这两个结点的ssh免密码登录已经配置成功,但是我们还需要对主结点master也要进行上面的同样工作,这一步有点让人困惑,但是这是有原因的,具体原因现在也说不太好,据说是真实物理结点时需要做这项工作,因为jobtracker有可能会分布在其它结点上,jobtracker有不存在master结点上的可能性。

对master自身进行ssh免密码登录测试工作:

至此,SSH免密码登录已经配置成功。

四、下载并解压hadoop安装包

关于安装包的下载就不多说了,不过可以提一下目前我使用的版本为hadoop-0.20.2,

这个版本不是最新的,不过学习嘛,先入门,后面等熟练了再用其它版本也不急。而且《hadoop权威指南》这本书也是针对这个版本介绍的。

注:解压后hadoop软件目录在/home/zhm/hadoop下

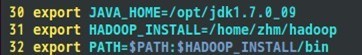

五、配置namenode,修改site文件

在配置site文件之前需要作一些准备工作,下载java最新版的JDK软件,可以从oracle官网上下载,我使用的jdk软件版本为:jdk1.7.0_09,我将java的JDK解压安装在/opt/jdk1.7.0_09目录中,接着配置JAVA_HOME宏变量及hadoop路径,这是为了方便后面操作,这部分配置过程主要通过修改/etc/profile文件来完成,在profile文件中添加如下几行代码:

然后执行:

让配置文件立刻生效。上面配置过程每个结点都要进行一遍。

到目前为止,准备工作已经完成,下面开始修改hadoop的配置文件了,即各种site文件,文件存放在/hadoop/conf下,主要配置core-site.xml、hdfs-site.xml、mapred-site.xml这三个文件。

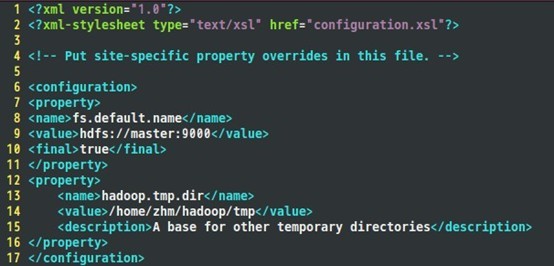

Core-site.xml配置如下:

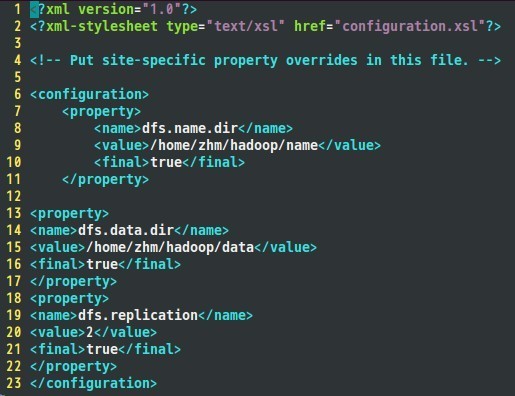

Hdfs-site.xml配置如下:

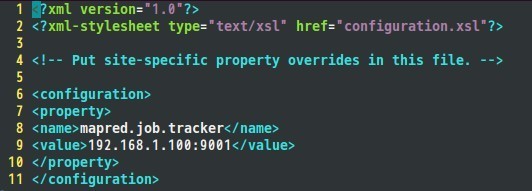

接着是mapred-site.xml文件:

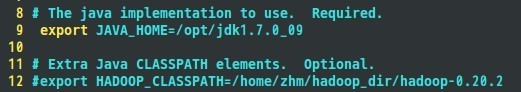

六、配置hadoop-env.sh文件

这个需要根据实际情况来配置。

七、配置masters和slaves文件

根据实际情况配置masters的主机名,在本实验中,masters主结点的主机名为master,

于是在masters文件中填入:

同理,在slaves文件中填入:

八、向各节点复制hadoop

向node1节点复制hadoop:

向node2节点复制hadoop:

这样,结点node1和结点node2也安装了配置好的hadoop软件了。

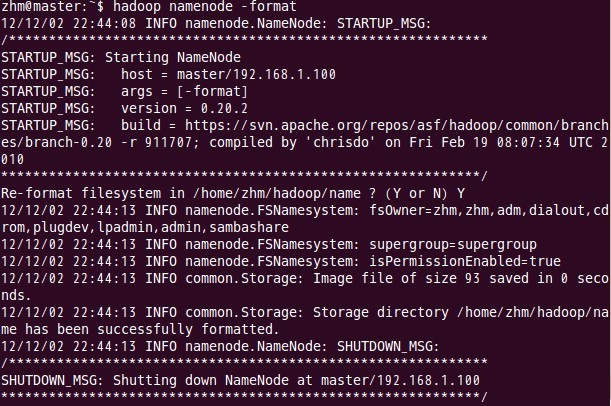

九、格式化namenode

这一步在主结点master上进行操作:

注意:上面只要出现“successfully formatted”就表示成功了。

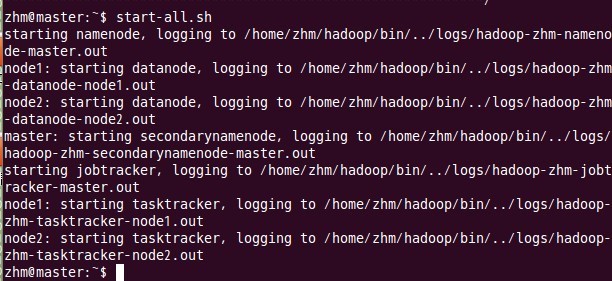

十、启动hadoop

这一步也在主结点master上进行操作:

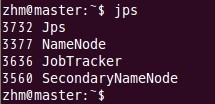

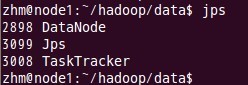

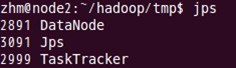

十一、 用jps检验各后台进程是否成功启动

在主结点master上查看namenode,jobtracker,secondarynamenode进程是否启动。

如果出现以上进程则表示正确。

在node1和node2结点了查看tasktracker和datanode进程是否启动。

先来node1的情况:

下面是node2的情况:

进程都启动成功了。恭喜~~~

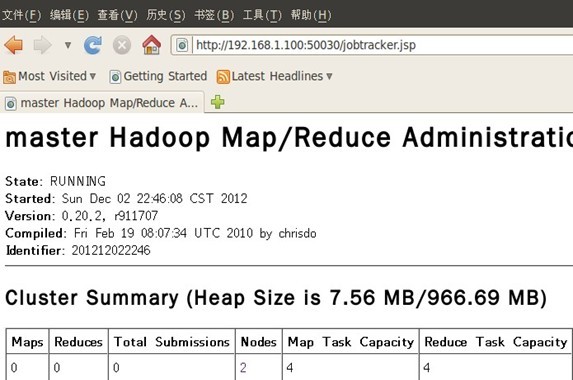

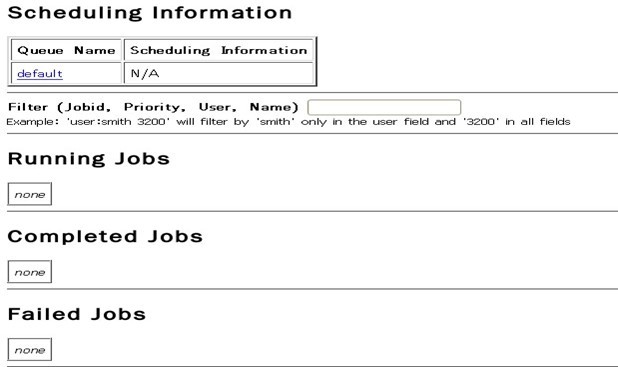

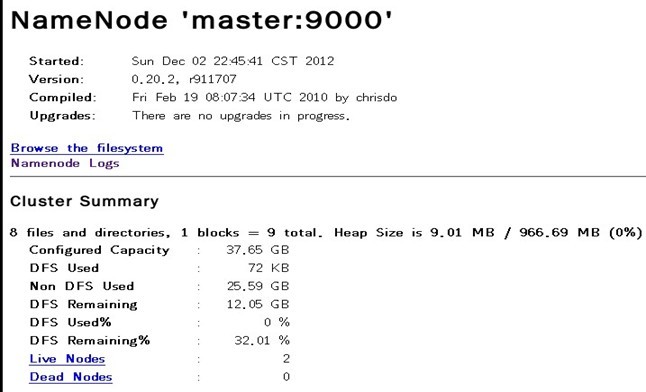

十二、 通过网站查看集群情况

在浏览器中输入:http://192.168.1.100:50030,网址为master结点所对应的IP:

在浏览器中输入:http://192.168.1.100:50070,网址为master结点所对应的IP:

至此,hadoop的完全分布式集群安装已经全部完成,

1115

1115

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?