本文部分参考了http://www.cnblogs.com/90zeng/p/adaboost.html一文,学习Adaboost算法的关键在于理解单层决策树以及背后的数学原理,鉴于网上诸多不完整甚至错误的推导,力求做到正确、全面、简明易懂。

(5) 最后我想补充一点

adaboost算法的python源码几乎一样,而且关于数学推到部分有70%(大约)是不知道数学原理直接在代码中找公式贴,下面重点说明一个错误。

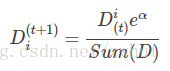

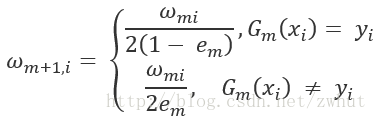

关于更新训练数据集的权值分布D时,经典代码段如下:

expon = np.multiply(-1 * alpha * np.mat(classLabels).T, classEst)

D = np.multiply(D, np.exp(expon))

D = D / D.sum() # 更新D这里参考的是

首先np.exp(expon)相当于exp以及括号那一部分,和D相乘的结果并不是最新的D,还要除以Zm,仔细看Zm的公式发现确实可以用(multiply(D, np.exp(expon))).sum()来描述,但是老铁们你发现这一段代码有多少个D,每个D能一样吗?于是有人望文生意,在原理推导时指出。

怎么说呢,你也不能说他错,他写的Sum(D),又没有说是Di|t,但是首先你D到底是啥,然后在描述原理时D都是一样的,实在不严谨。

所以作者在推理时将其简化为

比较方便编程,原理还不会出现歧义

3379

3379

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?