什么是爬虫?

简单地说,爬虫就是请求网站并提取数据的一种自动化程序。

爬虫的基本流程:

1、向服务器发起请求

通过HTTP库向目标站点发起请求,即发送一个Request,请求可以包含额外的headers等信息,等待服务器的响应。

2、获取响应内容

如果服务器正常响应,会得到一个Response,Response的内容便是所要获取的页面内容,类型可能有HTML、JSON、二进制文件(如图片、视频等类型)。

3、解析内容

得到的内容可能是HTML,可以用正则表达式、网页解析库进行解析。可能是JSON,可以直接转成JOSN对象进行解析,可能是二进制数据,可以保存或者进一步处理。

4、保存内容

保存形式多样,可以保存成文本,也可以保存至数据库,或者保存成特定格式的文件。

小白疑问:

什么是Response和Request ?

Request中包含哪些内容?

1、请求方式

主要是GET、POST两种类型,另外还有HEAD、PUT、DELETE、OPTIONS等。

2、请求URL

URL全称是统一资源定位符,如一个网页文档、一张图片、一个视频等都可以用URL来唯一来确定。

3、请求头

包含请求时的头部信息,如User-Agent、Host、Cookies等信息。

4、请求体

请求时额外携带的数据,如表单提交时的表单数据。

Response中包含哪些内容?

1、响应状态

有多种响应状态,如200代表成功,301代表跳转,404代表找不到页面,502代表服务器错误等。

2、响应头

如内容类型、内容长度、服务器信息、设置cookies等等。

3、响应体

最主要的部分,包含了请求资源的内容,如网页HTML、图片二进制数据等。

下面给大家举个小例子:

from fake_useragent import UserAgent

import requests

ua=UserAgent()

#请求的网址

url=“http://www.baidu.com”

#请求头

headers={“User-Agent”:ua.random}

#请求网址

response=requests.get(url=url,headers=headers)

#响应体内容

print(response.text)

#响应状态信息

print(response.status_code)

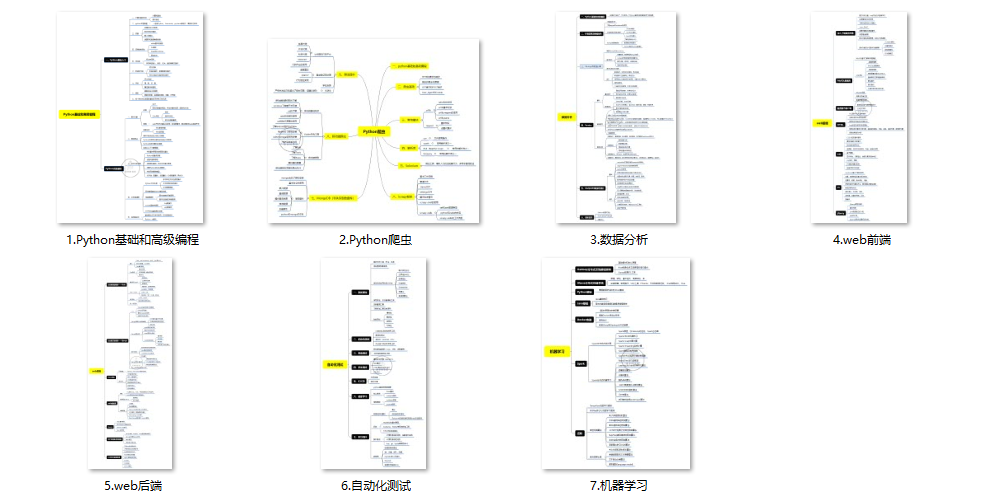

(1)Python所有方向的学习路线(新版)

这是我花了几天的时间去把Python所有方向的技术点做的整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

最近我才对这些路线做了一下新的更新,知识体系更全面了。

(2)Python学习视频

包含了Python入门、爬虫、数据分析和web开发的学习视频,总共100多个,虽然没有那么全面,但是对于入门来说是没问题的,学完这些之后,你可以按照我上面的学习路线去网上找其他的知识资源进行进阶。

(3)100多个练手项目

我们在看视频学习的时候,不能光动眼动脑不动手,比较科学的学习方法是在理解之后运用它们,这时候练手项目就很适合了,只是里面的项目比较多,水平也是参差不齐,大家可以挑自己能做的项目去练练。

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

本文介绍了爬虫的概念,详细阐述了爬虫的四个基本步骤,包括发送Request、获取Response、解析内容和保存数据。同时,解释了Request和Response的构成以及Python在爬虫中的应用,提供了学习Python爬虫的资源路径和建议。

本文介绍了爬虫的概念,详细阐述了爬虫的四个基本步骤,包括发送Request、获取Response、解析内容和保存数据。同时,解释了Request和Response的构成以及Python在爬虫中的应用,提供了学习Python爬虫的资源路径和建议。

54万+

54万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?