InternVL入门学习资料 - 开源多模态大模型系列

InternVL是由OpenGVLab团队开发的一系列开源多模态大模型,涵盖了视觉基础模型、视觉-语言基础模型和多模态大语言模型。本文汇总了InternVL相关的学习资源,帮助读者快速了解和使用这一开源项目。

项目概述

InternVL项目的主要特点包括:

- 提供了从1B到108B参数的多种规模模型

- 支持多模态输入,包括文本、图像、视频和医疗数据

- 支持多任务输出,如图像、边界框和分割掩码等

- 在多个多模态基准测试中达到了与商业闭源模型相当的性能

模型系列

InternVL包括以下几个系列的模型:

-

InternVL 2.0系列:最新的多模态大语言模型,包括1B到108B参数的多个版本。

-

InternVL 1.0-1.5系列:早期版本的多模态对话模型。

-

InternViT系列:视觉基础模型,包括300M到6B参数的版本。

-

InternVL 1.0系列:视觉-语言基础模型。

快速开始

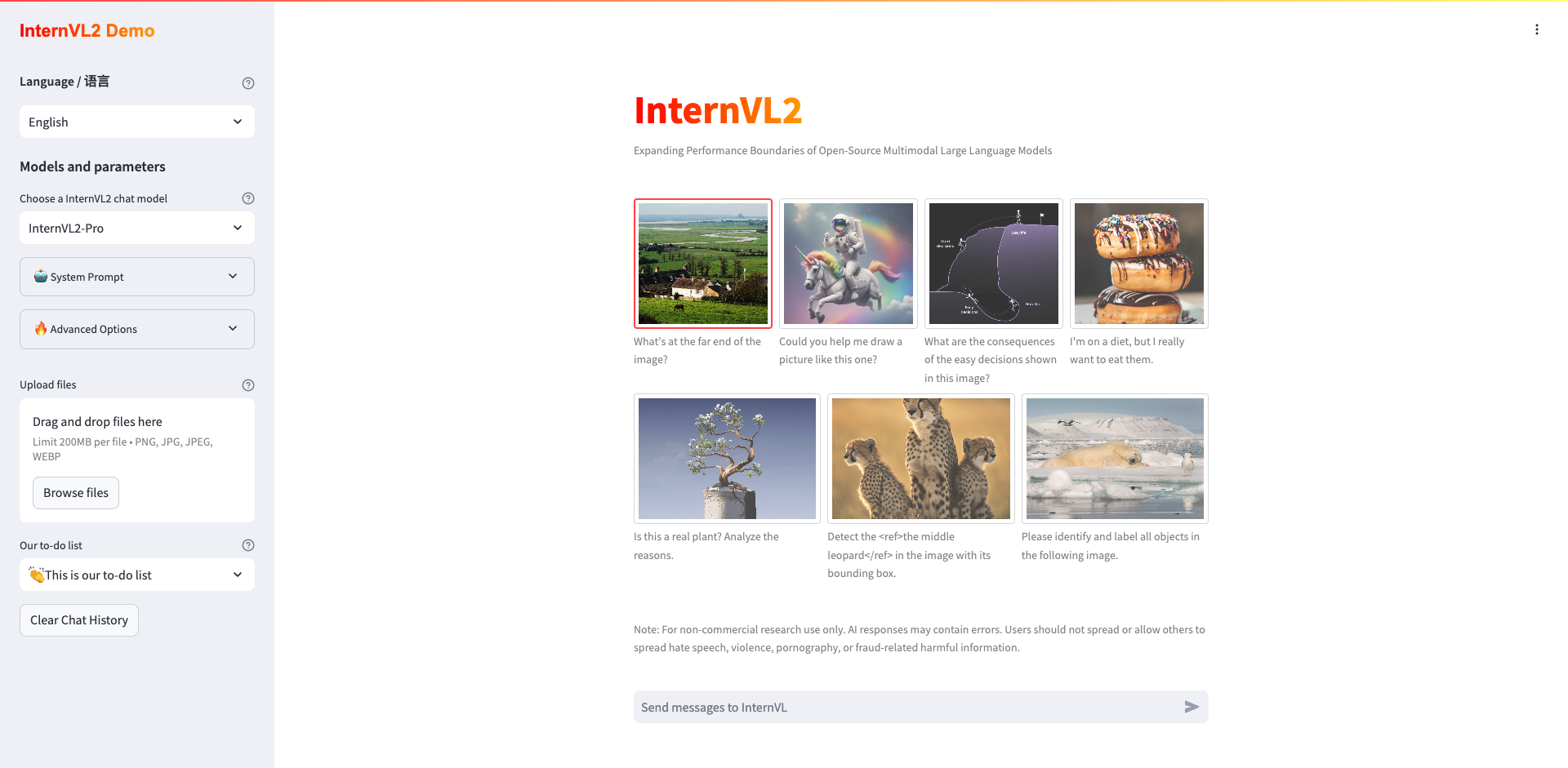

要快速体验InternVL模型,可以通过以下方式:

-

在线Demo:

-

使用Hugging Face Transformers:

from transformers import AutoTokenizer, AutoModel model = AutoModel.from_pretrained("OpenGVLab/InternVL-Chat-V1-5", trust_remote_code=True) tokenizer = AutoTokenizer.from_pretrained("OpenGVLab/InternVL-Chat-V1-5", trust_remote_code=True) -

本地部署:

学习资源

-

官方文档:

-

论文:

-

博客:

-

GitHub仓库:

-

模型下载:

-

中文解读:

性能与应用

InternVL在多个多模态任务上展现了卓越的性能,包括:

- 视觉感知:图像分类、语义分割等

- 跨模态检索:图像-文本检索

- 多模态问答:如MMMU、DocVQA、ChartQA等基准测试

- 多语言零样本分类

具体的性能数据可以在官方GitHub README中查看。

结语

InternVL作为一个强大的开源多模态大模型系列,为研究人员和开发者提供了丰富的资源。通过本文提供的学习资料,读者可以深入了解InternVL的架构、性能和应用,并开始使用这些模型进行自己的研究和开发工作。

文章链接:www.dongaigc.com/a/internvl-beginner-resources-open-source-multimodal

https://www.dongaigc.com/a/internvl-beginner-resources-open-source-multimodal

www.dongaigc.com/p/OpenGVLab/InternVL

https://www.dongaigc.com/p/OpenGVLab/InternVL

453

453

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?