作者 | 调皮哥 编辑 | 调皮连续波

点击下方卡片,关注“自动驾驶之心”公众号

ADAS巨卷干货,即可获取

点击进入→自动驾驶之心【多传感器融合】技术交流群

本文只做学术分享,如有侵权,联系删文

本期分享的文章来自:https://github.com/yuzhe-yang/radar-perception,原作者是Yuzhe-Yang。

一、传统汽车毫米波雷达现状

传统毫米波雷达作为高级自动驾驶汽车系统中的辅助传感器,准确性较低,存在如误报、虚假目标、多径等影响因素。同时,缺乏高度测量能力,在某些场景中非常危险。而且雷达点云非常稀疏,没有语义信息,对周围环境的感知能力很差。

传统雷达主要用于公路等简单场景实现动态目标检测(DOD),但是不能够用于城市等复杂场景。由于测量的精度低,在传感器融合系统中的置信度较低。

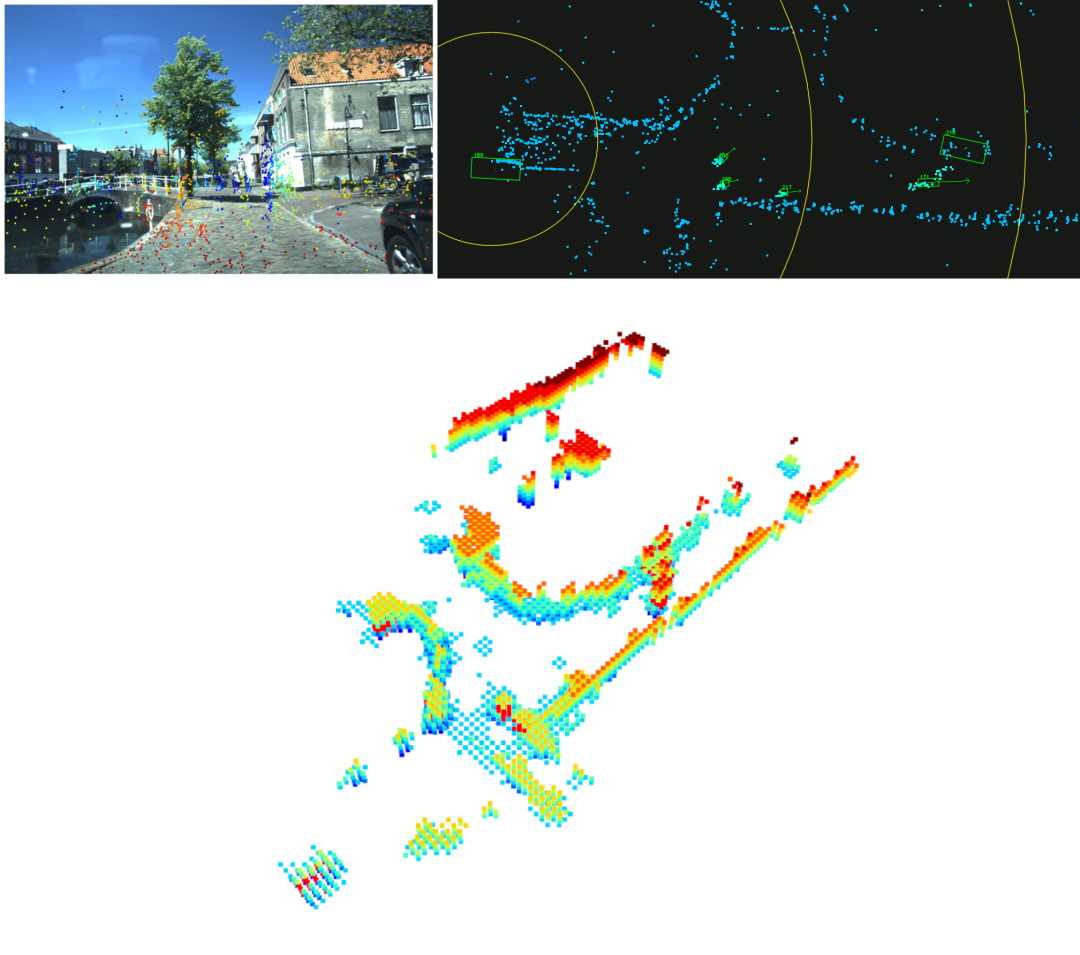

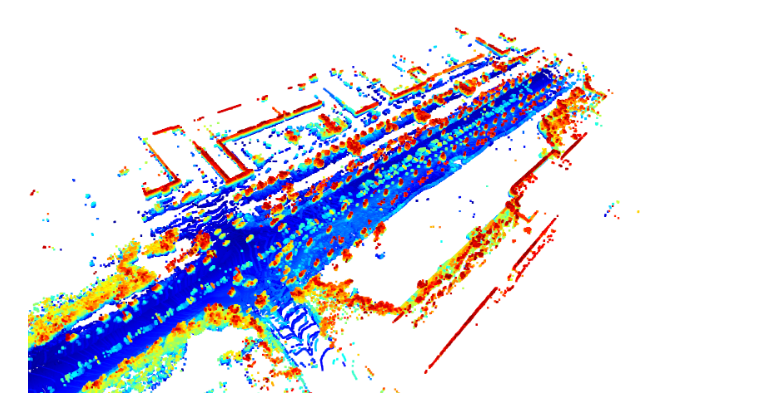

通过使用基于机器学习(MI)的AI算法,传统雷达的精度得到了很大的改善,下图是一些车载雷达在实际中的演示性能:

通过模型设计和数据增强,传统雷达(2000pts/s)可以高精度地探测物体,同时在静止和动态场景中保持良好的性能。

但是还存在一些问题,例如在隧道、城市等场景中的性能不佳,这限制了传统雷达在高级自动驾驶系统中的大规模使用。特斯拉因此曾经放弃了传统雷达,不过,商业布局随着技术的变化而变化,目前4D雷达又重新回归了特斯拉的新一代自动驾驶汽车系统,下一代4D雷达即将到来。

二、下一代4D成像雷达的性能

下一代4D成像雷达的性能如下(本文中的4D雷达指4D成像雷达):

(1) 点云书增加了100倍(80000点/秒);

(2)更加精确的角度分辨率;

(3)具备高度测量能力。

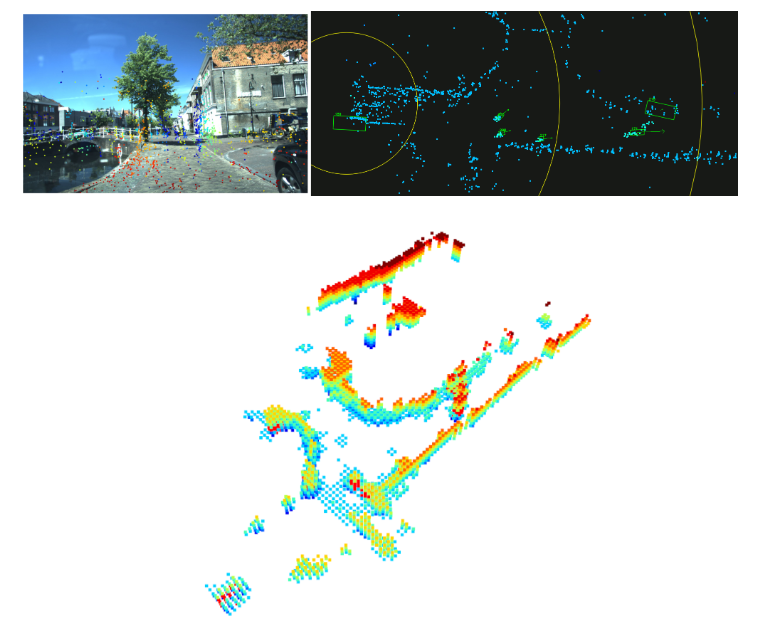

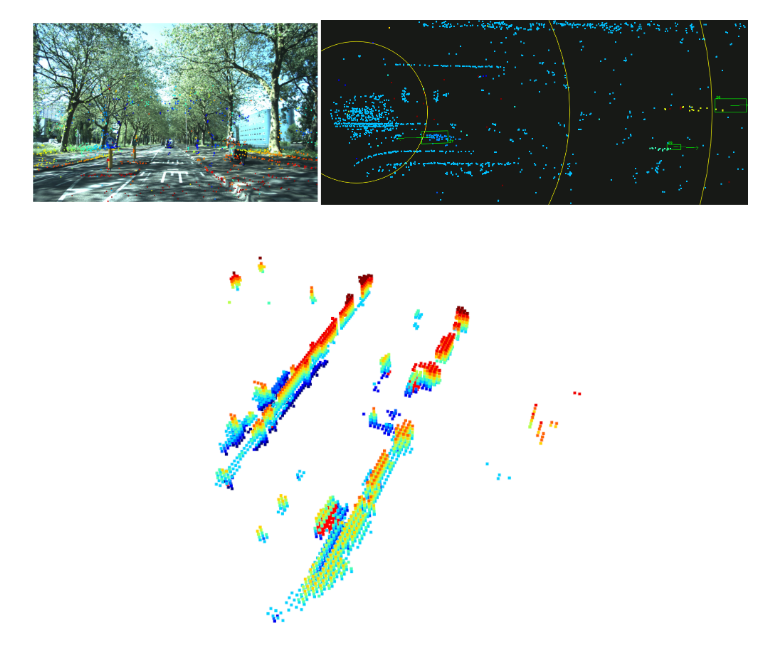

可以采用新一代的4D成像雷达获取包含各种信息的高质量3D点云、获得带速度类别或方向的定向矩形框,以及实现环境构造,如可行使区域检测、BEV鸟瞰图占用检测、3D占用检测。如下所示:

对VOD数据集(4D成像毫米波雷达点云数据集VOD(含Python和MATLAB数据解析仿真代码))进行实验,结果表明,4D雷达在城市场景中具有良好的性能,意味着4D雷达可以用于高级自动驾驶系统。

但仅仅提供这些信息还是不够,缺陷如下所示:

点云和点云间距

(1)点云稀疏、缺乏空间拓扑信息;

(2)点云只能修改而不能创建,这意味着在丢失目标时无法工作;

(3)只能看到带有人工注释标签的特定类别;

(4)需要第二阶段来生成目标或者Bbox。

2.Bbox

(1)难以训练边框回归3D Bbox;

(2)容易在拐角处丢失目标;

(3)Bbox并非物体的真实形状,在某些场景中存在风险;

(4)只有小部分点云被当作前景点。训练数据比较少,数据利用率低、严重浪费雷达感知能力。

(5)依赖于人工标注,成本高昂。

因此,还需要更加充分地利用4D雷达的信息来提取更加丰富的周围环境信息。具体可以改进的方向如下:

第一是使用真实形状和运动信息检测所有现实世界的物体。补充Bbox检测并提高稳健性、增加感知常见的障碍物、如树干、墙等目标的数据。

第二是利用语义信息重建三维周边环境。比如BEV占用、可行行驶区域检测,以及带有运动信息的3D占用。

三、占用网络(The occupancy network)

占用网络基本思想是将点云数据转化为一个体素网格,并在每个体素上学习一个二值分类器,用于判断该体素是否属于某个物体。具体地,网络首先将输入点云映射到一个球形表面上,并利用一个编码器将球面图像转换为一个隐式函数,该隐式函数可以预测空间中任意点的占据状态。然后,网络在三维空间中将该隐式函数采样为一个体素网格,并对每个体素进行二分类,从而得到每个体素的占据状态,进而重建出场景中各个物体的三维形状。

Occupancy Networks具有很强的泛化能力,可以在仅有少量标注数据的情况下,实现高质量的物体检测和重建。此外,该模型还可以在物体检测的同时输出物体的朝向和位置,有助于实现更加精细的场景理解和场景重建。

关于占用网络的详细信息这里就不展开了,可视化效果如下视频所示,读者可以自行在网上检索相关文献和资料了解。

选择占用网络的优点:

(1)具有更加自然、统一的空间表达方式;

(2)可以获得物体的形状以及周围环境的综合信息;

(3)使得多传感器融合、地图、规划、控制的交互更加高效;

(4)使得多任务学习交互更加高效;

(5)能够兼容自动驾驶端到端的未来算法。

那么,其他传感器如相机和激光雷达如何配合占用网络使用呢?

1. 相机

特斯拉发布的基于纯视觉输入的占用网络,需要大量的相机数据,并且在恶劣天气下无法正常工作,需要依靠庞大的数据驱动系统来生成训练数据并训练网络,还需要强大的实时分布式计算平台来运行网络。另外,Transformer网络不容易在平台上训练和移植,所有这些从平台外到平台上都需要花费大量的成本。

2. 激光雷达

激光雷达可以通过简单的体素化自然产生占用图,但激光雷达在恶劣天气和远距离检测中会失效,而且检测运动目标需要增加额外的成本呢,精度不够高。远距离检测高精度激光雷达的成本太高了,无法支撑量产。

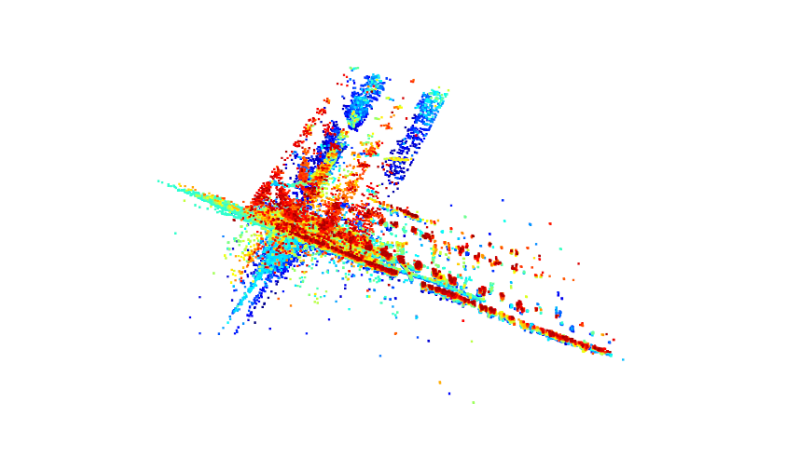

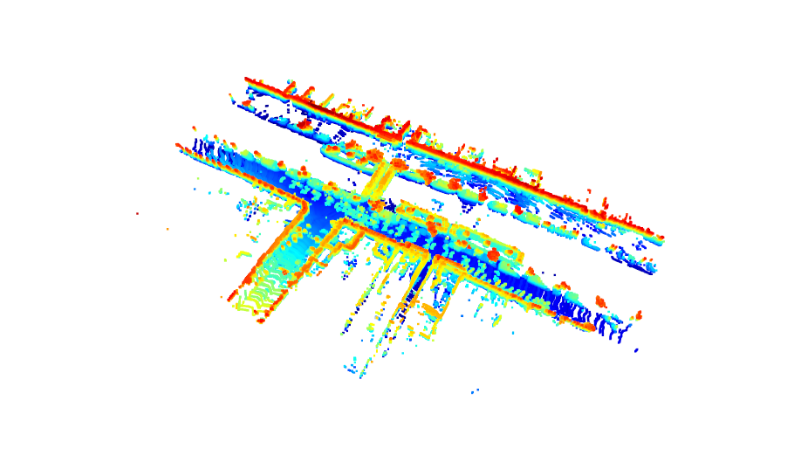

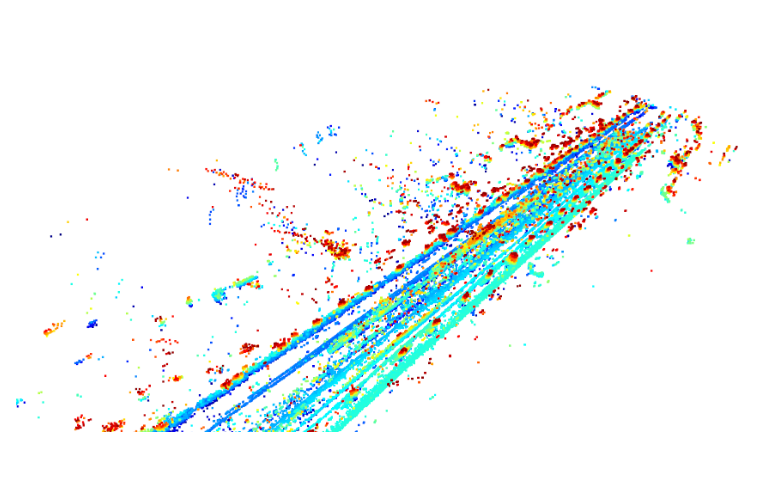

作者分别使用激光雷达和毫米波雷达点云重建三维周围环境,通过实验验证发现与激光雷达的测绘结果相比4D毫米波雷达具有重建三维周围环境的潜在能力。

四、4D成像雷达

4D成像雷达是一种相对于激光雷达比较廉价,且比较稳健的传感器,可以适应所有天气和远距离检测,虽然大雨和沙城暴天气也会对4D成像雷达有一样。

4D成像雷达不需要额外的成本即可检测目标运动速度,可以提供像16线激光一样的高质量点云数据,使用简单的网络可以生成包含运动信息的3D占用。另外,4D成像雷达成本低、精度高、鲁棒性强、泛化性强,易于上板移植,并且可以与相机配合使用以产生高质量的3D占用图,与纯相机系统相比,性价比大大提高。

但是,实验验证发现使用雷达点云直接生成的具有运动状态的3D占用图,效果不如激光雷达的效果好。

原因是因为4D雷达存在噪声和虚假目标、点云边缘不清晰、物体自遮挡很严重,因此需要采用占用网络来重建3D周围环境。业界可以使用激光雷达点云来生成监督信号,具体步骤如下:

(1)使用带注释的bbox对激光雷达点云进行标注;

(2)利用自车运动信息和背景点云来绘制周围环境;

(3)使用 3D 地图中的运动信息剪切 3D 占用;

(4)将当前帧前景点云添加到3d占用中。

由于手动标注效率太低,通过激光雷达监督可以大大提高效率,节约成本。通过训练,可以使得更便宜的雷达性能解决成本高的激光雷达性能,在某些情况下,甚于毫米波雷达更好。

实验采用的占用网络输入输出结果如下:

占用网络的优点如下:

(1)当3D Bbox网络丢失目标时,3D占用网络仍然可以工作;

(2)能够输出静态感知结果,大大扩展了毫米波雷达的能力;

(3)可以通过真实形状和运动信息检测常见或者未知的障碍物;

(4)可以利用语义信息和运动信息重建3D周围环境。

占用网络的缺点如下:

(1)网络比2D Bbox复杂,训练更加耗时;

(2)重建之后噪声仍然存在。

当然,可以采用一些巧妙的网络设计方法降低网络的复杂性,也可以采用数据增强和地面实况细化。

五、未来布局

在信号处理模块,如何保留更多的信息到后端的数据处理中?比如距离-多普勒-角度图像很密集,可以选择直接提升到 3D 点云。

在感知层面,如何高效重建3D周围环境?如何更好地将精度不足的劣势转化为泛化好的优势?表示未知的障碍物的最佳方式是什么?

如何将4D雷达与其他传感器,尤其是相机进行融合?例如,纯视觉系统数据闭环非常昂贵,激光雷达价格高,在恶劣天气下无法工作,检测范围与视觉不匹配。带摄像头的4D成像雷达是一个不错的选择,但如何进行有效的融合呢?

与传统雷达相比,4D雷达在算法和功能方面处于完全不同的层面上。如何充分利用4D雷达感知周围环境的能力是一个非常有趣的话题,希望本文能够为4D雷达的未来发展提供一些启发。

① 全网独家视频课程

BEV感知、毫米波雷达视觉融合、多传感器标定、多传感器融合、多模态3D目标检测、点云3D目标检测、目标跟踪、Occupancy、cuda与TensorRT模型部署、协同感知、语义分割、自动驾驶仿真、传感器部署、决策规划、轨迹预测等多个方向学习视频(扫码即可学习)

视频官网:www.zdjszx.com

视频官网:www.zdjszx.com

② 国内首个自动驾驶学习社区

近2000人的交流社区,涉及30+自动驾驶技术栈学习路线,想要了解更多自动驾驶感知(2D检测、分割、2D/3D车道线、BEV感知、3D目标检测、Occupancy、多传感器融合、多传感器标定、目标跟踪、光流估计)、自动驾驶定位建图(SLAM、高精地图、局部在线地图)、自动驾驶规划控制/轨迹预测等领域技术方案、AI模型部署落地实战、行业动态、岗位发布,欢迎扫描下方二维码,加入自动驾驶之心知识星球,这是一个真正有干货的地方,与领域大佬交流入门、学习、工作、跳槽上的各类难题,日常分享论文+代码+视频,期待交流!

③【自动驾驶之心】技术交流群

自动驾驶之心是首个自动驾驶开发者社区,聚焦目标检测、语义分割、全景分割、实例分割、关键点检测、车道线、目标跟踪、3D目标检测、BEV感知、多模态感知、Occupancy、多传感器融合、transformer、大模型、点云处理、端到端自动驾驶、SLAM、光流估计、深度估计、轨迹预测、高精地图、NeRF、规划控制、模型部署落地、自动驾驶仿真测试、产品经理、硬件配置、AI求职交流等方向。扫码添加汽车人助理微信邀请入群,备注:学校/公司+方向+昵称(快速入群方式)

④【自动驾驶之心】平台矩阵,欢迎联系我们!

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?